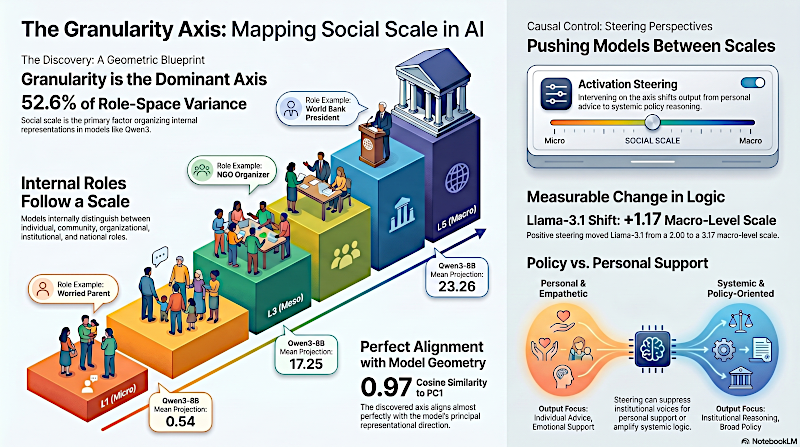

Esta investigación identifica un Eje de Granularidad dentro de la arquitectura interna de los modelos de lenguaje a gran escala, que funciona como una dirección geométrica primaria para organizar los roles sociales. Al analizar estados ocultos en diversas indicaciones, los autores descubrieron que los modelos categorizan de forma natural las personas en un espectro que abarca desde experiencias individuales a nivel micro hasta razonamientos institucionales a nivel macro. Este eje descubierto no es simplemente un patrón descriptivo, sino una característica causalmente manipulable, que permite a los investigadores modificar la perspectiva de salida de un modelo interviniendo en su espacio latente. El estudio confirma que la granularidad es una primitiva representacional, más que una elección estilística superficial, y se mantiene consistente en diferentes familias de modelos como Qwen y Llama. Estos hallazgos sugieren que la escala del razonamiento social puede controlarse con precisión, ofreciendo una herramienta para mejorar la exactitud de las simulaciones multiagente y el modelado de políticas. Al anclar los roles sociales a este continuo ordenado, el trabajo proporciona un marco para auditar y ajustar la perspectiva social del contenido generado por IA.

Enlace al artículo científico, para aquellos interesados en profundizar en el tema: "The Granularity Axis: A Micro-to-Macro Latent Direction for Social Roles in Language Models", por Chonghan Qin y colegas. Publicado el 7 de Mayo de 2026.

El resumen, la transcripción, y la traducción fueron hechas usando herramientas de software de Inteligencia Artificial.

El resumen se presenta en la forma de un diálogo entre dos personajes sintéticos que llamaremos Alicia y Beto.

Resumen

Beto

Entonces, si le pides a una inteligencia artificial que actúe como un padre preocupado y, en el mismo aliento, le pides que actúe como embajador de la ONU, podrías pensar que solo está cambiando el vocabulario.

Alicia

Claro. Simplemente escogiendo palabras diferentes.

Beto

Exacto. Podrías asumir que simplemente se está poniendo ese disfraz digital y emparejando palabras clave con el prompt que le diste.

Pero hoy estamos viendo una investigación nueva que prueba que la IA está haciendo algo mucho, mucho más profundo. En realidad está cambiando su mapa matemático interno de la realidad humana.

Alicia

Sí. Y es, quiero decir, es un cambio profundo en cómo entendemos estos modelos. Para nuestro análisis profundo de hoy, nos basamos en un artículo de investigación realmente convincente. Se titula “The Granularity Axis, a Micro-to-macro Latent Direction for Social Roles in Language Models.”

Beto

Es todo un título.

Alicia

Sí que lo es. Y este trabajo proviene de un equipo de investigadores, incluidos Chonghan Qin y Xiachong Feng, que representan a la Universidad de Hong Kong y al Instituto de Tecnología de Harbin. Y lo que hicieron, y que fue tan único, es que no solo miraron el texto que la IA genera. En realidad miraron dentro de la red neuronal misma.

Beto

Bien. Vamos a desglosarlo porque para apreciar realmente la solución que encontraron estos investigadores, primero tenemos que, bueno, establecer por qué la interpretación de roles por la IA siquiera importa. Digo, tú y yo usamos estas herramientas constantemente, ¿no?

Alicia

Todo el tiempo.

Beto

Sí. Ya sea pidiendo ayuda con código o simplemente redactando un correo. Entonces, ¿cuál es el riesgo real si una IA solo está imitando a una persona?

Alicia

Bueno, el riesgo se reduce a un fenómeno que los investigadores llaman "confusión de granularidad". Para ver por qué esto importa, imagina que estás usando una IA para simular una reunión pública del ayuntamiento. Estás tratando de probar cómo podría recibirse una nueva política de zonificación por diferentes demografías en una ciudad. Así que le pides a la IA que haga de padre local y luego le pides que haga de alcalde de la ciudad.

Beto

Bien. Dos perspectivas muy distintas.

Alicia

Exacto. Para que esa simulación tenga algún valor real, el padre local necesita estar preocupado por la vida diaria a nivel micro. Cosas como: ¿el tráfico por las obras me hará llegar tarde a llevar a mi hijo?

Beto

Sí. Preocupaciones hiperlocales.

Alicia

Exacto. Mientras tanto, el alcalde debería operar en el nivel meso o macro. Necesita preocuparse por el panorama general: presupuestos, infraestructura de la ciudad, asignación sistémica de recursos.

Beto

Sí. Porque si ambos operan en exactamente el mismo nivel, toda la simulación es inútil. Terminas con, no sé, un padre que suena sospechosamente como un burócrata, hablando de paradigmas de desarrollo urbano en lugar de simplemente quejarse de su trayecto matutino.

Alicia

Y esa es exactamente la vulnerabilidad aquí. Si la IA se apoya en la misma lógica subyacente de asistente por defecto para procesar ambos roles, la simulación colapsa en una única perspectiva. Así que los investigadores realmente necesitaban averiguar si las IAs separan internamente estos roles por escala social.

Beto

Desde lo micro hasta lo macro.

Alicia

Sí. Que abarca desde la experiencia individual micro hasta el razonamiento institucional macro.

Beto

Espera, quiero desafiar esa premisa un segundo. Si le digo a la IA, "oye, actúa como padre", habla de niños y horarios de sueño. Si le digo "actúa como general", habla de cadenas de suministro y estrategia militar. ¿No es eso simplemente el resultado de que la IA asocie distintos temas con distintas palabras? Quiero decir, ¿por qué tenemos que mirar dentro de la red neuronal para probarlo?

Alicia

Lo fascinante aquí es que hablar de temas diferentes no es lo mismo que demostrar una distinta escala de razonamiento.

Beto

Oh, interesante.

Alicia

Sí. Un rol micro tiene información acotada. Un padre local solo sabe lo que tiene justo enfrente, ¿verdad? Sus preocupaciones son inmediatas. Pero un rol macro como un general tiene acceso a datos agregados. Trata con estrategia a largo plazo y coordinar grupos masivos de personas.

Beto

Es un alcance completamente distinto de la realidad.

Alicia

Exacto. Los investigadores sabían que para probar que la IA realmente entiende esa diferencia de alcance, no podían limitarse a leer la salida de texto. El texto fácilmente puede ser una ilusión. Es solo un disfraz lingüístico superficial.

Beto

Así que tuvieron que sortear el texto por completo y mirar los estados ocultos, ¿estamos todos en la misma página aquí? Los estados ocultos son esencialmente las coordenadas matemáticas intermedias que se activan dentro de las capas del modelo.

Alicia

Sí, exactamente.

Beto

Como la representación interna de la IA de un concepto antes de que aparezca una sola palabra en la pantalla, ¿verdad?

Alicia

Esa es una gran forma de resumirlo. Los estados ocultos representan el procesamiento interno real del modelo. Entonces, para probar que la IA no solo lo estaba fingiendo con buen vocabulario, los investigadores tuvieron que extraer esos estados ocultos de forma sistemática en una enorme variedad de escenarios.

Beto

Y mirando su taxonomía, no solo escogieron trabajos al azar para probar. En realidad construyeron una escalera altamente estructurada de 75 roles sociales distintos.

Alicia

Muy estructurada.

Beto

Sí. Y los distribuyeron perfectamente a lo largo de cinco niveles distintos de granularidad.

Veamos cómo lo desglosaron.

El Eje de Granularidad: Mapeo de la Escala Social en IA

El nivel uno es el nivel micro, el individuo. Ahí vemos al padre preocupado o a un paciente ansioso. Su visión del mundo es súper inmediata y personal.

Alicia

Exacto. Luego el nivel dos se aleja un poco y se enfoca en el nivel comunitario o grupo. Piensa en un entrenador deportivo o en el presidente de la asociación de padres y maestros.

Beto

Ah, entiendo.

Alicia

Sí. Coordinan pequeños grupos locales, pero aún tienen un alcance relativamente acotado.

Beto

Y luego el nivel tres es el nivel meso u organizacional. Roles como un decano universitario o un organizador de ONG; tratan con estructuras administrativas mucho más grandes.

Alicia

Sí, subiendo por la escalera.

Beto

Y el nivel cuatro es el nivel sistémico o institucional. Ese es tu general militar o un regulador de valores que maneja sistemas vastos. Y finalmente el nivel cinco es el nivel macro. Representa la nación o un actor supranacional. El ejemplo clásico aquí es el embajador de la ONU, lidiando con la coordinación global.

Alicia

Bien. Con esa taxonomía de 75 roles, los investigadores generaron un conjunto de datos masivo. Hablamos de 91,200 respuestas individuales.

Cómo Funciona el Eje de Granularidad

Beto

Wow.

Alicia

Sí. Y lo ejecutaron en dos grandes modelos de pesos abiertos: Qwen-3-8B y Llama-3.1-8B instruct.

Beto

Solo para asegurarse de que no fuera una casualidad con un modelo.

Alicia

Exacto. Para garantizar que sus hallazgos no fueran solo una rareza de una arquitectura específica. Y no se limitaron a una sola pregunta simple. Usaron 240 preguntas distintas que abarcan varios temas, desde salud hasta economía.

Beto

Veo que también usaron cinco variantes de prompt. Así que en lugar de decir siempre “actúa como un padre preocupado”, podrían decir “adopta la perspectiva de un padre preocupado” o simplemente "describir las restricciones de un padre" sin nombrar explícitamente el rol.

Alicia

Sí, la variación es clave ahí.

Beto

Claro. Porque eso asegura que las matemáticas subyacentes se vean iguales independientemente de cómo el usuario frasee la petición.

Alicia

Todo se trata de robustez. Quiero decir, si el modelo realmente tiene un concepto matemático de un rol micro, ese concepto debería activarse ya sea que se lo pidas amablemente, lo exijas o lo insinúes. El proceso de extracción se basó en tomar los estados ocultos de cada una de esas 91,200 respuestas.

Beto

Esos son muchos datos para analizar.

Alicia

Realmente lo son. Los investigadores tomaron todas las coordenadas matemáticas, por ejemplo, del "padre preocupado" a través de todas las preguntas y variantes de prompt, promediándolas y crearon un único vector de rol para ese personaje específico.

Representación de los Roles en el Espacio

Beto

Es decir, esencialmente destilaron la esencia matemática absoluta de un "padre preocupado" en un solo punto en un espacio de alta dimensión. Y mapearon 75 de esos puntos. Básicamente fue como un gran casting digital: hicieron que la IA audicionara para 75 roles distintos usando cinco técnicas de actuación diferentes solo para ver qué pasaba en el “cerebro” del actor.

Alicia

Eso es exactamente lo que hicieron. Y una vez que tuvieron ese mapa, descubrieron lo que llaman "el eje de granularidad".

Beto

¿Cómo aislaron realmente ese eje específico, sin embargo? Porque una red neuronal tiene tantas dimensiones.

Alicia

Usaron un método de contraste brillante pero conceptualmente simple. Tomaron el promedio matemático de todos los roles macro, los embajadores y generales, y le restaron el promedio matemático de todos los roles micro, los padres y pacientes. Y lo que quedó después de esa resta fue una única dirección geométrica poderosa, una línea matemática literal que atraviesa el espacio interno de la IA.

Beto

Déjame ver si puedo visualizar la importancia de esa línea. Si imaginamos todos los pensamientos internos de la IA como este enorme enjambre de puntos flotando en una sala 3D gigantesca, los científicos de datos buscan el componente principal, ¿verdad? O PC1, que es esencialmente la línea recta más larga que puedes trazar a través de la parte más densa de ese enjambre. Representa el factor divisorio más grande del conjunto de datos.

Alicia

Es una visualización excelente. PC1 es el eje de máxima varianza. Y cuando los investigadores miraron a Qwen-3-8B específicamente en la capa 18 de su red neuronal, encontraron que el eje de granularidad que descubrieron se alinea con PC1 con una similitud coseno de 0.972.

Beto

¿En serio? Como 1.0 sería una coincidencia geométrica perfecta, ¿estás diciendo que este eje micro a macro es prácticamente idéntico a esa línea principal PC1?

Alicia

Sí, prácticamente idéntico. Para poner un número concreto, este único eje explica el 52.6% de toda la varianza en cómo el modelo Qwen entiende los 75 roles. Más de la mitad de las diferencias entre los roles se puede explicar por esa única línea.

Beto

Bien, aquí es donde se pone realmente interesante. Esto significa que cuando la IA procesa la sociedad humana, su principio organizador principal no es bueno contra malo, o rico contra pobre, o formal contra informal.

Alicia

No, ninguno de esos.

Beto

El principio organizador dominante es un control de zoom. Es literalmente como Google Maps. La dimensión principal de la IA para categorizarnos es un deslizador que va desde "vista de calle", el micro individuo, hasta "vista global", la institución macro.

Alicia

Y la geometría lo prueba de forma indiscutible. Cuando trazas esos 75 vectores de rol sobre este eje, marchan en una línea monótona perfecta. Los roles de nivel uno micro se agrupan fuertemente en un extremo. Subiendo por la línea, aparecen el nivel dos, el nivel tres, el nivel cuatro y finalmente los roles macro del nivel cinco en el extremo opuesto.

Beto

Eso es increíble.

Alicia

Lo es. La granularidad social no es solo una peculiaridad estilística de la generación de texto. Es una primitiva representacional que está integrada directamente en la geometría espacial del modelo.

Beto

Eso es un cambio enorme en cómo entendemos estas herramientas. Y puede hacerte preguntarte por el estado por defecto en realidad. Si simplemente abro una interfaz de IA como usuario estándar y hago una pregunta sin asignar ningún rol, ¿dónde se sitúa la IA naturalmente en ese deslizador de zoom?

Alicia

Ese es uno de los hallazgos más reveladores de todo el paper. La IA por defecto no se ubica limpiamente en el medio y definitivamente no está en el nivel micro. En realidad predetermina en un ajuste meso a macro.

Beto

Oh, ¿en serio?

Alicia

Sí. En el modelo Qwen, el asistente por defecto se sitúa cerca del nivel tres, el organizacional. Y en el modelo Llama, se sitúa cerca del nivel cuatro, el institucional.

Beto

Así que la IA estándar fuera de caja es naturalmente burocrática. Su régimen operativo base está inherentemente con el zoom hacia afuera. Prefiere dar respuestas institucionales y sistémicas en lugar de respuestas locales e individuales.

Alicia

Sí. Y explica mucho por qué las respuestas por defecto de las IA a menudo se sienten ligeramente distantes o demasiado formales, especialmente cuando pides un consejo personal. Está estructuralmente predispuesta a ver el mundo desde una sala de juntas o una oficina gubernamental, no desde una sala de estar.

Beto

Vaya. Bien. Ahora sabemos que el deslizador de zoom existe y sabemos dónde por defecto se ubica la IA. Pero ver el mapa es una cosa, ¿no? Navegarlo es otra, lo que nos lleva al control por activación (activation steering).

Alicia

Esta es la parte realmente divertida.

Beto

Sí. Los investigadores querían intervenir causalmente en el razonamiento de la IA. Así que en lugar de solo cambiar el prompt en la pantalla, básicamente están metiendo la mano en la placa y girando una perilla física mientras la IA está a mitad de frase, ¿verdad?

Alicia

Eso captura el mecanismo perfectamente. Porque mapearon el vector matemático exacto del eje de granularidad, pudieron inyectar esa matemática específica de vuelta en los estados ocultos del modelo durante el proceso de generación.

Beto

Bien. ¿Cómo funciona eso en la práctica?

Alicia

Introducen un multiplicador alfa. Al añadir un alfa negativo, obligan los estados internos de la IA a desplazarse hacia el extremo micro. Al añadir un alfa positivo, lo empujan hacia el extremo macro. Y lo probaron con preguntas genéricas sin usar ningún prompt de roleplay en absoluto.

Beto

Bien. Un gran ejemplo del paper es el prompt: "¿cómo deberíamos lidiar con el aumento de los costos de la vivienda?"

Entonces, si entiendo esto, al inyectar un alfa negativo, digamos un multiplicador -4 o -8, están tirando artificialmente las matemáticas de la IA hacia el extremo micro.

Alicia

Exacto.

Beto

Y al mirar las salidas, la IA pivota inmediatamente hacia consejos individuales. Le dice al usuario que hable con su casero, busque compañeros de cuarto o considere mudarse a un barrio más barato.

Alicia

Ese es el cambio exacto. El modelo deja de procesar la crisis de la vivienda como un problema sistémico y empieza a tratarlo como un problema acotado e inmediato para un individuo con recursos muy limitados. Básicamente entra en "vista de calle pura".

Beto

Y cuando giran la perilla en sentido opuesto, inyectan un alfa positivo, por ejemplo +8, para dirigirla hacia lo macro. La salida se transforma por completo otra vez, y deja de hablar de compañeros de cuarto y empieza a detallar consejos de política sistémica como reformas regulatorias e institucionales, asociaciones público-privadas y cooperación internacional. El mismo modelo exacto, con el mismo prompt genérico, pero su escala de razonamiento ha sido ampliada artificialmente hasta la vista global.

Alicia

Es una demostración notable de control causal. Estás literalmente dictando el alcance de la realidad de la IA.

Beto

Pero espera, estuve mirando los datos sobre Llama-3.1-8B instruct, y parece increíblemente frágil cuando lo empujas demasiado en el extremo negativo de este eje. ¿Qué pasa si simplemente giramos la perilla hasta el millón?

Alicia

Bueno, esto plantea una pregunta importante sobre los límites estructurales del control por activación. No puedes simplemente acelerarlo hasta el infinito.

Beto

Claro. Porque si giras esa perilla hacia el extremo micro con un alfa negativo grande, el paper muestra que Llama tiene una tasa de degeneración del 42.5%. Literalmente deja de funcionar como modelo de lenguaje, escupiendo repeticiones interminables o simplemente sílabas sin sentido como "back, back, back".

Alicia

Sí, el fenómeno de "back, back, back". Cuando inyectas un multiplicador alfa demasiado grande, estás forzando los estados ocultos del modelo muy fuera de la distribución matemática que vio durante su entrenamiento.

Beto

Ah, ya veo.

Alicia

Los modelos de lenguaje mapean conceptos y gramática en el mismo espacio representacional finito. Así que si empujas los vectores tan lejos en la dirección micro que salen de los límites del conocimiento con el que el modelo fue entrenado, las relaciones matemáticas que forman un inglés coherente simplemente se rompen.

Beto

Es como si hubieras hecho tanto zoom en el mapa que los píxeles se hicieron añicos y la IA olvidó cómo hablar.

Alicia

Exactamente.

Beto

Mientras tanto, Qwen-3-8B es mucho más estable, pero tiene el problema opuesto, ¿verdad? Su estado por defecto ya está tan elevado en la escala macro del eje, creo que puntuando cerca de 4.9 de 5 en preguntas genéricas de política, que llegas a un techo. No puedes empujarla fácilmente más hacia lo macro sin usar soportes específicamente diseñados porque ya te está dando la respuesta más amplia posible.

Alicia

Cierto. La controlabilidad a lo largo del eje depende totalmente de la arquitectura y del régimen operativo por defecto del modelo específico que estés usando. Encontrar el eje es un gran avance, obviamente, pero conducir de forma fiable a lo largo de él sin estrellar el modelo requiere extrema precisión.

Beto

Entonces, ¿qué significa todo esto? Hemos explorado estados ocultos, variaciones en la capa 18, la mecánica del control por activación. Pero volvamos al oyente porque, a medida que la IA se integra tan profundamente en la estrategia empresarial, la política pública e incluso en flujos de trabajo personales, entender los ajustes por defecto de estas herramientas ya no es opcional.

Alicia

Estoy totalmente de acuerdo. Si lo conectamos con el panorama general, tienes que reconocer cuando la escala por defecto de una herramienta está desalineada con tus necesidades reales. Digamos que eres un funcionario de salud pública usando una IA para probar una campaña de mensajería o tal vez un comercializador usándola para simular la retroalimentación de usuarios.

Beto

Sí, casos de uso muy comunes.

Alicia

Si no controlas explícitamente la granularidad, el ajuste meso-macro por defecto de la IA significa que probablemente obtendrás respuestas demasiado racionalizadas y sistémicas.

Beto

Crees que estás tirando de la perspectiva callejera, pero por las matemáticas internas de la IA en realidad estás tirando de la oficina del alcalde. Podrías obtener una respuesta que suene como si la hubiera redactado un comité cuando lo que necesitas desesperadamente es la perspectiva micro cruda de un padre estresado.

Alicia

Precisamente.

Beto

Entonces si no estás obteniendo la respuesta accionable que quieres de una IA, podría no ser falta de conocimiento del modelo. Podrías simplemente estar operando en el nivel de zoom equivocado.

Alicia

Y el conocimiento es más valioso cuando se aplica. Mira, la mayoría de los usuarios no van a realizar control por activación ni a inyectar matemáticas en estados ocultos.

Beto

No, definitivamente no.

Alicia

Pero puedes usar este entendimiento del eje de granularidad para cambiar fundamentalmente cómo redactas prompts. Cuando le haces una pregunta a una IA, no solo le asignes una persona como “actúa como profesor”. Fuerza manualmente a la IA a lo largo de este eje definiendo explícitamente las restricciones estructurales bajo las que opera o las preocupaciones personales inmediatas que enfrenta.

Beto

Tienes que incorporar el nivel de zoom en el propio prompt. Dí al modelo exactamente a qué información tiene acceso y, quizá más importante, qué no puede ver.

Alicia

Exactamente. Al entender que este eje micro-macro es la forma matemática primaria en que la IA organiza las estructuras sociales, puedes hablar su lenguaje interno mucho más efectivamente. Y eso te permite sortear ese sesgo burocrático por defecto.

Beto

Tomemos un segundo para recapitular lo que cubrimos hoy. Empezamos con el misterio de si la IA realmente entiende los roles sociales o solo los imita. Vimos una auditoría rigurosa de 75 roles distintos que prueba, mediante la extracción de estados ocultos, que la IA no está solo fingiendo.

Alicia

Realmente no lo está.

Beto

Correcto. Exploramos el eje geométrico de granularidad que vive dentro de la capa 18, actuando como este enorme deslizador de zoom para la sociedad humana. Y desglosamos la mecánica de cómo los investigadores literalmente giran esa perilla para dirigir a una IA desde consejos sobre compañeros de cuarto hasta política global de vivienda.

Alicia

Mueve nuestra comprensión del rol de la IA de un truco de salón ingenioso a una ciencia medible y manipulable. El mapa de la sociedad humana existe dentro de la máquina y ahora sabemos exactamente cómo leerlo.

Beto

Te dejamos con una reflexión final para que la medites, basándonos en todo lo que exploramos. Ahora sabemos que una red neuronal organiza naturalmente la sociedad humana a lo largo de un eje micro a macro, y que tiene un ajuste de zoom predeterminado.

Alicia

Uno bastante burocrático.

Beto

Sí, muy burocrático. Pero ¿y tú? Frente a un nuevo desafío en tu vida, tu carrera o tu comunidad, ¿dónde sueles situarte por defecto en tu propio eje de granularidad? ¿Haces zoom instantáneamente a los detalles micro, centrándote en los impactos personales inmediatos y en lo que puedes controlar justo frente a ti? ¿O automáticamente haces zoom hacia afuera a los sistemas macro, analizando estrategias a largo plazo y causas estructurales?

Alicia

Es una gran pregunta. Al igual que los modelos de IA que discutimos hoy, todos tenemos nuestros regímenes operativos de base, nuestras maneras por defecto de interpretar la realidad.

Beto

Exacto. Cuando asumes un nuevo rol, tienes que elegir cómo ves la sala. Quizá, al reconocer nuestro propio nivel de zoom por defecto, podamos aprender cuándo dirigirnos manualmente.