Esta extensa encuesta ofrece una visión técnica completa de los modelos de lenguaje a gran escala (LLM), analizando su evolución desde los primeros métodos estadísticos hasta las arquitecturas modernas con miles de millones de parámetros, como GPT-4 y LLaMA. Los autores examinan el fenómeno de las leyes de escala, que determinan cómo el aumento del tamaño de los datos y del modelo conduce al surgimiento de capacidades avanzadas como el razonamiento y el aprendizaje contextual. Se detallan las fases clave del desarrollo, centrándose específicamente en el papel fundamental del preprocesamiento de datos, las estrategias de preentrenamiento y el ajuste de las instrucciones para alinear los modelos con las preferencias humanas. El texto también cataloga recursos esenciales de código abierto, incluyendo conjuntos de datos y bibliotecas de software, para ayudar a los investigadores a comprender los complejos requisitos de ingeniería del desarrollo de LLM. En definitiva, las fuentes presentan a los LLM como solucionadores de tareas de propósito general que están revolucionando fundamentalmente el panorama de la inteligencia artificial.

Enlace al artículo científico, para aquellos interesados en profundizar en el tema: "A Survey of Large Language Models", por Wayne Xin Zhao y colegas. Publicado el 18 de Marzo de 2026.

El resumen, la transcripción, y la traducción fueron hechas usando herramientas de software de Inteligencia Artificial.

El resumen se presenta en la forma de un diálogo entre dos personajes sintéticos que llamaremos Alicia y Beto.

Resumen

Beto

Sabes, en realidad no hace tanto tiempo que lo más impresionante que la inteligencia artificial podía hacer era simplemente terminarte la frase en una barra de búsqueda.

Alicia

Exacto. Como que escribías "cómo hervir" y te sugería "un huevo".

Beto

Exactamente. Es un pequeño truco de salón. Pero hoy, quiero decir, estamos tratando con sistemas de IA que escriben arquitecturas de software complejas, pasan el examen de abogado y literalmente simulan el razonamiento humano paso a paso.

Alicia

Es un salto asombroso.

Beto

De verdad lo es. Hemos pasado de un autocompletar glorificado a algo que altera fundamentalmente cómo procesamos la información.

Alicia

Es un cambio completo de paradigma. Sí. Y dado que la velocidad de esta tecnología ha sido tan implacablemente rápida, es muy fácil mirar el panorama actual y sentir que estos modelos son simplemente cajas negras mágicas.

Beto

Claro.

Alicia

Pero en realidad no son magia. Son el resultado de avances muy específicos en matemáticas e ingeniería.

|

|

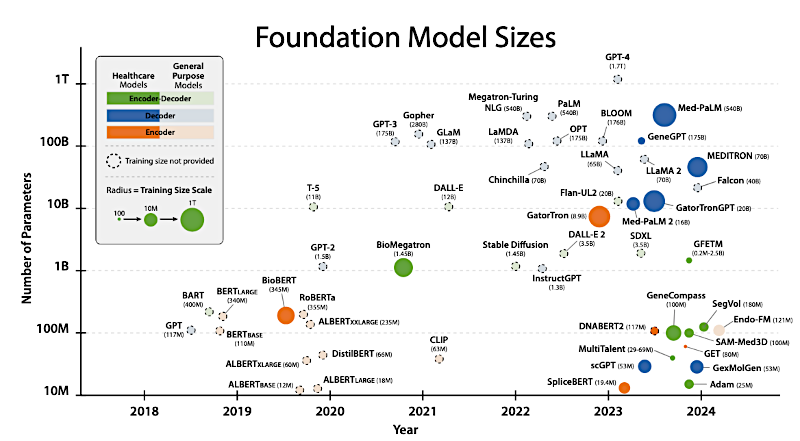

| Cronologia de los LLMs |

Beto

Totalmente. Y precisamente por eso la inmersión de hoy está diseñada para ser tu atajo definitivo para ponerte al día con lo que sucede bajo el capó.

Alicia

Sí. Hoy realmente vamos al fondo.

Beto

Sí. Anclamos nuestra conversación en la actualización 2026 de un artículo emblemático: se llama "A Survey of Large Language Models", elaborado por Wayne Xin Zhao y un enorme equipo de investigadores.

Alicia

Es un artículo fantástico.

Beto

De verdad lo es. Y nuestra misión hoy es cortar todo el lenguaje académico y extraer los mecanismos centrales de cómo funcionan realmente estos modelos. Vamos a desentrañar la evolución, las recetas de datos específicas y la sala de máquinas literal que los hace funcionar.

Alicia

Y para establecer un marco mientras nos sumergimos, creo que ayuda ver todo este campo a través de una única lente fundacional.

Beto

¿Cuál?

Alicia

Bueno, el modelado del lenguaje desde sus inicios siempre ha tenido un objetivo específico: comprimir el conocimiento del mundo en una máquina.

Beto

Comprimirlo.

Alicia

Sí. Ahora, simplemente, ¿qué ocurre cuando esa compresión alcanza una masa crítica explosiva?

Beto

Entonces tracemos esa compresión hacia atrás, porque para comprender verdaderamente la arquitectura de una IA moderna tienes que entender los cuellos de botella que nos retuvieron durante décadas. ¿Verdad?

Alicia

Absolutamente.

LLMs: de Predictores de Texto, a Solucionadores de Tareas

Beto

La encuesta traza cuatro generaciones distintas de modelos de lenguaje, empezando por pura estadística.

Alicia

Correcto. Así que la primera generación, que dominó los 90 y primeros 2000, confiaba en modelos estadísticos de lenguaje. Eran esencialmente modelos N-gram. Intentaban predecir la siguiente palabra basándose enteramente en la probabilidad de las pocas palabras que la precedían inmediatamente, pero chocaron con un enorme escollo, llamado "la maldición de la dimensionalidad".

Beto

Ajá, claro. Porque si quieres que el modelo realmente entienda el contexto de todo un párrafo, las combinaciones matemáticas de secuencias de palabras explotan exponencialmente, ¿no?

Alicia

Exacto. Se te acaba la potencia de cómputo casi al instante. Simplemente no puedes mapear la probabilidad de cada oración de 20 palabras en inglés.

Beto

¿Cómo lo superaron?

Alicia

Pues los investigadores tuvieron que replantear por completo cómo las máquinas representan el lenguaje. Eso condujo a la segunda generación alrededor de 2013, que fueron los modelos neuronales de lenguaje.

Beto

Y esa fue la era de word2vec.

Alicia

Exacto. En lugar de fijarse en coincidencias exactas de palabras, los investigadores usaron redes neuronales para mapear palabras como vectores distribuidos en un espacio continuo y multidimensional.

Beto

Bien. Así que en lugar de que una palabra sea solo una cadena de letras, se convierte en un conjunto de coordenadas.

Alicia

Sí.

Beto

Palabras con significados similares, como, no sé, "rey" y "reina", acaban físicamente más cerca en ese espacio matemático.

Alicia

Lo clavaste. Eso permitió a la máquina entender relaciones semánticas por primera vez.

Beto

Oh, wow.

Alicia

Y luego llegó la tercera generación con los modelos preentrenados de lenguaje, sobre todo BERT.

Beto

Oh, sí, BERT fue enorme.

Alicia

Lo fue. Porque en lugar de solo aprender coordenadas de palabras, estos modelos aprendieron representaciones conscientes del contexto. Leyeron enormes cantidades de texto sin etiquetar primero, ...

Beto

... absorbiéndolo todo.

Alicia

Sí. Aprendiendo el contexto bidireccional profundo de una oración antes de ser afinados para una tarea estrecha y específica, como traducción o análisis de sentimiento.

Beto

Pero seguían siendo, en última instancia, expertos estrechos, ¿no? Tenías un modelo para traducir francés y otro completamente distinto para resumir un documento.

Alicia

Exacto.

Beto

Así que el verdadero salto, la cuarta generación, ocurrió cuando los investigadores esencialmente decidieron dejar de construir expertos estrechos y, en su lugar, construyeron grandes modelos de lenguaje.

Alicia

Sí, la teoría subyacente cambió.

Beto

Y la filosofía predominante se volvió sorprendentemente directa, ¿no? Simplemente haz la red neuronal masiva.

Alicia

Sí, eso fue exactamente lo que pasó. Los investigadores hipotetizaron que si escalas los parámetros —las sinapsis artificiales de la red— y escalas los datos, el modelo no solo mejoraría en predecir texto;

Beto

se convertiría en un solucionador de tareas de propósito general.

Alicia

Precisamente. Y esta explosión en tamaño estuvo gobernada por leyes de escala increíblemente precisas.

Beto

Correcto. La primera de peso fue la ley de escala KM de OpenAI.

Alicia

Sí.

Beto

Esencialmente probaron una relación matemática que muestra que si tienes un presupuesto finito pero enorme de potencia de cómputo, obtienes el mejor retorno de inversión al dedicar ese cómputo a aumentar el tamaño bruto del modelo —el conteo de parámetros— en lugar de simplemente ejecutar más datos a través de un modelo más pequeño.

Alicia

Exacto. Más tarde, ese enfoque se refinó con la ley de escala Chinchilla por Google DeepMind.

Beto

Correcto.

Alicia

Y eso alteró fundamentalmente cómo se estaban utilizando los centros de datos.

Beto

Espera, quiero contraponer esto un segundo. Si OpenAI demostró que modelos más grandes dan mejores resultados, ¿por qué la industria no se centró exclusivamente en construir colosos de billones de parámetros?

Alicia

Es una buena pregunta.

Beto

Quiero decir, ¿hay un límite matemático a solo arrojar escala de parámetros al problema?

Alicia

Sí lo hay. Exactamente, eso es lo que probó el artículo de Chinchilla. Encontraron que la ley de escala KM en realidad subestimaba ligeramente la importancia de los datos en sí.

Beto

Interesante.

Alicia

Sí. DeepMind demostró que para obtener un rendimiento óptimo dado un presupuesto de cómputo, necesitas escalar el tamaño del modelo y la cantidad de datos de entrenamiento por igual.

Beto

Escalas iguales.

Alicia

Exacto. Así que si duplicas el número de parámetros en tu red, matemáticamente debes duplicar la cantidad de datos de entrenamiento que le das.

Beto

¿Si no?

Alicia

Terminas con un modelo masivamente hinchado que está esencialmente subentrenado e increíblemente ineficiente.

Beto

Entendido. Y cuando finalmente balancearon esa ecuación —grandes conteos de parámetros emparejados con enormes conjuntos de datos de alta calidad— vimos nacer lo que los investigadores llaman "habilidades emergentes".

Alicia

Sí, los saltos "mágicos".

Beto

Correcto. Son capacidades como seguir instrucciones complejas, aprender en contexto y razonamiento paso a paso. Esas que sencillamente no existen cuando un modelo tiene mil millones de parámetros, pero que se encienden de forma espontánea cuando alcanza los cien mil millones.

Alicia

Es fascinante.

Beto

Es como ver agua que se calienta: es solo agua caliente que se calienta más y más y, de repente, a 100 grados Celsius ocurre una transición de fase y se vuelve vapor. Cambia fundamentalmente su comportamiento.

Alicia

La metáfora de la transición de fase es perfecta. El modelo pasa de predecir meramente sintaxis a aparentemente predecir lógica.

Beto

Espera, sin embargo, porque no me queda del todo claro.

Alicia

¿Cómo es eso?

Beto

Bueno, si las leyes de escala Chinchilla y KM se basan en curvas matemáticas suaves y previsibles donde más cómputo equivale a una caída constante en la tasa de error, ¿por qué las salidas reales —esas habilidades emergentes— ocurren como picos repentinos e impredecibles? ¿Estamos realmente viendo un salto mágico en la cognición? ¿O es una ilusión creada por cómo los humanos evaluamos las pruebas?

Alicia

Esa es en realidad una de las preguntas más disputadas en el campo ahora mismo.

Alicia

Oh, absolutamente. Muchos investigadores sostienen que la emergencia es, en efecto, una ilusión causada por nuestras métricas de evaluación.

Beto

¿Cómo funciona eso?

Alicia

Bueno, piensa en cómo evaluamos a una IA en programación. Usamos una métrica binaria: ¿el código compiló y funcionó con éxito? ¿Sí o no?

Beto

Correcto.

Alicia

Por debajo del capó, el modelo podría estar mejorando de forma constante y suave su predicción de sintaxis durante meses a medida que escala. Pero no vemos esa curva suave.

Beto

Solo vemos que la puntuación salta de 0 a 100 exactamente el día que el modelo por fin pone todos los puntos y comas en su sitio.

Alicia

Exacto. Así que la comprensión interna de la IA está en un gradiente suave, pero nuestra percepción humana de su éxito es un acantilado repentino.

Beto

Hmm, eso tiene mucho sentido.

Alicia

Pero también hay que notar que para ti, el usuario final, esa discontinuidad es muy real. No te importa si una IA está al 90% de escribir un script de Python funcionando; solo te importa cuando cruza el umbral y realmente funciona.

Beto

Totalmente justo.

Alicia

Además, hay fenómenos documentados como el "grokking", donde la representación interna de un modelo se reorganiza de repente para generalizar perfectamente un patrón después de millones de pasos de rendimiento aparentemente aleatorio. Así que sí, la mecánica pura de la emergencia aún se está desenmarañando activamente.

Beto

Lo que nos lleva a la organización que realmente comercializó esas leyes de escala: OpenAI y la serie GPT.

Alicia

Exacto.

Beto

GPT, por supuesto, significa "Generative Pre-trained Transformer". La arquitectura empezó relativamente pequeña con GPT-1, luego GPT-2 con 1.500 millones de parámetros, y luego lanzaron GPT-3, que tenía 175.000 millones de parámetros.

Alicia

Y GPT-3 fue el modelo que realmente probó al mundo el concepto de aprendizaje en contexto.

Beto

Es decir, que no tenías que reentrenarlo para cada nueva tarea.

Alicia

Exacto. No necesitabas reentrenar los pesos del modelo. Podías simplemente darle unos pocos ejemplos en el propio prompt de texto, y el modelo identificaría el patrón y completaría la tarea dinámicamente.

Beto

Pero por impresionante que fuera GPT-3, no era GPT de verdad.

Alicia

No, no lo era.

Beto

No era el agente conversacional y razonador en el que confiamos hoy. Para salvar esa brecha, los investigadores tuvieron que implementar dos enormes mejoras de capacidad.

Alicia

Sí, así fue.

Beto

Y la primera es absolutamente fascinante para mí: el entrenamiento con código.

Alicia

Oh, esto es enorme.

Beto

OpenAI afinó sus modelos con grandes repositorios de código de GitHub, creando un modelo llamado Codex. Evidentemente, eso hizo a la IA buena programando. Pero la sorpresa fue que digerir código informático desbloqueó inesperadamente razonamiento sofisticado y lógica de cadena de pensamiento también en lenguaje natural.

Alicia

Es un efecto secundario brillante de la arquitectura.

Beto

¿Pero por qué? Quiero decir, ¿por qué alimentar a una red neuronal con miles de líneas de Python la convierte en mucho mejor para resolver un acertijo lógico en inglés o para escribir un ensayo legal altamente estructurado? ¿Qué tiene el código que enseña al modelo a "pensar"?

Alicia

Realmente se reduce a las diferencias estructurales entre el lenguaje humano y el código. El lenguaje humano es muy permisivo y, honestamente, a menudo ambiguo.

Beto

Eso es verdad.

Alicia

Si desordeno la sintaxis de una frase o uso un pronombre vago, normalmente puedes usar el contexto para deducir lo que quiero decir. Un modelo entrenado puramente en Reddit y Wikipedia aprende esa laxitud. Pero el código informático es completamente determinista. Es rígidamente jerárquico. Y, lo más importante, depende de dependencias estrictas a largo alcance.

Beto

Correcto. Porque si defines una variable en la línea 12, tiene que ser exactamente lo mismo cuando la llamas en la línea 800.

Alicia

Exacto. Requiere rastrear estados, mantener una lógica interna rigurosa y ejecutar procedimientos paso a paso para alcanzar un objetivo.

Beto

Vaya.

Alicia

Así que al forzar a la red neuronal a predecir el siguiente token en un bloque de código de software complejo, estás obligando matemáticamente a sus "attention heads" a rastrear esas dependencias a largo plazo y a internalizar la deducción secuencial.

Beto

Efectivamente aprende la arquitectura subyacente del razonamiento, que luego puede aplicar al lenguaje humano.

Alicia

Sí.

Beto

Básicamente le estás enseñando la disciplina estricta de la lógica.

Alicia

Precisamente.

Beto

Tiene todo el sentido. Así que el entrenamiento con código construye el "cerebro lógico".

Alicia

Sí.

Beto

Pero la segunda mejora de capacidad tenía que ver con el comportamiento.

Alicia

Pues sí: RLHF.

Beto

RLHF es "Reinforcement Learning from Human Feedback", Aprendizaje por refuerzo a partir de retroalimentación humana. Porque incluso un modelo de lenguaje masivo y muy lógico es, en última instancia, solo un motor de predicción de texto. Si lo dejas a su aire, puede divagar, generar contenido altamente tóxico o contestar una pregunta con otra pregunta.

Alicia

Correcto. El preentrenamiento puro te da un modelo que refleja con precisión Internet. Es decir, puede ser brillante, pero también caótico, sesgado y profundamente poco útil.

Beto

Totalmente.

Alicia

RLHF es la fase de alineamiento. Es el proceso de enseñar a ese sabio caótico la etiqueta necesaria para ser un asistente útil, inocuo y honesto.

Beto

Siempre lo pienso como tomar a un genio brillante pero completamente salvaje, que ha memorizado Internet entero, y enseñarle las reglas sociales para asistir a una cena formal.

Alicia

Es una gran analogía.

Beto

Y el mecanismo es literalmente poner a humanos en el bucle de entrenamiento como jueces de comportamiento.

Alicia

Correcto. Los investigadores le daban un prompt al modelo y este generaba varias respuestas potenciales. Los etiquetadores humanos leían esas respuestas y las ordenaban de mejor a peor según su utilidad y seguridad.

Beto

Pero espera: la IA no lee las clasificaciones y piensa "oh, me equivoqué, mejoraré". ¿Cómo altera esa preferencia humana realmente la red neuronal?

Alicia

Buena pregunta. Usan esas clasificaciones humanas para entrenar una segunda IA más pequeña llamada modelo de recompensa. Este modelo de recompensa aprende a puntuar el texto exactamente como lo haría un humano. Luego usan un algoritmo de aprendizaje por refuerzo, normalmente algo llamado "Proximal Policy Optimization" (PPO), para dejar que el modelo principal practique generando respuestas.

Beto

Y sea calificado.

Alicia

Exacto. Cada vez que genera una respuesta, el modelo de recompensa la puntúa. Durante millones de iteraciones, el modelo principal actualiza sus pesos internos para maximizar esa puntuación de recompensa.

Beto

Así que literalmente cambia sus distribuciones de probabilidad para favorecer el tono y la estructura que los humanos prefieren.

Alicia

Eso es exactamente.

Beto

Código le da lógica y RLHF le da personalidad y límites.

Alicia

Correcto.

Beto

Pero nada de eso funciona si la base subyacente está mal, lo que nos lleva a la dieta real del modelo: la receta de datos.

Alicia

El combustible.

Beto

Sabemos que ingieren petabytes de información: Common Crawl, scrapes web, bibliotecas de libros, artículos científicos de arXiv. Pero la encuesta enfatiza que no puedes simplemente echar datos crudos en un superordenador.

Alicia

No, para nada. La calidad de los datos es, posiblemente, el cuello de botella más crítico en la IA moderna.

Beto

Oh, sí.

Alicia

Las tuberías de limpieza son extraordinariamente complejas. Tienes filtrado heurístico para eliminar spam de baja calidad, limpieza de privacidad para remover información personal identificable y, quizá lo más importante, desduplicación.

Beto

Eliminar texto idéntico o altamente similar.

Alicia

Sí.

Beto

Espera un momento. Si la ley de escala Chinchilla dicta que necesitamos océanos absolutos de datos para entrenar bien estos gigantes, ¿por qué la desduplicación es tan crítica?

Alicia

Parece contradictorio.

Beto

Tiene razón: parece intuitivo pensar que necesitaríamos el mismo libro o artículo diez veces para que la IA memorice mejor ese concepto. ¿Por qué la IA se "envenena" al leer la misma frase demasiadas veces?

Alicia

Bueno, en el aprendizaje humano la repetición es buena. Pero en redes neuronales, el exceso de datos duplicados dispara una falla matemática conocida como "double descent" o "sobreajuste severo".

Este es el mecanismo: un modelo de lenguaje intenta aprender las reglas generales subyacentes de gramática, lógica y hechos. Cuando el algoritmo de entrenamiento encuentra la misma secuencia de texto una y otra vez, los gradientes matemáticos que actualizan los pesos del modelo comienzan a cavar una zanja profunda y estrecha. El modelo se sobreoptimiza para esa cadena específica de palabras.

Beto

Se fija en ella.

Alicia

Se queda anclado. Sus mecanismos de atención se sobrefijan en ese ruido repetitivo, lo que daña activamente su capacidad de generalizar a prompts nuevos no vistos. Si le preguntas algo ligeramente distinto, intenta forzar el texto memorizado en la respuesta. Básicamente rompe la capacidad del modelo para aprender dinámicamente en contexto.

Beto

Así que la diversidad en el conjunto de datos no es solo una preferencia: es estructuralmente vital para mantener los pesos neuronales flexibles.

Alicia

Exacto.

Beto

Fascinante. Entonces los datos se limpian agresivamente y se desduplican. Luego viene el proceso de tokenización.

Alicia

Sí.

Beto

Y este es un concepto que los usuarios avanzados realmente necesitan comprender. Porque una IA no "lee" la palabra "unbelievable" como lo hace un humano. No procesa palabras enteras basándose en sus definiciones.

Alicia

No: el texto bruto debe traducirse a números. Algoritmos como "Byte Pair Encoding" (BPE) escanean el conjunto de datos y van fusionando iterativamente los caracteres adyacentes que más aparecen.

Beto

Como bloques de Lego atómicos del lenguaje.

Alicia

Sí. Entonces puede mantener palabras comunes como "el" o "Apple" como tokens únicos, pero una palabra compleja o rara como "unbelievable" podría fracturarse en sub-tokens como "un", "believ" y "able".

Beto

Pero, ¿por qué no hacer cada palabra del diccionario su propio token? ¿No sería más limpio?

Alicia

Realmente se reduce a límites de vocabulario y eficiencia de la ventana de contexto. Si el vocabulario de tu modelo fuera una lista fija de 50.000 palabras enteras, ¿qué pasa cuando encuentra una falta de ortografía o un término de jerga nuevo o un nombre de variable muy específico en código?

Beto

Simplemente produciría un token desconocido.

Alicia

Exacto. Usando tokenización por subpalabras como BPE, el modelo puede construir o descomponer dinámicamente cualquier palabra en cualquier idioma o cualquier cadena de código a partir de sus componentes subword.

Beto

Tiene todo el sentido. Mantiene el diccionario comprimido pero infinitamente adaptable.

Alicia

Exacto.

Beto

Y una vez que tenemos esos tokens meticulosamente creados, los investigadores despliegan un currículo de datos. No vierten todo de golpe. El orden de las operaciones importa enormemente.

Alicia

Sí.

Beto

La encuesta destaca que codeloma es un ejemplo perfecto.

Alicia

Correcto. El aprendizaje por currículo imita el desarrollo cognitivo. Con codeloma, los investigadores primero entrenan el modelo en dos billones de tokens de texto general amplio. Esto construye la comprensión fundamental del lenguaje, hechos y estructura del mundo. Luego cambian al currículo, afinándolo con 500.000 millones de tokens de datos fuertemente orientados a código para inculcar ese razonamiento lógico del que hablamos.

Beto

Correcto. Construyendo la lógica.

Alicia

Y finalmente hacen una pasada hiperfocalizada de 100.000 millones de tokens específicamente relacionados con Python.

Beto

Básicamente: una educación general, seguida de una carrera en ciencias de la computación y culminada con una maestría en Python.

Alicia

Perfecta analogía.

Beto

Muy bien. Hemos curado la dieta perfecta, desduplicada y la hemos alimentado a través de un currículo optimizado. Entremos en la sala de máquinas mecánica.

Alicia

Vamos.

Beto

Cuando pulso Enter en un prompt, ¿cómo es la arquitectura física de la IA y cómo procesa mi solicitud?

Alicia

Casi todos los modelos de lenguaje de vanguardia usan una arquitectura llamada "decodificador causal", "causal decoder".

Beto

Bien.

Alicia

La variación científica del Transformador introducido en 2017: un decodificador causal opera bajo una regla estricta. Solo puede mirar hacia atrás, a los tokens que vinieron antes.

Beto

Nunca puede mirar hacia adelante.

Alicia

Correcto. Usa mecanismos de auto-atención para ponderar la importancia de cada palabra previa en tu prompt para predecir matemáticamente el siguiente token más probable.

Beto

Pero eso crea un enorme cuello de botella computacional, ¿no? Por la complejidad cuadrática de la auto-atención.

Alicia

Sí, lo hace.

Beto

Si te doy un prompt de mil palabras, cada una de esas palabras tiene que calcular su relación con todas las demás. Y si amplío el prompt a 10.000 palabras, la potencia de cómputo necesaria no solo sube por 10: explota de forma cuadrática.

Alicia

Es un problema de escala enorme.

Beto

¿Cómo manejan los modelos modernos esas ventanas de contexto masivas de 100.000 tokens sin fundir las GPUs?

Alicia

Lo hacen mediante una ingeniería arquitectónica brillante. Una de las rupturas más importantes destacadas en la encuesta es RoPE, que significa "Rotary Positional Embeddings".

Beto

RoPE. ¿Cómo resuelve RoPE el problema de contexto?

Alicia

En modelos más antiguos, tenías que asignar un número absoluto rígido a la posición de una palabra: palabra 1, palabra 2, palabra 3. Eso se desmorona a largas distancias. RoPE toma un enfoque matemático completamente distinto. En lugar de asignar una ID estática, toma el vector matemático de un token y literalmente lo rota en un plano complejo multidimensional según su posición en la secuencia.

Beto

¿En serio? Entonces, la posición se codifica como un ángulo.

Alicia

Exacto. Cuando el mecanismo de atención quiere saber qué tan separados están dos tokens —digamos un pronombre en la página 10 y el sustantivo al que se refiere en la página 1— simplemente calcula el ángulo entre sus dos vectores rotados.

Beto

Oh, wow.

Alicia

Esta posicionalidad relativa es increíblemente eficiente y permite al modelo mantener contexto a través de documentos vastos sin que las matemáticas se vayan al garete.

Beto

Pero incluso con RoPE optimizando la matemática de posición, sigue habiendo un enorme problema físico de memoria en las GPUs del servidor, ¿no?

Alicia

Oh, absolutamente.

Beto

Porque a medida que el modelo genera una respuesta token por token, tiene que almacenar los estados de auto-atención calculados —las matrices key y value— para cada token anterior. Así no tiene que recalcular todo el ensayo cada vez que añade una sílaba.

Alicia

Sí. Eso se conoce como la "caché KV". Y es el mayor devorador de memoria GPU en la IA hoy.

Beto

¿Cómo lo solucionan?

Alicia

Se apropian de un concepto de los sistemas operativos tradicionales llamado "memoria virtual paginada". En IA lo llaman "atención paginada", PagedAttention.

Beto

¿Cómo arregla la paginación la caché KV?

Alicia

Normalmente la caché KV requiere bloques continuos masivos de memoria. Si un bloque está fragmentado, la memoria se desperdicia y la GPU se queda sin espacio. La atención paginada lo soluciona troceando la caché KV en bloques pequeños de tamaño fijo que pueden almacenarse dinámicamente en espacios no contiguos fragmentados a través del pool de memoria de la GPU.

Beto

Muy inteligente.

Alicia

Reduce drásticamente el desperdicio de memoria, permitiendo al servidor manejar muchos más usuarios simultáneos y ventanas de contexto mucho más largas.

Beto

Y la encuesta también menciona que para acelerar la lectura física de esa memoria por parte de la GPU, los investigadores desarrollaron "FlashAttention", que optimiza el movimiento físico de datos entre los bancos de memoria grandes y lentos de la GPU y la caché de cómputo ultra‑rápida y pequeña junto al núcleo de procesamiento.

Alicia

Sí.

Beto

Minimiza el cuello de botella de IO.

Alicia

Exacto.

Beto

Pero lo que realmente me fascina es que los investigadores ya están mirando más allá del transformador por completo.

Alicia

Sí.

Beto

La encuesta destaca arquitecturas emergentes como Mamba, que usan modelos de espacio de estados.

Alicia

Correcto. Los "modelos de espacio de estados", "State Space Models" (SSM) están intentando destronar activamente al transformador. Como dijimos, el transformador tiene ese cuello de botella cuadrático por la auto-atención: cada token mira a todo token pasado. Mamba aborda el problema de forma lineal. Funciona algo así como una red neuronal recurrente tradicional donde mantiene un estado oculto que se actualiza a medida que lee token por token.

Beto

Pero espera: las redes recurrentes antiguas solían olvidar el comienzo de una oración al llegar al final. ¿Cómo evita Mamba eso?

Alicia

Mamba introduce un mecanismo de filtrado selectivo. Mientras procesa una secuencia, las matemáticas dictan dinámicamente qué información es vital para mantener en su memoria de estado interno y qué información es irrelevante y debe olvidarse de inmediato.

Beto

Eso es ingenioso.

Alicia

Porque no está reevaluando constantemente cada token pasado, los requisitos de cómputo de Mamba escalan linealmente con la longitud de la secuencia en lugar de cuadráticamente. Es una arquitectura increíblemente eficiente que podría representar el próximo gran cambio de paradigma.

Beto

El modelo ha digerido el prompt, mapeado los vectores multidimensionales, optimizado sus cachés de memoria y determinado matemáticamente la probabilidad de cada posible siguiente palabra en su vocabulario.

Alicia

Correcto.

Beto

Ahora tiene que elegir una. Esta es la estrategia de decodificación. Y el método más básico es la "búsqueda codiciosa".

Alicia

"Búsqueda codiciosa", "Greedy search", es exactamente lo que parece: el modelo mira la distribución de probabilidad para el siguiente token y simplemente selecciona la opción de mayor probabilidad. Lo hace cada vez sin excepción.

Beto

La búsqueda codiciosa hace un conversador terrible.

Alicia

Sí, lo hace.

Beto

Si siempre eliges la palabra estadísticamente más probable, la salida se vuelve repetitiva, en bucle y robótica.

Alicia

Claro.

Beto

El lenguaje humano es dinámico. No siempre usamos la palabra más predecible, por eso la investigación introdujo métodos de muestreo aleatorio como Top-p y el ajuste más crítico para cualquier usuario avanzado: la temperatura.

Alicia

La temperatura es esencialmente un modificador matemático aplicado a la distribución de probabilidad antes de que el modelo haga su elección.

Beto

Siempre la describo como un dial literal de creatividad para la IA.

Alicia

Lo es.

Beto

Si estás haciendo tus impuestos o pidiéndole a la IA que escriba una consulta SQL funcional, quieres la temperatura en cero. Quieres búsqueda codiciosa. Quieres determinismo porque hay una respuesta matemáticamente correcta. Pero si estás generando ideas para copy de marketing o escribiendo una novela, subes la temperatura.

Alicia

Exacto. Cuando aumentas la temperatura, digamos a 0.7 o 1.0, estás matemáticamente aplanando la curva de probabilidad.

Beto

Bien.

Alicia

El token de mayor probabilidad sigue estando arriba, pero la brecha entre él y el segundo, tercer o cuarto token más probable se reduce.

Beto

Entiendo.

Alicia

Esto permite al modelo muestrear aleatoriamente esos tokens ligeramente menos probables. Es lo que introduce metáfora, cadencia sorprendente y esa chispa elusiva de creatividad parecida a la humana.

Beto

Lo que sintetiza perfectamente la realidad de estos sistemas: los modelos basados en datos no son magia sensible.

Alicia

No lo son.

Beto

Son la colisión de leyes de escala muy predecibles, tuberías de datos meticulosas donde la desduplicación es literalmente cuestión de vida o muerte, maravillas arquitectónicas como RoPE y atención paginada, y estrategias de decodificación que transforman estadísticas crudas en un compañero conversacional.

Alicia

Todo es solo matemáticas e ingeniería.

Beto

Y saber manipular esas palancas —como entender por qué un modelo entrenado en Python es mejor en lógica deductiva— cambia fundamentalmente cómo aprovechas la técnica.

Alicia

Empodera absolutamente al usuario. Pero si retrocedemos y miramos la trayectoria esbozada en la encuesta de 2026, hay una pregunta estructural profunda que se cierne sobre todo lo que hemos discutido hoy.

Beto

¿Cuál?

Alicia

Bueno, hablamos de cómo las leyes de escala Chinchilla exigen mares masivos de datos diversos y perfectamente limpios, ¿verdad? La realidad es que la industria está topándose rápidamente con un muro. El texto humano de alta calidad generado orgánicamente en Internet es esencialmente un recurso finito, y se nos está acabando.

Beto

Vaya. Así que el pozo de datos humanos orgánicos se está secando.

Alicia

Exacto. Para seguir escalando, los laboratorios de IA recurren cada vez más a datos sintéticos. Están usando modelos actuales para generar billones de tokens de texto para entrenar la próxima generación de modelos de lenguaje.

Beto

Modelos entrenando modelos.

Alicia

Exacto. Incluso estamos viendo modelos evaluando y alineando a otros modelos sin humanos en el bucle.

Beto

Oh, vaya.

Alicia

Esto nos deja con una variable altamente provocativa para el futuro. Si la evolución continua de la IA depende fundamentalmente de que los modelos ingieran salidas sintéticas matemáticamente generadas por otros modelos, ¿desbloqueamos un bucle descontrolado de mejora recursiva, una inteligencia artificial general auto‑mejorante, o sin la diversidad orgánica y desordenada del lenguaje humano real, corremos el riesgo de atrapar a estas arquitecturas en una cámara de eco cerrada y degenerativa donde el modelo colapsa lentamente sobre su propio ruido estadístico?

Beto

Una cámara de eco algorítmica. Colapso del modelo. Eso da miedo, pero también es totalmente fascinante.

Alicia

Realmente replantea cómo pensamos sobre el techo de esta tecnología.

Beto

Completamente. Así que la próxima vez que escribas un prompt en una ventana de chat y veas esas palabras desplazarse por la pantalla, recuerda cuánto maquinaria invisible, lógica rigurosa y arquitectura estadística perfectamente equilibrada está funcionando a velocidad vertiginosa justo bajo la superficie.