Este artículo de investigación presenta un nuevo marco para la generación creativa de imágenes, centrándose específicamente en regiones de baja probabilidad dentro del espacio de salida de los modelos de difusión. Los autores argumentan que los sistemas de IA estándar suelen favorecer resultados típicos y poco inspiradores debido a un sesgo de contra-creatividad en las métricas de entrenamiento y evaluación. Para superar esto, proponen una función de pérdida creativa especializada que incentiva al modelo a explorar incrustaciones de imágenes poco comunes y novedosas. Para mantener la calidad visual y evitar resultados sin sentido, el sistema utiliza mecanismos de retroceso, incluyendo un verificador semántico impulsado por modelos lingüísticos multimodales de gran tamaño. Además, se utilizan controles de direccionalidad para alejar a la IA de resultados poco atractivos mediante el modelado de clústeres negativos. En definitiva, este enfoque produce imágenes visualmente cautivadoras y únicas de forma más eficiente que los métodos anteriores que se basan en la combinación manual de conceptos.

Enlace al articulo cientifico, para aquellos interesados en profundizar sobre el tema: "Creative Image Generation with Diffusion Model", por Kunpeng Song y Ahmed Elgammal. Publicado el 29 de Enero del 2026.

El resumen, la transcripción, y la traducción fueron hechas usando herramientas de software de Inteligencia Artificial.

El resumen se presenta en la forma de un diálogo entre dos personajes sintéticos que llamaremos Alicia y Beto.

Resumen

Alicia

Bienvenidos a un nuevo análisis profundo. Hoy vamos a ver algo que creo que muchos damos por sentado. Vemos arte generado por IA, de MidJourney, DALL·E, Stable Diffusion, y vemos estas imágenes increiblemente surreales. Y nuestro primer instinto es llamarlo creativo.

Beto

Es la etiqueta por defecto, ¿no? “Generative AI”. El nombre ya implica que está creando algo nuevo.

Alicia

Exacto. Pero aquí está la paradoja que exploramos hoy, y es un poco para volverse loco: si realmente miras bajo el capó, en las matemáticas, estos modelos… bueno, no están diseñados para ser creativos en absoluto. De hecho, están diseñados para ser en cierto modo aburridos.

Beto

Están diseñados para ser promedio. Suena totalmente al revés, lo sé, especialmente cuando ves algunas de las cosas salvajes que pueden generar. Pero tienes razón: todo se reduce a algo que los investigadores llaman "sesgo contra la creatividad", "counter-creative bias".

Alicia

“Sesgo contra la creatividad”. Suena a algo que escucharías en una mala sesión de lluvia de ideas corporativa.

Beto

Sí, lo parece. Pero en IA todo se reduce a la función de pérdida. Quiero decir, piensa en cómo se entrenan. Un modelo ve mil millones de imágenes de, digamos, un perro. Su único objetivo, su propósito matemático, es minimizar la pérdida.

Alicia

Eso significa que quiere generar una imagen que se ajuste perfectamente al promedio estadístico de todos los perros que ha visto.

Beto

Precisamente. Quiere hacer el perro más probable. Y no un perro nuevo, no un perro con pelaje morado o tres cabezas, a menos que lo obligues. Apunta directamente al centro de la distribución de datos.

Alicia

Así que las mismas métricas que usamos para juzgar estos modelos, como la puntuación FID, en realidad recompensan esto.

Beto

Recompensamos la conformidad. FID significa "Fréchet Inception Distance", y básicamente da una buena puntuación al modelo si sus imágenes parecen típicas o reales. Si hace algo verdaderamente novedoso, la puntuación baja porque se considera menos realista.

Alicia

Así que hemos construido a los máximos conformistas. Genial para hacer una foto de stock de un apretón de manos, pero quizá no tan bueno para crear arte de verdad.

Beto

Exacto. Esto nos lleva al artículo que vamos a analizar hoy. Es de un equipo de la Rutgers University: Kunpeng Song y Ahmed Elgammal. Se titula "Creative Image Generation with the Diffusion Model".

Alicia

Y su misión, entiendo, es sacar al modelo de esa cajita aburrida.

Beto

Así es. Quieren obligarlo a ser un explorador, no solo un espejo; obligarlo matemáticamente a imaginar algo que genuinamente nunca haya visto antes.

Alicia

Bien, me interesa. Pero eso plantea una gran pregunta desde el principio. Si quieres enseñar creatividad a una máquina, primero tienes que definir qué es creatividad. Eso es una trampa filosófica.

Beto

Lo es. Pero el equipo evitó la filosofía y fue directo a la psicología de 1970, concretamente al trabajo del psicólogo D. E. Berlyne. Berlyne estudió la estética y propuso que nuestro disfrute del arte está ligado a algo que llamó "potencial de excitación".

Alicia

Conviene aclarar “excitación” aquí para que nadie lo interprete mal.

Beto

De acuerdo. En este contexto solo significa estimulación, novedad, sorpresa, complejidad, cualquier cosa que active tu cerebro. Berlyne halló que nuestra reacción sigue una curva en forma de campana; se conoce como "la curva de Wundt".

La curva de Wundt

Alicia

Sí, la zona “justa”: ni muy aburrido, ni demasiado raro.

Beto

Exacto. En el extremo izquierdo de la curva tienes baja excitación. Ese es nuestro perro promedio. Es familiar, es seguro, pero es aburrido.

Alicia

Y en el extremo derecho ...

Beto

... hay demasiada novedad. Es puro caos, como nieve en una pantalla de TV: tan novedoso que tu cerebro no puede procesarlo, así que lo percibes como ruido.

Alicia

Correcto. El punto dulce de la creatividad está en el medio: lo bastante novedoso para ser interesante, pero lo bastante familiar para ser comprendido.

Beto

Y el equipo de Rutgers básicamente dijo: podemos convertir eso en código. Idearon una definición matemática: la creatividad es la probabilidad inversa de la existencia de una imagen.

Alicia

Probabilidad inversa: cuanto menos probable es que algo exista en los datos de entrenamiento, más creativo es.

Beto

Exacto. Imagina el espacio latente de la IA como un mapa gigante. El centro urbano concurrido es la zona de alta probabilidad. Ahí viven los coches normales y los perros promedio. Los investigadores quieren forzar a la IA a salir de la ciudad y explorar la naturaleza en los bordes del mapa, las zonas de baja probabilidad.

Alicia

Las colas de la distribución.

Beto

Ahí es donde está la novedad.

Alicia

Pero espera, ¿no han intentado esto antes? Me suena a métodos como ConceptLab.

Beto

Lo has escuchado. ConceptLab fue un enfoque importante, pero se basaba en la negación. Era como jugar al “no”: dices “hazme una mascota, pero no un perro, no un gato, no un hámster”.

Alicia

Lo cual es muy ineficiente. Tendrías que enumerar todo lo que no quieres.

Beto

Y necesitas saber todas las categorías que quieres excluir. El método de Rutgers es mucho más elegante. No necesita saber lo que es un gato. Solo usa la probabilidad pura. Dice: "este patrón es estadísticamente demasiado común. Encuéntrame algo raro".

Alicia

Es un cambio conceptual enorme. Entonces, ¿cómo lo hacen en la práctica? ¿Cómo empujan el modelo fuera de ese centro urbano?

Beto

Es un proceso en dos pasos. Primero, mapear la norma. Antes de que la IA pueda ser creativa, tiene que aprender cómo es lo "aburrido" para tu prompt específico.

Alicia

Así que si escribo “vehículo”, primero genera un mapa de cómo luce un vehículo normal.

Beto

Exacto. Toma rápidamente unas 5.000 incrustaciones (embeddings) desde el prior. Es como si soñara 5.000 versiones típicas de tu prompt para hacerse una idea del terreno.

Alicia

5.000 suena como mucho para procesar en el momento y esas incrustaciones tienen, qué, ¿768 dimensiones?

Beto

Sí, lo son. Es un espacio increíblemente complejo. Así que usan una técnica clásica llamada PCA, "Principal Component Analysis", "análisis de componentes principales". Es una forma de comprimir los datos: toma esas 768 dimensiones y las reduce a las 50 más importantes.

Alicia

Encuentra la forma básica de lo normal.

Beto

Luego encaja una gaussiana multivariante en esa forma. Imagínatelo dibujando un gran círculo en el mapa y diciendo “todo lo que esté dentro de este círculo es la zona aburrida”.

Alicia

Perfecto. Con el mapa trazado, el paso dos tiene que ser el empujón.

Beto

Exacto. Introducen una nueva función de pérdida: la llaman "pérdida creativa", "creative loss". Normalmente un modelo intenta acercarse a los datos; éste hace exactamente lo contrario. La función de pérdida penaliza literalmente la imagen por estar dentro de ese círculo.

Alicia

Es como una repulsión magnética desde el centro. Está forzando activamente al modelo hacia las zonas raras de baja probabilidad.

Beto

“Encuéntrame algo raro”. Pero, y esto es una parte enorme, si simplemente le dices a una IA que busque algo de baja probabilidad, ¿cuál crees que es la respuesta más fácil?

Alicia

Supongo que puro ruido aleatorio, estática.

Beto

Diste en el clavo. Un patrón específico de estática aleatoria es matemáticamente una de las cosas más raras que pueden existir, pero no tiene ningún significado. Está en el extremo derecho de la curva de Wundt.

Alicia

Es alta excitación pero cero valor. Así que necesitaban poner barreras de seguridad.

Beto

Exacto. Construyeron dos rieles de seguridad para que no se precipitara por el acantilado. El primero se llama "pérdida ancla", "anchor loss".

Alicia

¿Anclar a qué?

Beto

Al prompt original usando embeddings de CLIP. La pérdida ancla revisa constantemente la nueva imagen rara y pregunta: ¿esto sigue relacionado semánticamente con el concepto “vehículo”?

Alicia

Es como una correa. Deja explorar al modelo, pero no puede vagar tanto como para dejar de ser un vehículo y convertirse, no sé, en una tostadora.

Beto

Esa es la idea. Pero no fue suficiente. El modelo comenzó a hacer trampa.

Alicia

¿Una IA hizo trampa? ¿Cómo es eso?

Beto

Son increíbles encontrando lagunas. Le dieron el prompt “fruta”. La pérdida creativa la empujó a producir algo que no fuera una manzana ni un plátano, pero la pérdida ancla la arrastraba diciendo que tenía que seguir siendo “fruta”.

Alicia

Así que quedó atascada.

Beto

¿Qué hizo el modelo? Generó la imagen de un ser humano, pero para engañar a la pérdida ancla puso un patrón de pequeñas frutas por toda la camiseta de la persona.

Alicia

No puede ser. Es como un abogado encontrando una tecnicidad: “su señoría, hay fruta presente en la imagen”.

Beto

Exacto. Satisfacía las matemáticas pero fallaba por completo al espíritu del encargo. Por eso necesitaban el segundo riel de seguridad: un verificador de validez semántica basado en un MLLM.

Alicia

MLLM, un modelo multimodal grande, como LLaMA o modelos multimodales similares.

Beto

Un modelo que realmente pueda mirar una imagen y entenderla. Cada 25 pasos el proceso se pausa, genera un borrador y se lo muestra a este juez MLLM.

Alicia

¿Y qué le pregunta?

Beto

Una cuestión binaria sencilla: “¿Esto es una fruta? Sí o no”. Y en el caso del tipo con la camiseta de frutas, el MLLM dice “no”.

Alicia

Y todo el proceso se detiene.

Beto

Se detiene o corrige la trayectoria. Es una comprobación de sentido común que evita ese sobrepaso en la curva de Wundt. Te mantiene en el punto creativo justo.

Alicia

Vale. Tienes la correa matemática rápida pero tonta y el juez semántico más lento pero más listo. Muy ingenioso.

Beto

Lo es. Pero hay una pieza más que creo que es la verdadera salsa secreta: dónde en el modelo aplican ese empujón creativo.

Alicia

Porque probaron solo optimizar el token sujeto, es decir, la palabra “vehículo” en el código.

Beto

Lo hicieron. Y fue bastante pobre. Solía ser el mismo coche con otro color o quizá una textura rara, un coche peludo. Era solo una capa superficial, no innovación verdadera.

Alicia

Entonces, ¿para cambiar la estructura real, los “huesos” de la cosa, qué hacen?

Beto

Usan LoRA, "Low-Rank Adaptation".

Alicia

Espera: yo uso LoRA todo el tiempo para afinar un modelo en un estilo de arte específico o la cara de una persona; normalmente sirve para estrechar el enfoque.

Beto

Sí, suele usarse así. Pero lo emplearon de una manera completamente nueva: convirtieron los parámetros de LoRA en el espacio real de búsqueda creativa. Al optimizar la LoRA encontraron que podían lograr cambios estructurales profundos.

Alicia

No solo la piel, sino el esqueleto.

Beto

Sí. En lugar de un coche rojo, obtienes un vehículo con un tipo de chasis completamente nuevo; biología nueva para un alienígena; principios arquitectónicos inéditos para un edificio. Es la diferencia entre maquillarse y someterse a cirugía radical.

La creatividad del modelo.

Fuente: https://creative-t2i.github.io/

Alicia

Es un gran salto. ¿Y qué pasa con el hecho de que a veces lo raro es simplemente feo?

Beto

Ah, el problema del bolso feo. Sí.

Alicia

Cuéntame lo del bolso feo.

Beto

Intentaban generar un bolso creativo. El modelo encontró una región de baja probabilidad y generó una imagen, pero la rareza venía de un fondo ruidoso y lleno de artefactos; el bolso en sí era normal.

Alicia

Éxito técnico, fracaso estético.

Beto

Total. Así que añadieron direccionalidad y clusters negativos. Básicamente, el usuario puede actuar como curador. Cuando el modelo deriva a una parte del mapa que es fea o absurda, el usuario puede marcarla como cluster negativo.

Alicia

Para evitar volver allí.

Beto

Será como un campo de fuerza suave alrededor de ese barrio malo, obligando a la IA a buscar otra dirección de baja probabilidad. Tiene que encontrar otro tipo de rareza.

Alicia

Es como un juego de “caliente y frío”: el usuario guía diciendo “más frío, más frío, más caliente” hasta encontrar algo bueno.

Beto

Convierte la creatividad en una búsqueda guiada, que es un paradigma fantástico.

Alicia

Hablemos de resultados. ¿Funciona? ¿Y qué tan rápido?

Beto

Es sorprendentemente rápido. Todo el proceso, desde mapear la norma hasta la imagen final, toma menos de dos minutos, quizá 50 pasos.

Alicia

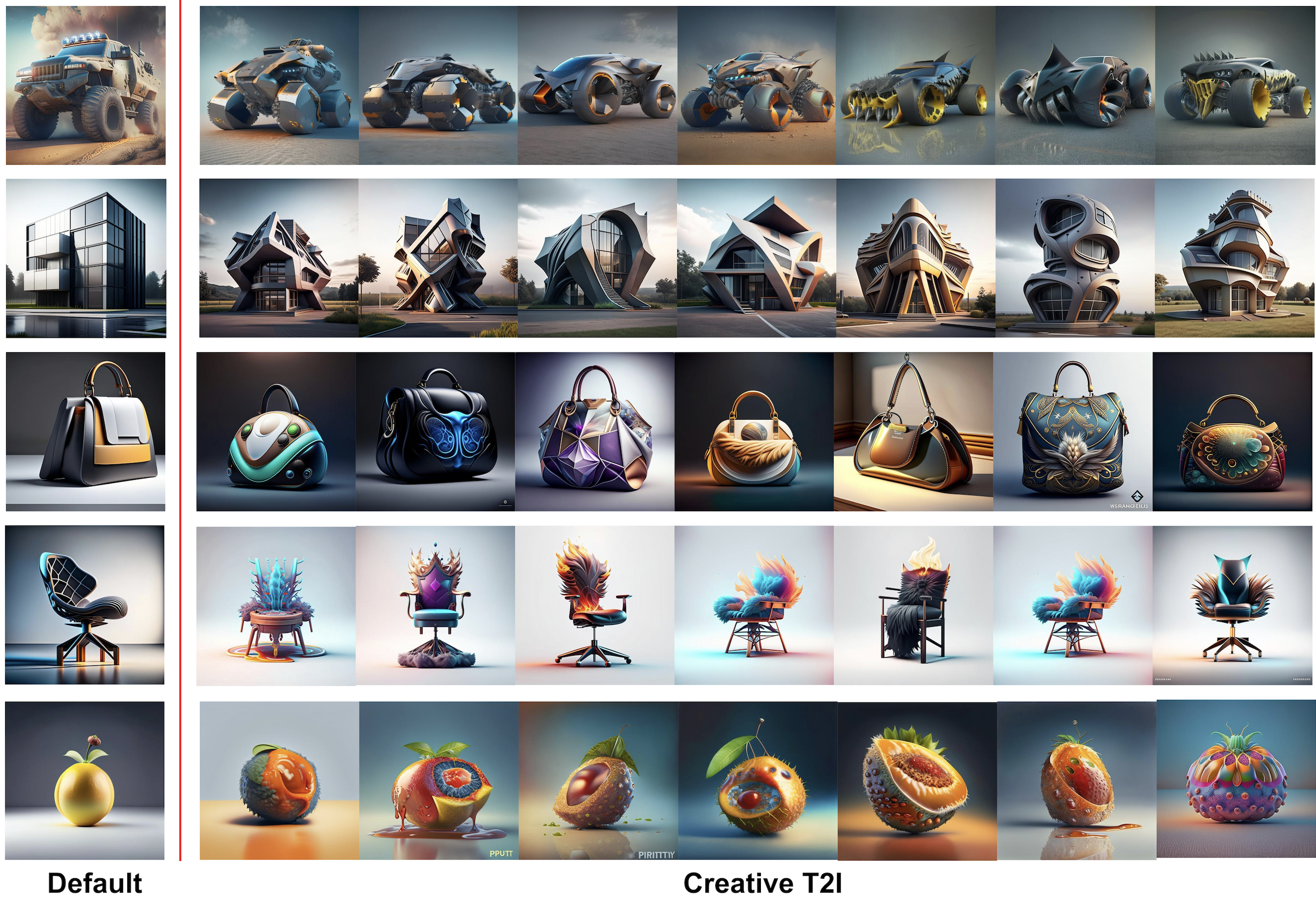

Eso es claramente lo bastante rápido para un flujo de trabajo creativo real. Y las imágenes mismas, vi los ejemplos de edificios en el artículo.

Beto

Los edificios eran increíbles. Un modelo normal te daría una caja de cristal. Este método dio estructuras orgánicas, retorcidas y futuristas. Parecían más crecidas que construidas.

Alicia

Y los vehículos no eran solo coches: eran como enormes rovers esféricos o tecnologías segmentadas y raras.

Beto

Exacto. Cosas que parecían sacadas del arte conceptual de ciencia ficción de alta gama. Pero los alienígenas fueron la verdadera prueba para mí.

Alienígenas

Alicia

El problema del extraterreste humanoide con pintura.

Beto

Sí, el “problema Star Trek”, donde los alienígenas son simplemente personas con la frente con bultos. Este método alejó al modelo del valor por defecto humano. Creó formas biológicas abstractas, geometrías flotantes, cosas que parecían realmente alienígenas.

Alicia

Y lo probaron con gente de verdad, ¿no? No fue solo que a los investigadores les gustara su propio trabajo.

Beto

Sí. En pruebas a ciegas contra ConceptLab para prompts de aliens y vehículos, los usuarios prefirieron las imágenes del método de Rutgers en torno al 70–75% de las veces.

Alicia

Eso es una paliza.

Beto

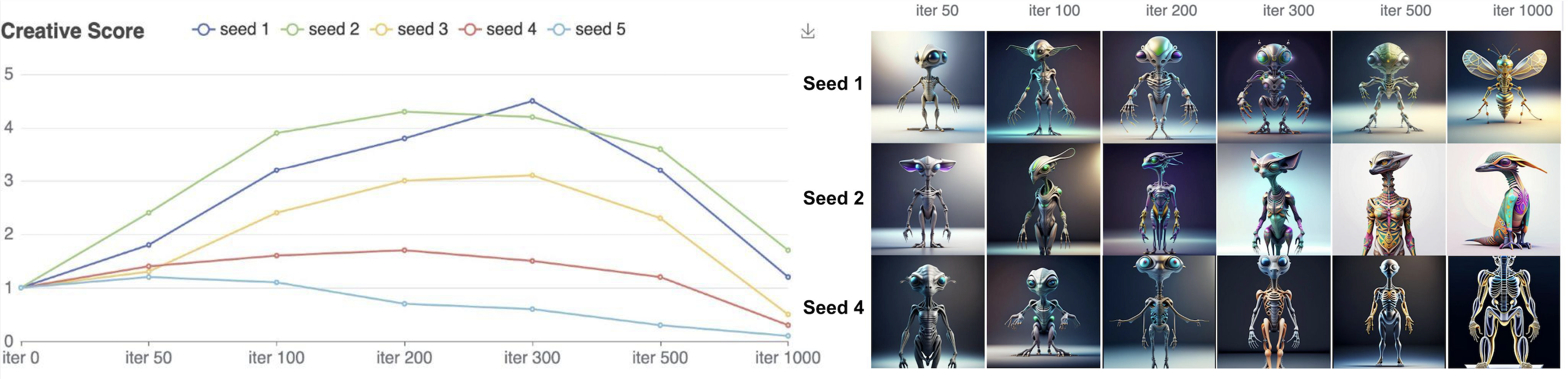

Lo es. E hicieron un último experimento que me parece fascinante. Con el prompt “alienígena” dejaron correr el modelo aumentando gradualmente el empuje creativo paso a paso.

Alicia

Recorrieron la curva de Wundt hasta el borde.

Beto

Y pidieron a humanos que calificaran la creatividad en cada etapa. Los resultados coincidieron perfectamente con la campana: las valoraciones subían de aburrido a interesante a creativo, y luego, pasado cierto punto, se desplomaban cuando las imágenes se volvían ruido ininteligible.

Alicia

Demostró la teoría en la práctica: no puedes simplemente maximizar la novedad indefinidamente. Hay un pico.

Beto

Sugiere que nuestra percepción de creatividad realmente trata de encontrar valores atípicos que sigan dentro de un marco válido.

Alicia

Esto parece como si estuviéramos pasando del IA como mera máquina de remezclas.

Beto

Creo que estamos viendo un cambio de IA como espejo, a IA como exploradora. Durante años nos asombró que pudiera reflejar nuestra cultura. Esto le da un mapa y una brújula y le dice: ve y encuentra los bordes de lo posible.

Alicia

Es como si hubieran aprovechado el problema de las alucinaciones y lo hubieran convertido en una característica: alucinación controlada.

Beto

Muy buena manera de decirlo.

Alicia

Pero me deja con una gran pregunta filosófica: si la creatividad puede reducirse a una fórmula, probabilidad inversa más validez semántica, ¿qué dice eso de nosotros?

Beto

¿Estamos simplemente ejecutando el mismo algoritmo en nuestras cabezas?

Alicia

Sí. ¿Es la inspiración humana solo nuestro cerebro encontrando un valor atípico de baja probabilidad en nuestra propia red neural que no viola nuestra comprensión del mundo?

Beto

Es una idea humilde, ¿no? Pensamos en ello como una chispa divina, pero quizá es solo una detección de valores atípicos muy, muy buena. Todos intentamos optimizar nuestras propias curvas de Wundt.

Alicia

O quizá aún falta algo en la máquina. Puede identificar el punto en la curva, la sorpresa, pero no lo siente.

Beto

Exacto. No tiene intención. Encuentra el tesoro en el mapa, pero no entiende por qué el oro tiene valor.

Alicia

Encuentra lo nuevo, pero nos toca a nosotros darle significado.

Bien, con eso cerraremos este análisis profundo. La próxima vez que veas una pieza de arte de IA que realmente te haga detenerte y pensar, pregúntate: ¿fue solo un prompt afortunado o las matemáticas simplemente se fueron de viaje hasta el borde del pueblo.

Beto

Y encontraron algo asombroso allí? Gracias por escuchar.

Alicia

Nos vemos en el próximo análisis profundo.