Esta investigación presenta un marco basado en parches, diseñado para identificar si un humano o un robot creó secciones específicas de una pintura. Al analizar escaneos de alta resolución con una red neuronal convolucional, el sistema distingue con éxito entre estilos artísticos individuales, incluso con datos de entrenamiento extremadamente limitados. El modelo alcanzó una precisión cercana al 89% en la identificación de autores a nivel de parche y clasificó correctamente al creador general de la mayoría de las pinturas completas. Más allá de la simple clasificación, el estudio utiliza la entropía predictiva para identificar regiones de "autoría mixta" donde humanos y robots colaboraron en el mismo lienzo. Estas áreas híbridas mostraron una incertidumbre significativamente mayor en el modelo, lo que proporciona un método matemático para detectar esfuerzos artísticos colaborativos. En definitiva, este trabajo ofrece una forma fiable de documentar la autoría espacial en el campo en constante evolución de las colaboraciones creativas entre humanos e IA.

Enlace al artículo científico, para aquellos interesados en profundizar en el tema: "Patch-Based Spatial Authorship Attribution in Human–Robot Collaborative Paintings", por Eric Chen y Patricia Alves-Oliveira. Publicado el 19 de Febrero del 2026.

Resumen

Beto

Imaginen este escenario. Caminan por una de esas galerías de arte de mucho nivel en París, o tal vez Tokyo.

Alicia

Oh, sí. Esas con la iluminación perfecta y el suelo de hormigón pulido.

Beto

Exacto. Los suelos que reverberan lo justo para hacerte sentir sofisticado y te detienes frente a un lienzo que te atrapa. Es abstracto, vibrante. Son esas pinceladas azules amplias y agresivas que chocan con salpicaduras rosas muy delicadas, casi vacilantes. Se siente visceral. Se siente intensamente humano.

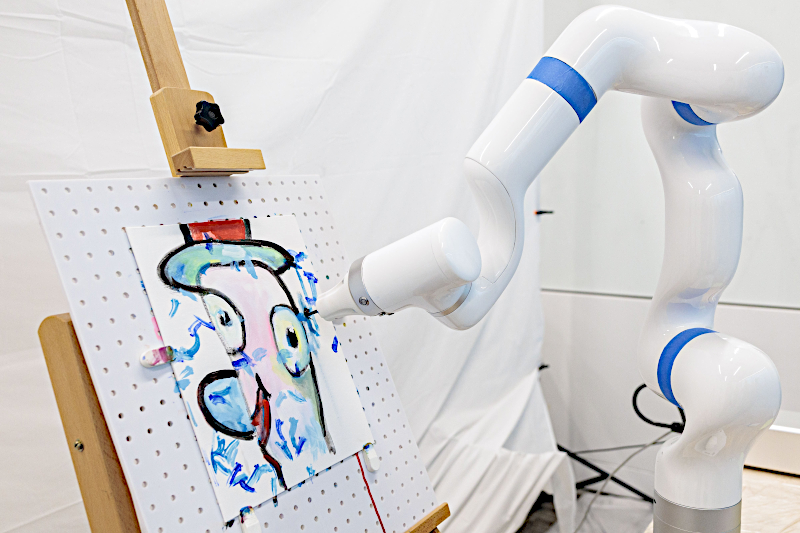

Obra colaborativa, artista humano y sistema CoFRIDA

Alicia

Me la imagino. Es el tipo de obra en la que te acercas para ver la textura de la pintura.

Beto

Sí, estás mirando cómo se apila la pintura, el arrastre de las cerdas. Y entonces lees la tarjetita blanca en la pared al lado.

Alicia

La temida ficha.

Beto

Claro. El letrero. Y dice: "Obra colaborativa, artista humano y sistema CoFRIDA". Y de repente esa conexión emocional que acababas de sentir... se complica. Porque ahora sabes que la mitad de esas pinceladas las hizo una persona viva y la otra mitad fue ejecutada por un brazo robótico de seis ejes.

Alicia

Y aquí viene lo realmente duro para cualquiera que esté allí, mirando ese lienzo con sus propios ojos: probablemente no puedas decir cuál es cuál.

Beto

Ese es exactamente el agujero de conejo en el que nos vamos a meter hoy. Vamos a explorar la frontera desordenada y fascinante de la colaboración humano–robot en el arte.

Alicia

Es un espacio salvaje ahora mismo.

Beto

Sí que lo es. Pero hoy no hablamos solo del arte en sí. Hablamos de la forense del arte. ¿Cómo pruebas realmente quién hizo qué cuando la pintura está literalmente mezclada en el mismo soporte físico?

Alicia

Es un clásico “¿quién lo hizo?” pero actualizado para la era de la IA. Y plantea preguntas increíbles sobre autoría, mecánica y lo que realmente significa pintar.

Beto

Nos basamos para este análisis en un artículo de investigación muy atractivo. Se titula "Patch-based spatial authorship attribution in human robot collaborative paintings".

Alicia

Un poco largo, pero un gran artículo.

Beto

Sin duda. Acaba de salir, publicado el 20 de febrero de 2026, por un equipo de la Universidad de Michigan: Eric Chen y Patricia Alzalovera.

Alicia

Me encanta este artículo porque aborda un problema que suena súper futurista, pero que en realidad está pasando ahora mismo en los estudios.

Beto

Sí.

Alicia

Hemos superado el viejo debate humano contra máquina, que ya conocen, como la computadora que le gana a Kasparov en ajedrez o AlphaGo. Estamos firmemente en la era del humano y la máquina.

Beto

Están trabajando juntos.

Alicia

Exacto. Están colaborando. Y cuando tienes dos entidades distintas compartiendo un lienzo físico, desenredar esa asociación es increíblemente difícil.

Beto

Claro. Porque normalmente, cuando pienso en autentificación de arte, tengo una imagen muy específica en la cabeza. Imagino a un tipo con chaqueta de tweed sosteniendo una lupa frente a un polvoriento Rembrandt.

Alicia

Buscando un patrón de craquelado en el barniz.

Beto

Exacto. O una firma oculta.

Alicia

Ese es el modelo tradicional del conocedor, y funciona con Rembrandt porque tenemos cientos de años de estudios. Sabemos exactamente cómo Rembrandt sostenía el pincel, cómo colocaba sus veladuras.

Beto

Pero si eso falla, entran los equipos de laboratorio, ¿no?

Alicia

Sí. Si necesitamos algo estrictamente científico, sacamos las armas grandes: fluorescencia de rayos X, reflectografía infrarroja, espectroscopía química.

Beto

Supongo que eso cuesta una fortuna.

Alicia

Oh, totalmente. Necesitas el presupuesto de un museo o el respaldo de una aseguradora enorme para hacer ese tipo de análisis. Es lento, caro y normalmente reservado para pinturas que valen millones.

Beto

No vas a meter un equipo de rayos X en una galería emergente local para una muestra nueva.

Alicia

No, claro que no. Y ese es el primer escollo. Si soy un artista emergente experimentando con un brazo robótico en mi garaje, no tengo acceso a ese tipo de equipamiento.

Beto

Ese es el problema de accesibilidad. Pero hay otro problema, ¿no? Los datos mismos.

Alicia

Exacto. Hay un segundo y aún mayor problema que estos investigadores identificaron: la escasez de datos.

Beto

¿Lo desglosamos?

Alicia

Pues, si quieres entrenar una IA para reconocer a van Gogh, puedes alimentarla con miles de imágenes en alta resolución. Tenemos un enorme conjunto documentado de lo que pintó van Gogh. Pero si trabajas con un robot personalizado que programaste la semana pasada, puede que tengas, no sé, apenas 10 pinturas.

Beto

No puedes entrenar una red neuronal masiva con 10 pinturas.

Alicia

No.

Beto

Sería como intentar aprender un idioma nuevo leyendo una sola nota adhesiva.

Alicia

Gran analogía, y es precisamente la pared contra la que se toparon estos investigadores. Tenían a un artista humano específico y a un sistema robótico específico.

Beto

Y querían saber: ¿quién hizo qué?

Alicia

Sí. ¿Podemos distinguir la mano del humano del brazo del robot usando solo unos pocos ejemplos? Y, de forma crucial, ¿podemos hacerlo sin el laboratorio de un millón de dólares?

Beto

Su solución propuesta es sorprendentemente de baja tecnología. O al menos el hardware es low‑tech.

Alicia

Sí. ¿Usaron un escáner de cama plana?

Beto

Un escáner como el que está sobre mi impresora en casa.

Alicia

Un escáner de cama plana de uso común. Exactamente el que probablemente tiene polvo en una oficina doméstica. Simplemente escanearon los lienzos a 1,200 DPI.

Beto

Así que nada de rayos X. No hay láseres. Solo una digitalización en alta resolución.

Alicia

Esa es la belleza. Ellos sostienen que no hace falta ver la estructura atómica del pigmento para decir la diferencia entre el humano y el robot.

Beto

¿Qué buscan entonces?

Alicia

Solo necesitas ver la textura. La topografía de la pincelada en sí contiene la respuesta si sabes cómo mirarla.

Beto

Bien, tenemos nuestra herramienta detective: el escáner. Antes de entrar en el cómo de la investigación, conozcamos a los sospechosos. ¿Quiénes son los artistas en este experimento?

Alicia

En una esquina tenemos al humano. Fue un único artista al que le dieron un tema: “aire”.

Beto

Aire, vale.

Alicia

Se les pidió crear obras abstractas basadas en eso. Mucho flujo, movimiento, toques más ligeros. No intentaban pintar una manzana realista o un paisaje. Pintaban una sensación.

Beto

¿Y en la otra esquina?

Alicia

Tenemos a CoFRIDA.

Beto

CoFRIDA.

Alicia

Significa "Collaborative FRIDA". Es un sistema de pintura robótico que usa un brazo de 6 DOF.

CoFRIDA: el Artista Robótico

Beto

¿Puedes explicar "6 DOF" para aquellos que no están en robótica?

Alicia

Seguro. Significa seis grados de libertad. Piensa en tu propio brazo. Tienes hombro, codo, muñeca y la capacidad de rotar esas articulaciones.

Beto

Entonces, es flexible.

Alicia

Muy flexible. Permite al robot acercarse al lienzo desde casi cualquier ángulo. No es rígido como una estructura tipo impresora 3D que solo va de un lado a otro. Y, crucialmente, sostiene un pincel real, sumergiéndolo en pintura acrílica real.

Beto

Así que no es una impresora de inyección de tinta dispensando pigmento sobre papel. Está arrastrando cerdas contra un lienzo texturado.

Alicia

Exacto. Crea fricción. Crea textura. Deja relieves físicos de pintura. Es un acto mecánico.

Beto

Pero, ¿cómo sabe CoFRIDA qué pintar? ¿Hace movimientos aleatorios?

Alicia

No. Usa una tubería de IA llamada "InstructPix2Pix". Básicamente toma un concepto de imagen y lo traduce en comandos motores físicos: mueve el pincel del punto A al punto B con tanta presión. Intenta ser artístico, pero lo hace mediante código y servo-motores.

Beto

Entonces tenemos a un humano y a un robot haciendo arte abstracto sobre el tema del aire. ¿Cuántas pinturas hicieron para este estudio? Porque antes mencionaste la escasez de datos.

Alicia

Aquí es donde ese problema realmente aparece. Tuvieron 15 pinturas en total.

Beto

Quince. Eso es todo. Ese fue todo el conjunto de datos.

Alicia

Siete pintadas puramente por el humano, ocho puramente por el robot. Y luego hicieron cinco pinturas híbridas donde trabajaron juntos sobre el mismo lienzo. Pero dejaremos esas de lado un momento porque no las usaron para entrenar el sistema. Los datos centrales de entrenamiento fueron esas 15 imágenes puras.

Beto

Sigo atascado con esto. ¿Cómo entrenas a un ordenador para detectar la diferencia con solo 15 imágenes? Pensé que la IA moderna necesitaba millones de puntos de datos. Como raspar todo internet.

Alicia

Y normalmente sí. Pero aquí entra la parte “patch-based” del título del artículo. Es una solución astuta para el problema de los datos. En lugar de alimentar al ordenador con la pintura completa y decir “esto es humano”, cortaron los escaneos de alta resolución en cuadritos muy, muy pequeños: parches.

Beto

Parches.

Alicia

Específicamente cuadrados de 300 por 300 píxeles.

Beto

Así que estás transformando un problema macro, la pintura completa, en un micro‑problema.

Alicia

Exacto. Al cortar esas 15 pinturas generaron más de 136,000 parches individuales.

Beto

Ah, ya veo.

Alicia

Entonces de repente ya no hay escasez de datos. Tienes un conjunto masivo de texturas.

Beto

Es como si te doy un libro y te pido identificar al autor. Si solo te doy una página quizá te cueste, pero si la corto en frases o incluso en oraciones, de repente tienes cientos de muestras de su gramática, su elección de palabras, su ritmo.

Alicia

Muy certero. Y, en este caso, la IA ni siquiera está leyendo la oración; está mirando la caligrafía.

Beto

Interesante.

Alicia

No pregunta “¿es esto una nube?”; pregunta “¿cómo se distribuyen las cerdas en este milímetro específico de pintura?”

Beto

Tienen sus ~136,000 parches. Ahora necesitan un cerebro para analizarlos. ¿Qué tipo de modelo usaron?

Alicia

Eligieron una red neuronal convolucional, CNN, específicamente una arquitectura estilo VGG.

Beto

Para quienes no sueñan en código, ¿por qué importa eso? ¿VGG es lo último?

Alicia

En realidad no. Y ese es el punto. La arquitectura VGG es relativamente compacta y especializada. En el mundo actual de la IA, el bombo está en los modelos fundacionales.

Beto

ChatGPT, Midjourney, Google Gemini, etc.

Alicia

Cerebros enormes entrenados con todo internet. Pero estos investigadores fueron por el camino contrario: fueron pequeños.

Beto

¿Por qué reducir el tamaño? ¿No sería que un cerebro más grande sería naturalmente más inteligente para esto?

Alicia

No necesariamente para esta tarea. Piensa en especialista versus generalista. Un modelo grande sabe qué es un gato, un coche, un van Gogh en términos generales. Pero por saber tanto, puede pasar por alto detalles microscópicos. Un modelo más pequeño entrenado desde cero solo con estos parches no sabe qué es un gato.

Beto

No le importa.

Alicia

No le importa la composición ni el asunto. Solo le interesan los relieves microscópicos dejados por Cofrida frente a la mano humana.

Beto

Super concentrado. No se distrae con el arte.

Alicia

Exacto. Se concentra en la ejecución motora más que en la imagen.

Beto

Quiero hablar de cómo lo probaron. Porque con solo 15 pinturas, si el ordenador memoriza “la pintura número tres es robot”, eso sería trampa. No estaría aprendiendo estilo, estaría memorizando identidad.

Alicia

Ese es el mayor riesgo en aprendizaje automático: sobreajuste. Es cuando el ordenador memoriza la clave de respuestas en vez de aprender conceptos. Para evitarlo usaron una técnica rigurosa llamada "validación cruzada dejando una pintura fuera", "leave-one-painting-out cross validation". Es un nombre largo, pero la lógica es elegante. Supongamos que tienes las pinturas 1 a 15. Cuando pruebas el modelo con la pintura 1, el modelo no ha visto ni un solo parche de la pintura 1. Solo ha estudiado parches de las pinturas 2 a 15.

Beto

Va completamente a ciegas respecto a la imagen específica que está probando.

Alicia

Va a ciegas. Tiene que confiar en las reglas generales de estilo que aprendió de las otras. No puede hacer trampa reconociendo una mancha concreta que ya vio en entrenamiento.

Beto

Debe decir “reconozco este tipo de pincelada”, no “reconozco esta pintura”.

Entonces, el momento de la verdad: ¿cómo rindió el modelo basado en escáner?

Alicia

Superó con creces su categoría. Logró 88.8% de precisión a nivel de parche. Alto. Y si agregas los votos de todos los parches para decidir quién pintó el lienzo entero, alcanzó 86.7% de precisión.

Beto

Casi el 90% usando un escáner genérico. Impresionante.

Alicia

Lo es. Y para demostrar que era realmente impresionante, lo compararon con la competencia. Ejecutaron otras dos pruebas para establecer una línea base. Primero intentaron un método clásico de análisis de textura, algo llamado LBP, "local binary patterns", patrones binarios locales, combinado con un clasificador de bosque aleatorio, "random forest". Esto es la "vieja escuela" de Machine Learning, anterior al Deep Learning.

Beto

¿Y cómo se comportó la guardia vieja?

Alicia

Fracasó. Solo alcanzó alrededor de 66% de precisión.

Beto

A duras penas mejor que lanzar una moneda.

Alicia

Exacto. Muestra que las estadísticas de textura simples no bastan; necesitas la red neuronal para encontrar patrones más profundos.

Beto

Ok, la CNN especializada mejor que lo viejo. ¿Y frente a lo nuevo? Mencionaste modelos fundacionales masivos.

Alicia

Probaron también contra DINOv2. DINOv2 es un enorme y poderoso modelo de visión por computadora desarrollado por Meta, entrenado con 142 millones de imágenes. Es una bestia. Diseñado para entender todo en una imagen.

Beto

Literalmente, David Contra Goliat.

Alicia

Y David ganó. DINOv2 solo llegó a cerca de 84.7% de precisión.

Beto

Espera. ¿El modelo entrenado con 15 pinturas le ganó al modelo de Meta entrenado con 142 millones?

Alicia

Sí.

Beto

¿Cómo es posible? Se siente completamente contraintuitivo.

Alicia

Vuelve a la idea generalista versus especialista que comentamos. Dyno V2 está entrenado para reconocer características semánticas: objetos, formas, rostros. Mira el contenido de la imagen. Pero el modelo personalizado de los investigadores miraba la sintaxis, la ejecución motora.

Beto

Buscaba la “memoria muscular”.

Alicia

Un robot se mueve de forma distinta a un humano. Incluso el brazo robótico más avanzado tiene limitaciones mecánicas: engranajes, junturas que giran y fricciones, aplica presión de manera muy consistente y repetible.

Beto

En cambio, la mano humana es desordenada.

Alicia

Somos máquinas biológicas: temblores, pulso sanguíneo, cansancio. Nuestra muñeca tiene una flexibilidad y una fluidez que un servomotor aún no replica. El modelo pequeño se ancló en esas firmas motoras. El grande estaba demasiado ocupado intentando determinar si la pintura parecía una nube para notar el temblor microscópico en la aplicación de la pintura.

Beto

Fascinante distinción. Valida la idea de que dejamos una huella física en todo lo que hacemos, incluso cuando pintamos abstracto. El robot pinta con matemáticas y nosotros pintamos con biología.

Alicia

Sí, pero aquí la historia se pone aún más interesante. Hemos establecido que el modelo puede distinguir humano y robot cuando pintan por separado. Pero el título del artículo es “pinturas colaborativas”.

Beto

Exacto. Veamos las obras híbridas. Las cinco pinturas donde se turnaron en el mismo lienzo, el escenario del principio con las remolinos azules y salpicaduras rosas.

Alicia

Recuerda: el modelo nunca fue entrenado con pinturas híbridas.

Beto

No en absoluto.

Alicia

Tiene una visión binaria: piensa que el universo está hecho de dos cosas: humano o robot. No sabe que “ambos” es una opción.

Beto

¿Qué pasa si le muestras un parche en el que el humano pintó un fondo y el robot trazó una línea dura encima? ¿Se rompe? ¿Lanza una moneda?

Alicia

No se rompe, pero se pone nervioso. Los investigadores miraron una métrica llamada "entropía".

Beto

Entropía. En física significa desorden. ¿Qué significa en IA?

Alicia

En IA puedes pensar en entropía como incertidumbre. Si el modelo mira un parche y dice “99% humano”, la entropía es baja. Está seguro. Pero si dice “51% humano y 49% robot”, la entropía es alta. Está básicamente lanzando una moneda.

Beto

Midieron cuánta confusión tenía la IA al mirar las pinturas colaborativas.

Alicia

Y las cifras fueron contundentes. Los parches de las pinturas colaborativas mostraron un 64% más de incertidumbre comparado con las pinturas puras. El valor p fue 0.003, lo que para los no estadísticos significa que esto no es casualidad, es altamente significante, estadísticamente..

Beto

El modelo miraba esas zonas mixtas y esencialmente gritaba “no sé qué estoy viendo”.

Alicia

Sí. De hecho, el 33% de los parches híbridos dispararon alta entropía, comparado con solo alrededor del 16% de los parches puros.

Beto

Normalmente, cuando una IA dice “no sé”, lo vemos como un fallo. Queremos que sea segura, que diga la respuesta exacta.

Alicia

Pero aquí los investigadores dieron la vuelta al argumento: la confusión es la señal.

Beto

Oh, es una jugada brillante.

Alicia

La alta entropía es la herramienta de detección.

Beto

Porque el modelo detecta características de ambos agentes simultáneamente y entra en este estado matemático de ambigüedad. Si eres analista forense escaneando un cuadro y tu medidor de incertidumbre se dispara en rojo, ...

Alicia

... esa es tu bandera: ahí ocurrió la colaboración. Eso marca espacialmente la autoría al identificar los límites donde uno termina y el otro empieza, o donde se fusionan.

Beto

Usan la propia limitación de la IA para encontrar la verdad. Es una característica, no un error.

Alicia

Exacto. Valida que, aunque los estilos sean distintos, su solapamiento físico crea una tercera categoría, una textura híbrida matemáticamente distinta de cualquiera de los padres.

Beto

Un poco de zoom hacia atrás: esto es ciencia excelente. ¿Pero por qué importa al oyente de este deep dive ahora mismo? Aparte de ganar una trivia muy específica, ¿por qué necesitamos saber quién pintó cada centímetro cuadrado de un lienzo?

Alicia

Hay dos grandes motivos y van a volverse muy relevantes muy rápido: el mercado y la ley.

Beto

Empecemos por la ley. Derecho de autor. Actualmente, la Oficina de Copyright de EE. UU. ha tomado una postura bastante rígida: las obras generadas puramente por IA no pueden ser protegidas por copyright; requieren autoría humana. Pero estamos entrando en una zona gris. Si yo pinto el 60% del lienzo y mi robot pinta el 40%, ¿yo tengo el copyright?

Beto

¿O tengo solo el 60%? ¿O nadie lo tiene?

Alicia

Exacto. Se complica mucho. Poder mapear el lienzo y crear un mapa topográfico literal de autoría podría convertirse en una necesidad legal. Tal vez necesites probar, en un juicio, “yo pinté la cara; el robot solo hizo el fondo”.

Beto

Esta tecnología te da la evidencia para eso. Es como una prueba de paternidad para el arte: tú eres el padre de esta pincelada.

Alicia

Gran manera de decirlo. Y luego está el mercado. El mercado del arte está obsesionado con la procedencia.

Beto

La historia detrás de la obra.

Alicia

Hay una gran diferencia de valor entre “usé un robot como herramienta” y “el robot lo hizo todo y yo solo firmé”.

Beto

Los coleccionistas quieren saber por qué pagan.

Alicia

A medida que los artistas empiecen a usar más estas herramientas, y ya lo están haciendo, necesitaremos una forma de verificar el proceso. Este método, por ser tan eficiente en muestras, sugiere un futuro donde los propios artistas pueden entrenar sus verificadores.

Beto

Dijiste que solo tomó 15 pinturas. No necesitas un archivo histórico masivo. Puedes documentar tu propio proceso en el estudio.

Alicia

Democratiza la autenticación. Necesitas un escáner estándar y una GPU decente, no un laboratorio universitario. Puedes crear una huella digital de tu colaboración con tu robot específico.

Beto

Pero hay una pega, ¿verdad? El paper menciona que el modelo fue específico para esta pareja: este humano y este robot CoFRIDA.

Alicia

Sí, esa es la limitación principal. Los robots tienen firmas al igual que las personas. CoFRIDA se mueve con engranajes y motores específicos. Si lo cambias por un brazo industrial QK o una máquina trazadora de pluma, el comportamiento motor cambia por completo.

Beto

No puedes tomar el modelo entrenado en CoFRIDA y usarlo para autenticar una obra hecha por otro robot.

Alicia

No. Tendrías que reentrenar el modelo. Pero la metodología, el análisis basado en parches y la comprobación de entropía, es universal. El marco aguanta.

Beto

Quiero volver a algo que tocaste antes: dijiste que las firmas robóticas derivan de limitaciones mecánicas. El robot es demasiado perfecto, demasiado repetible.

Alicia

Incluso cuando se programa para ser “salvaje”, es salvaje dentro de un marco matemático estricto; le falta el ruido biológico.

Beto

Pero la robótica evoluciona muy rápido: estamos viendo robótica blanda, músculos artificiales, actuadores biomiméticos, sistemas diseñados para tener esa comformidad blanda de la biología.

Alicia

Esa es la gran pregunta sobre la mesa.

Beto

Si construyo un robot que tiembla, que duda, que tiene variabilidad, ¿este análisis deja de funcionar?

Alicia

Es una carrera armamentista. Ahora mismo existe una brecha entre imagen y movimiento. Un robot puede hacer una imagen que desde cinco metros parezca humana, pero bajo el microscopio el movimiento lo delata.

Beto

Pero a medida que cerremos esa brecha, y los robots empiecen a moverse como biología en lugar de geometría, ...

Alicia

... ese hueco de incertidumbre podría desaparecer. Si un robot aprende a pintar con las mismas imperfecciones físicas que un humano, si replica el temblor, la presión variable, las vacilaciones, entonces la entropía podría no dispararse.

Beto

Vaya.

Alicia

Podríamos perder la capacidad de diferenciarlos, incluso con un microscopio.

Beto

Eso es a la vez aterrador y alucinante. Nos forza a preguntarnos: si el movimiento físico es idéntico, ¿es la autoría también idéntica?

Alicia

Preguntas profundas surgidas de un estudio sobre 15 pinturas. Pero eso hace la buena ciencia: parte de datos pequeños y abre implicaciones enormes.

Beto

Para terminar: ¿cuáles son las conclusiones principales?

Alicia

Primero, aprendimos que no necesitas "big data" para resolver problemas complejos si descompones las imágenes en parches. Puedes convertir un problema de escasez de datos en una solución con abundancia de datos. Es un hack brillante.

Beto

Segundo, aprendimos que el pequeño puede ganarle al gigante: un modelo especializado y pequeño superó a un modelo fundacional masivo porque se enfocó en el “cómo”, las habilidades motoras, en vez del “qué”, la imagen. A veces menos es más.

Alicia

Y por último, aprendimos que en la era de la colaboración la incertidumbre es una característica. Cuando una IA se confunde, no está fallando: está revelando la complejidad del mundo. Nos muestra exactamente dónde se intersectan humano y máquina.

Beto

Es una mirada fascinante a la forense del futuro. Dan ganas de ir a una galería y llevar una lupa.

Alicia

Y un escáner de cama plana, si te dejan enchufarlo.

Beto

Seguro que a seguridad le encantaría eso. "Disculpe señor, sólo necesito escanear a Picasso un momento".

Alicia

Diles que es por la ciencia.

Beto

Antes de despedirnos, una última idea provocadora para masticar: pasamos todo este tiempo hablando de robots que imitan el movimiento humano. ¿Y si ocurre lo inverso? A medida que trabajemos más cerca con máquinas, colaborando en lienzo y en código, ¿empezarán los artistas humanos a imitar inconscientemente los movimientos eficientes y repetibles de sus colaboradores robóticos?

Alicia

Es una idea interesante.

Beto

¿Nos robotizaremos como artistas?

Alicia

Algo para pensar.

Beto

Definitivamente. Gracias por acompañarnos en este recorrido. Nos vemos en el próximo análisis profundo.