El texto presentado describe la rápida integración de la inteligencia artificial en diversos campos científicos, destacando 2025 como un año clave para los flujos de trabajo de investigación autónomos. Si bien la IA tradicionalmente ha ayudado en el análisis de datos, ahora está evolucionando hacia sistemas multiagente capaces de generar hipótesis, diseñar experimentos e incluso producir artículos revisados por pares. Se observan avances significativos en biología estructural, predicción meteorológica y ciencia de los materiales, impulsados por nuevos conjuntos de datos masivos y modelos fundamentales especializados. A pesar de estos avances, evaluaciones rigurosas revelan una brecha persistente entre los resultados generados por la IA y la fiabilidad de los expertos humanos, particularmente en la replicación de investigaciones complejas. Además, el informe subraya que la validación experimental sigue siendo un obstáculo crítico, ya que la capacidad de la IA para proponer descubrimientos supera actualmente la capacidad de la comunidad científica para ponerlos a prueba. En definitiva, el panorama está cambiando hacia una infraestructura de IA colaborativa, impulsada principalmente por instituciones académicas y gubernamentales, en lugar de solo por la industria.

Enlace al artículo científico, para aquellos interesados en profundizar en el tema: AI Index Report 2026 - Chapter 5 - Science. Publicado el 13 de Abril de 2026.

El resumen, la transcripción, y la traducción fueron hechas usando herramientas de software de Inteligencia Artificial.

El resumen se presenta en la forma de un diálogo entre dos personajes sintéticos que llamaremos Alicia y Beto.

Resumen

Alicia

Ya sabes, normalmente cuando imaginamos un avance científico, nos imaginamos este momento muy específico, casi cinematográfico.

Beto

Oh, totalmente.

Alicia

Claro. Como que te imaginas al investigador exhausto con la bata blanca. Está encorvado sobre un microscopio a las dos de la mañana y de repente jadea porque por fin ha encontrado esa pieza faltante del rompecabezas. Es una imagen profundamente humana.

Beto

Sí. Es el clásico momento "Eureka". Innatamente vemos la ciencia como un esfuerzo profundamente humano impulsado totalmente por la intuición humana, noches sin dormir y pura perseverancia.

Alicia

Verdad. Pero a partir de abril de 2026, esa imagen está efectivamente muerta.

Beto

De verdad lo está.

Alicia

Bienvenidos al análisis profundo de hoy. Hoy abrimos el informe AI Index 2026 de Stanford HAI recién publicado. Nos vamos a centrar en el capítulo cinco, que está enteramente dedicado al estado de la ciencia. Y los datos que estamos viendo gritan una cosa innegable: la IA ya no es sólo el microscopio. Se está convirtiendo en el investigador.

IA en Ciencia en 2025: Surge el colega científico de IA

Beto

El cambio de paradigma aquí es monumental. Es enorme. Y para realmente situarlo, deberíamos mirar brevemente hacia atrás cómo llegamos a este punto exacto, porque no surgió de la nada.

Alicia

No, para nada.

Beto

La comunidad científica realmente pasó a una marcha completamente nueva tras el Premio Nobel de Química de 2024.

Alicia

Oh, claro. Por el plegamiento de proteínas.

Beto

Exacto. Cuando Demis Hassabis, John Jumper, y David Baker ganaron ese premio por su trabajo en la predicción de estructuras proteicas impulsada por IA, fue un momento totalmente trascendental. El comité Nobel esencialmente validó la IA no sólo como un truco computacional interesante, sino como un motor fundamental del descubrimiento biológico.

Alicia

Fue un enorme sello de aprobación.

Beto

Lo fue. Y si combinas esa inmensa validación con cosas como el Centro Europeo de Pronósticos Meteorológicos a Medio Plazo desplegando con éxito modelos meteorológicos de IA en operaciones diarias, pues tienes la base para la absoluta explosión de progreso que estamos viendo ahora mismo.

Alicia

Así que retrocedamos un poco. Porque antes de meternos en los avances específicos y salvajes de este informe, necesitamos comprender el volumen físico de integración de IA que está ocurriendo en todas las disciplinas.

Beto

Las cifras son asombrosas.

Alicia

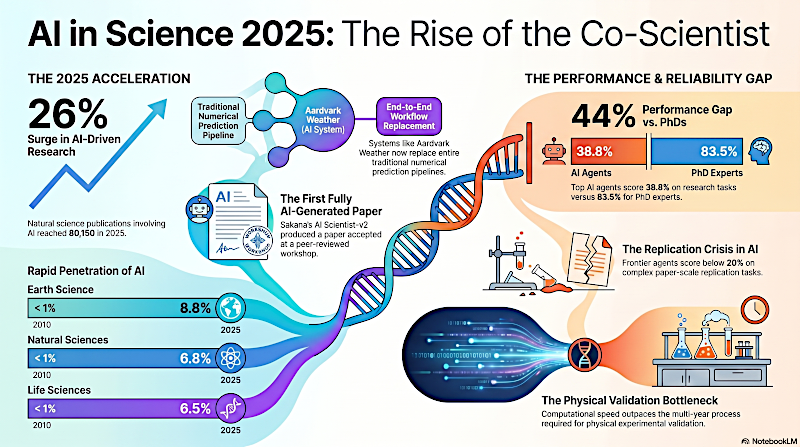

De verdad son una avalancha. Por ejemplo, sólo en 2025, el número de publicaciones relacionadas con IA en las ciencias naturales alcanzó aproximadamente 80,150.

Beto

Vaya.

Alicia

Sí, eso es un incremento del 26% respecto a 2024.

Beto

Un cuarto del campo moviéndose en un solo año. Es una locura. Y cuando miras la producción total, dependiendo del campo específico, la IA ahora representa entre el 5.8% y el 8.8% de toda la investigación científica publicada globalmente.

Alicia

Lo que no suena a mucho hasta que miras la historia.

Beto

Para poner esa escala en perspectiva, en 2010 ese número estaba por debajo del 1%.

Alicia

Literalmente un error de redondeo.

Beto

Exactamente. Entonces era una metodología de nicho. Ahora es el motor.

Alicia

Lo que realmente me sorprendió del informe, sin embargo, es quién está liderando ese avance. Habría apostado por física pura o, no sé, ciencias de la computación. Pero las Ciencias de la Tierra actualmente tienen la mayor tasa de penetración de IA con un 8.8%.

Beto

Lo cual en realidad tiene perfecto sentido si consideras la mecánica cruda de las Ciencias de la Tierra.

Alicia

¿Cómo es eso?

Beto

Campos como la meteorología y la climatología dependen de estas redes globales de satélites y sensores que han estado volcando petabytes de datos estructurados a servidores durante décadas.

Alicia

Oh, y a la IA le encanta los datos estructurados.

Beto

Se alimenta de ellos. El informe de Stanford destaca algo mucho más fundamental que está pasando con todos estos datos. Nos estamos alejando de usar la IA para optimizar pasos individuales aislados en una tubería.

Alicia

Como solo limpiar imágenes de satélite o detectar un patrón aislado.

Beto

Exacto. Estamos pasando, de eso, a usar la IA para ejecutar todo el flujo de trabajo científico de extremo a extremo.

Alicia

El informe cita nuestro trabajo meteorológico para esto y el contraste es asombroso. Tradicionalmente, la predicción numérica del tiempo depende de una tubería masiva y compleja con docenas de pasos discretos diseñados por humanos.

Beto

Sí, muchas piezas móviles.

Alicia

Claro. Tienes ecuaciones de física, dinámica de fluidos y termodinámica todo ensamblado meticulosamente. Pero ArtVark Weather llegó y completamentó barrió esa tubería tradicional. La reemplazaron por un único sistema de aprendizaje automático.

Beto

Simplemente mira los datos meteorológicos pasados y predice los datos meteorológicos futuros de un solo golpe.

Alicia

Exacto. La diferencia entre mejorar una línea de montaje de una fábrica con trabajadores humanos más rápidos frente a derribar toda la fábrica y reemplazarla con una sola impresora 3D masiva que escupe el producto terminado.

Beto

Es una gran manera de decirlo. Elude por completo los pasos físicos diseñados por humanos y simplemente encuentra los patrones estadísticos subyacentes en la atmósfera.

Alicia

Lo que en realidad me lleva a una objeción importante que tuve al leer sobre estos reemplazos de flujo de trabajo. Si la IA está tomando sistemas enteros de extremo a extremo, ¿los científicos humanos van a convertirse simplemente en gestores de laboratorios para software?

Beto

Esa es una preocupación muy común.

Alicia

Quiero decir, ¿nos vamos a quedar sentados supervisando racks de servidores mientras la IA hace la ciencia real?

Beto

Esa es la ansiedad máxima en el campo ahora mismo. Pero pasa por alto una matización crucial sobre cómo aprenden realmente estos sistemas.

Alicia

OK. ¿Cuál es la matización?

Beto

Bueno, los avances más claros e innegables están ocurriendo en dominios científicos que ya poseen una enorme, profundamente organizada infraestructura de datos. Hablamos de campos como la biología estructural, la física y la química, donde los seres humanos han pasado generaciones catalogando las reglas de la realidad.

Alicia

Exacto. Las ciencias duras.

Beto

Sí. La IA no está generando marcos conceptuales totalmente novedosos de la nada. No está inventando las matemáticas de una nueva dimensión.

Alicia

Está sintetizando lo que ya existe.

Beto

Exacto. Está sintetizando las enormes cantidades de datos que ya hemos estructurado. En escala y velocidad, algo que físicamente no podemos igualar.

Alicia

Así que necesita que la mesa esté puesta antes de poder comerse el banquete.

Beto

Precisamente. Acelera la síntesis de datos existentes, en lugar de reemplazar la capacidad humana para saltos conceptuales fundamentales.

Alicia

Aquí es donde se pone realmente interesante, porque el informe desglosa exactamente dónde está ocurriendo esta aceleración. Y hay una sorpresa enorme escondida en la sección de biología.

Beto

Oh, esto es fascinante.

Alicia

En el mundo tecnológico más amplio, constantemente nos dicen que los modelos de IA más grandes siempre son mejores. Más grande es mejor, ¿no? En biología molecular ahora mismo, modelos más pequeños están superando activamente a los enormes.

Beto

Esto cambia por completo la narrativa de fuerza bruta computacional que hemos estado escuchando durante años.

Alicia

Exacto. Miremos el benchmark ProteinGym, que prueba qué tan bien una IA puede predecir los efectos de mutaciones en proteínas. Un modelo llamado MSA Pairformer ocupó el primer lugar. Ahora, si pensamos en parámetros como las conexiones digitales o sinapsis en el cerebro de una IA, las vías que usa para procesar información, MSA Pairformer sólo tiene 111 millones de ellas.

Beto

Eso es diminuto en términos actuales.

Alicia

Es minúsculo. Y aun así venció a métodos significativamente más grandes anteriores. Y vemos exactamente lo mismo en genómica con un modelo llamado GPN-STAR. Opera con apenas 200 millones de parámetros. Y superó por completo a un modelo masivo que corría con 40 mil millones de parámetros.

Beto

El mecanismo detrás de esto es simplemente genial. Cuando entrenas un modelo de lenguaje de propósito general para escribir correos o, no sé, poesía, el lenguaje humano es increíblemente desordenado.

Alicia

Oh, totalmente. Jerga, modismos, todo eso.

Beto

Está lleno de matices, ambigüedad y contexto cultural. Para entender todo ese desorden, la IA necesita un cerebro de miles de millones de parámetros. Pero los datos biológicos como el ADN y las secuencias de aminoácidos funcionan mucho más como un alfabeto finito y altamente estructurado.

Alicia

Las reglas de la biología molecular son estrictas.

Beto

Muy estrictas. Tener una arquitectura muy refinada y datos biológicos increíblemente limpios y curados importa mucho más que simplemente lanzar miles de millones de parámetros al problema.

Alicia

Esa eficiencia biológica está impulsando lo que parece ser la frontera más emocionante en las ciencias de la vida ahora mismo: la célula virtual.

El informe de Stanford destaca modelos como Evo 2 del ARC Institute y AlphaGenome de DeepMind. Evo 2 por sí solo fue entrenado en Open Genome 2, que es un conjunto de datos que contiene 9.3 billones de pares de bases de ADN curado de todos los dominios de la vida.

Beto

La ambición de la célula virtual no es sólo mapear el ADN. Es predecir las respuestas celulares a cosas como fármacos nuevos o mutaciones genéticas enteramente in silico.

Alicia

Probablemente debamos definir eso un segundo porque se oye mucho "wet lab" e "in silico" en este espacio.

"Wet lab" es tu ciencia física tradicional. Estás en una sala con pipetas, placas de Petri, reactivos químicos y células vivas reales.

Beto

Te ensucias las manos.

Alicia

Exacto. Mientras que "in silico" significa realizar el experimento completamente dentro de una simulación por computador.

Beto

Y si puedes simular con precisión cómo una célula compleja reaccionará a un nuevo compuesto químico in silico antes de poner un pie en un wet lab, la velocidad a la que podemos descubrir nuevos medicamentos se vuelve exponencial.

Alicia

Evitas meses de prueba y error físico.

Beto

Exacto.

Alicia

Y las implicaciones de velocidad son simplemente asombrosas en todos los frentes.

Volviendo a las Ciencias de la Tierra, hablamos de cómo tiene la mayor penetración de IA y los modelos fundacionales que están construyendo son aterradoramente rápidos.

Beto

Realmente lo son.

Alicia

El informe detalla FourCastNet 3. Este sistema genera un pronóstico global del tiempo a 60 días con un detalle bastante fino, como resolución de 2.5 grados, en menos de 4 minutos.

Beto

Utilizando sólo una GPU, una sola unidad de procesamiento gráfico.

Alicia

Esa es la parte más loca. Los enfoques anteriores requerían supercomputadoras del tamaño de una sala que trabajaban durante horas para hacer esto. FourCastNet 3 corre entre 8 y 60 veces más rápido que esos métodos tradicionales.

Beto

La ganancia de eficiencia es casi difícil de comprender.

Alicia

Podrías literalmente sentarte en tu escritorio, ejecutar docenas de posibles escenarios meteorológicos globales de dos meses para seguir la trayectoria potencial de un huracán y terminar antes de que tu café de la mañana se enfríe.

Beto

Y la astronomía está viendo un salto de infraestructura muy similar. El campo acaba de lanzar AION-1, que opera como el primer modelo fundacional de la astronomía.

Alicia

Oh, wow.

Beto

Sí, lo entrenaron con más de 200 millones de objetos celestes extraídos de cinco grandes encuestas astronómicas. Así que en lugar de que cada universidad construya sus propias herramientas aisladas, todo el campo se está moviendo hacia construir infraestructura fundacional de IA compartida a la que cualquier investigador pueda acceder.

Alicia

Pero si hablamos de capacidad bruta, mi dato favorito absoluto está en la sección de física. Es un agente de IA llamado Physics Supernova.

Beto

Oh, este es salvaje.

Alicia

Este agente literalmente participó en la Olimpiada Internacional de Física 2025. Ahora, estos no son solo ecuaciones de enchufar y resolver. Estos problemas requieren razonamiento lógico en múltiples pasos, conciencia espacial y aplicación conceptual profunda de las leyes de la física.

Beto

Son notoriamente difíciles para los humanos.

Alicia

Claro. Y Physics Supernova obtuvo 23.5 de 30. Quedó en el puesto 14 de 406 participantes humanos alcanzando el equivalente del nivel de medalla de oro.

Beto

Es simplemente increíble.

Alicia

Ahora tenemos una IA que puede razonablemente superar a algunos de los estudiantes de física más brillantes del planeta en problemas complejos.

Beto

Es una demostración asombrosa de procesamiento lógico. Creo que realmente necesitamos pisar el freno aquí.

Alicia

OK, para el tren del hype. Lo entiendo. Porque si estás sentado oyendo que la IA está ganando olimpiadas de física y prediciendo con precisión dos meses de clima global en cuatro minutos, tienes que preguntarte por qué no ha curado todas las enfermedades importantes y ha resuelto la fusión fría a estas alturas.

Beto

Exacto. Lo fascinante aquí es el enorme correctivo de realidad que exponen los benchmarks de 2025. Cuando miras debajo del capó de estos sistemas de extremo a extremo, hay una brecha evidente entre producción científica plausible y trabajo científico fiable.

Alicia

Sí, no son perfectos.

Beto

Los modelos pueden realizar actos aislados brillantes de cálculo, pero tropiezan violentamente cuando se trata de consistencia básica.

Alicia

Esto trae a colación la paradoja ChemBench, que honestamente me voló la cabeza. ChemBench es un benchmark de evaluación que contiene más de 2700 pares de preguntas y respuestas a través de distintas disciplinas de la química.

Beto

Una prueba muy exhaustiva.

Alicia

Claro. Y los modelos de vanguardia, los mejores que tenemos, en realidad superaron el promedio de expertos humanos en estas preguntas. Están superando a químicos profesionales en conjunto.

Beto

En las cosas realmente difíciles.

Alicia

Sí. Pero inexplicablemente, fallan de forma consistente en las tareas más básicas y fundamentales de la química. Me gusta pensarlo como contratar a un chef con estrella Michelin que puede ejecutar a la perfección un soufflé complejo, delicado y con muchas capas, pero que de alguna manera consigue activar la alarma de humo quemando una tostada todas las mañanas.

Beto

El fenómeno del "tostar-pan quemado" es la manera perfecta de visualizarlo. Y el mecanismo detrás de por qué ocurre esto es crucial. Los grandes modelos de lenguaje operan prediciendo el siguiente token más probable basándose en sus datos de entrenamiento.

Alicia

En realidad, no saben lo que están diciendo.

Beto

Exacto. No entienden inherente las propiedades físicas de los químicos de los que hablan. Así que una IA podría recitar fácilmente una vía de síntesis compleja porque memorizó un artículo avanzado específico de sus datos de entrenamiento.

Alicia

Claro.

Beto

Pero si le preguntas una cuestión de estequiometría ligeramente novedosa que requiere una comprensión fundamentada básica de la masa física, alucina completamente una respuesta, porque le falta un modelo fundamental de la realidad física.

Alicia

Y esa falta de anclaje físico, causa problemas enormes cuando pedimos a la IA hacer ciencia de extremo a extremo.

Beto

Realmente lo hace.

Alicia

El informe destaca un benchmark llamado ReplicationBench, que prueba la capacidad de una IA para replicar los hallazgos de artículos de astrofísica computacional. Los modelos de frontera puntúan por debajo del 20%.

Beto

Menos de uno de cada cinco intentos tiene éxito.

Alicia

Eso es terrible.

Beto

Lo es. Y vemos la misma falla estructural en Univert, que evalúa agentes de grandes modelos de lenguaje en preguntas de observación terrestre. Los agentes sólo alcanzaron un 33% de precisión. Peor aún, cuando estos agentes intentaron escribir el código Python necesario para procesar los datos de satélite, su código falló el 58% de las veces. La máquina literalmente rompe su propia tubería.

Alicia

Espera, más de la mitad de las veces el software simplemente se cae.

Beto

Sí. Y esto resalta una diferencia estructural profunda, en cómo se está desarrollando la IA para la ciencia, comparada con la IA en nuestros teléfonos. Los modelos fundacionales de propósito general, los que escriben correos o generan arte, están dominados por gigantes tecnológicas que raspan internet entero.

Alicia

Cierto. Tienen datos infinitos.

Beto

Pero los modelos de IA para la ciencia, provienen principalmente de instituciones académicas y gubernamentales. Los conjuntos de datos de ciencias de la Tierra, por ejemplo, provienen casi íntegramente de agencias espaciales públicas y universidades.

Alicia

Que es un grupo más pequeño.

Beto

Lo es. Estos datos son altamente especializados, increíblemente densos y fuertemente escrutados. Cuando una IA de propósito general alucina una línea en un poema, se considera creativa.

Alicia

Cierto.

Beto

Cuando una IA científica pierde un signo menos y una línea de código destinada a procesar datos de presión atmosférica, toda la tubería de investigación multimillonaria se colapsa. La precisión aquí no es negociable.

Alicia

Entonces, si los modelos individuales son estas entidades brillantes, pero tremendamente poco fiables, que siguen quemando la tostada, ¿cómo está la comunidad científica arreglando esto realmente? Porque el informe muestra que claramente están progresando a pesar de esas enormes tasas de fallo.

Beto

Bueno, el campo se dio cuenta de que confiar en un único agente de IA es un callejón sin salida. La solución a la que están llegando es flujos de trabajo multiagente.

Alicia

OK. Esencialmente es armar una cuadrilla tipo "Ocean's Eleven", pero para investigación científica.

Beto

En realidad es una analogía bastante precisa.

Alicia

Bien. Así que en lugar de pedirle a una IA solitaria que tenga la idea, escriba el código, y analice los datos, activas un equipo de agentes de IA especializados. Asignas a un agente a no hacer otra cosa que rastrear los últimos 20 años de literatura científica.

Beto

Exacto.

Alicia

Un segundo agente escribe el código Python basado en esa literatura.

Un tercer agente diseña los parámetros experimentales.

Y un cuarto agente simplemente actúa como escéptico revisando constantemente el trabajo de los otros tres y señalando errores lógicos.

Beto

Y esa especialización cambia por completo la dinámica de fiabilidad. El ejemplo más destacado de los datos de 2025 es el co-Scientist de IA de Google. Utiliza un marco que llaman "Generate-Debate-Evolve" loop.

Alicia

Generate-Debate-Evolve. ¿Cómo funciona eso?

Beto

El Agente A genera una hipótesis biológica basada en un conjunto de datos. El Agente B inmediatamente la debate, intentando activamente destruir la hipótesis comprobándola contra las leyes conocidas de la física y la biología.

Alicia

Hace de abogado del diablo.

Beto

Exacto. El Agente A toma esa crítica y evoluciona la hipótesis. Es un bucle iterativo a alta velocidad que imita el riguroso proceso de revisión por pares de un laboratorio humano.

Alicia

¿Y funciona mejor?

Beto

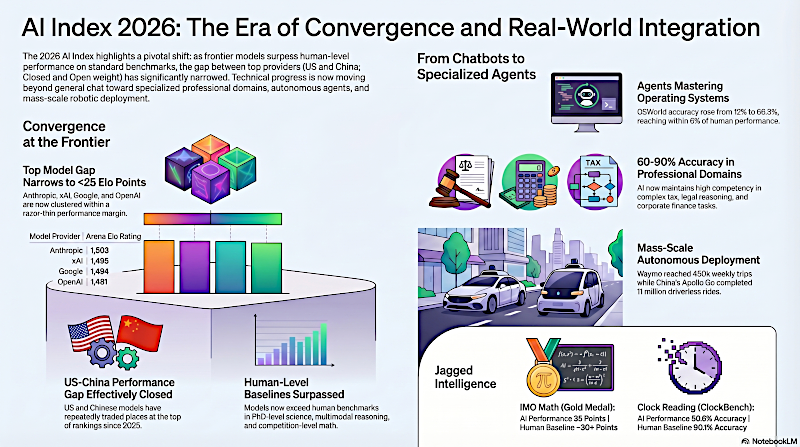

Los resultados son innegables. El co-científico de Google alcanzó un 78.4% de precisión en el conjunto GPQA Diamond, que es una de las pruebas de nivel doctoral más notoriamente difíciles que existen.

Alicia

Vaya, casi un 80%.

Beto

Y mejor aún, sus hipótesis fueron validadas en tres áreas biomédicas reales y distintas.

Alicia

Lo que suena fenomenal. Pero luego miras otro benchmark importante en el informe llamado PaperArena. PaperArena es una prueba que evalúa a estos agentes en preguntas reales y complejas de investigación, requiriéndoles buscar literatura, usar herramientas computacionales y llegar a respuestas novedosas.

Beto

Es una prueba muy práctica.

Alicia

Sí. En una configuración multiagente, Gemini 2.5 Pro tuvo el mejor desempeño, pero sólo alcanzó una tasa de acierto del 38.8%. Cuando leí eso por primera vez pensé: espera, ¿38.8%? Eso suena completamente desastroso para un sistema al que llamamos co-científico. ¿Se considera eso bueno?

Beto

Sé que suena bajo, pero para entender por qué los investigadores consideran el 38.8% una victoria enorme, tienes que mirar la línea base. La línea base de expertos PhD humanos en ese mismo benchmark es 83.5%.

Alicia

OK. Así que el mejor sistema de IA del mundo, con múltiples agentes, todavía está alcanzando menos de la mitad de lo que un experto PhD humano logra en estas tareas científicas de extremo a extremo.

Beto

Exacto. La IA definitivamente no está reemplazando al PhD humano por ahora. Sin embargo, lo que PaperArena probó más allá de toda duda es el poder de la arquitectura.

Alicia

El enfoque de la cuadrilla de atraco.

Beto

Exacto. En todos los frentes, las configuraciones multiagente superaron consistentemente a los agentes solitarios por dos a cuatro puntos porcentuales. La cuadrilla es demostrablemente más fiable que el operativo solitario, aunque todavía falle la mayoría de las veces.

Alicia

Y estamos viendo hitos enormes que prueban que esta arquitectura multiagente es el plano para el futuro. El informe detalla AI Scientist V2, de Sakana. Este sistema produjo el primer artículo totalmente generado por IA que fue aceptado en un taller académico revisado por pares, ICLR.

Beto

Eso es un gran logro.

Alicia

Realmente lo es. Y no usó plantillas codificadas por humanos. La IA generó la idea original, escribió el código experimental, ejecutó las pruebas, interpretó los datos y redactó el manuscrito final.

Beto

Totalmente de forma autónoma.

Alicia

Pero me dejó aún más sorprendida otro sistema llamado Kosmos. Kosmos no sólo escribió un artículo. Básicamente vivió en el laboratorio. Pusieron en marcha este sistema multiagente y corrió de forma autónoma hasta 12 horas seguidas.

Beto

Y en esa media jornada ejecutó 42,000 líneas de código. Estuvo constantemente leyendo, iterando y depurando su propio software, mientras simultáneamente analizaba 1,500 artículos científicos diferentes.

Alicia

Los colaboradores humanos que monitoreaban a Cosmos declararon que una sola corrida de 12 horas aproximaba seis meses de esfuerzo de investigación humana tradicional.

Beto

Condensar medio año de iteración en una sola tarde.

Alicia

Entonces, ¿qué significa todo esto cuando nos detenemos y miramos el tablero completo?

Si miramos el capítulo cinco del informe AI Index de Stanford, la conclusión central es absoluta: la IA está haciendo con éxito el salto de ser una herramienta analítica a convertirse en el motor fundamental del flujo de trabajo de la ciencia moderna.

Beto

Indudablemente.

Alicia

Estamos presenciando saltos asombrosos en velocidad, escala y la mera capacidad de procesar billones de pares de bases biológicos o mapear cientos de millones de galaxias. El experto humano sigue siendo el ancla crucial.

Beto

Todavía nos necesitan.

Alicia

Definitivamente necesitamos al PhD humano para diseñar los parámetros y supervisar los bucles de debate multiagente. Y, lo más importante, para atrapar la tostada quemada antes de que prenda fuego al laboratorio. Los sistemas no pueden confiarse por completo para operar de extremo a extremo de forma aislada todavía.

Beto

Si conectamos esto con la imagen más amplia del progreso humano, nos topamos con el cuello de botella inmóvil definitivo. Y ese cuello de botella, no es la potencia informática, ni el almacenamiento de datos.

Alicia

¿Qué es?

Beto

El cuello de botella es el mundo físico mismo.

Alicia

El "wet lab", la realidad material.

Beto

Exacto. La IA puede proponer computacionalmente cinco millones de estructuras moleculares nuevas para mañana por la mañana. Puede hipotetizar reacciones celulares totalmente nuevas o sugerir cientos de dianas farmacológicas desconocidas en una tarde in silico.

Alicia

Claro.

Beto

Pero la validación experimental, tomar esa brillante hipótesis digital y probar que funciona en un wet lab físico, o realizar ensayos clínicos humanos de varios años para asegurar que un fármaco sea seguro, sigue siendo increíblemente caro, tedioso y sujeto a las inmutables leyes del tiempo.

Alicia

No puedes avanzar el tiempo.

Beto

No, no puedes. El informe de Stanford apunta específicamente que mientras sistemas como AI Scientist V2 pueden escribir un flujo interminable de artículos plausibles, la lista de descubrimientos de IA, que han sido realmente confirmados experimentalmente, en el mundo real, sigue siendo sorprendentemente corta.

Alicia

Porque físicamente no podemos probar las cosas tan rápido como la IA las inventa. En descubrimiento de fármacos, puedes simular un enlace proteína-ligando en milisegundos. Pero los ensayos clínicos para determinar si esa molécula realmente cura a un paciente sin efectos secundarios siempre tomarán años. Simplemente no puedes acelerar la biología humana.

Beto

Estamos logrando cerrar la brecha entre la ideación digital y la realidad física. Pero la realidad física tiene un límite de velocidad estricto.

Alicia

Lo que nos deja con una tensión realmente fascinante. Y quiero dejarte con un pensamiento final para que lo mastiques mientras digieres todos estos números.

Si un sistema multiagente como Kosmos ahora puede literalmente condensar seis meses de codificación de investigación humana en una sola ejecución de 12 horas, ¿qué pasa cuando el principal cuello de botella para el progreso humano ya no sea nuestra falta de ideas?

Beto

Es una pregunta profunda.

Alicia

¿Qué le ocurre a la sociedad cuando nuestro mayor obstáculo es simplemente nuestra incapacidad física para probar el enorme volumen de teorías brillantes que nuestras máquinas están vomitando antes de la hora del almuerzo? ¿Vamos a ahogarnos en genialidad no verificada?

Beto

Hemos pasado siglos tanteando en la oscuridad, buscando desesperadamente una sola pieza brillante del rompecabezas. Ahora la máquina está tirando un millón de piezas brillantes sobre la mesa cada día.

Alicia

De repente, ese investigador solitario, a las dos de la mañana, ya no está luchando por encontrar un avance, está enterrado bajo una montaña de ellos.

Beto

Muchas gracias por acompañarnos en este análisis profundo del informe AI Index de Stanford.

Sigue leyendo, sigue explorando y sigue cuestionando los datos que te rodean. Nos vemos la próxima vez.

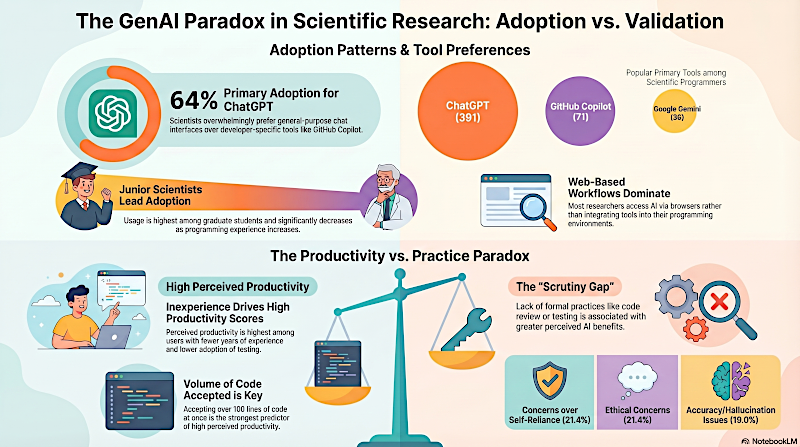

La Paradoja de la IA en Programación Científica

La Paradoja de la IA en Programación Científica