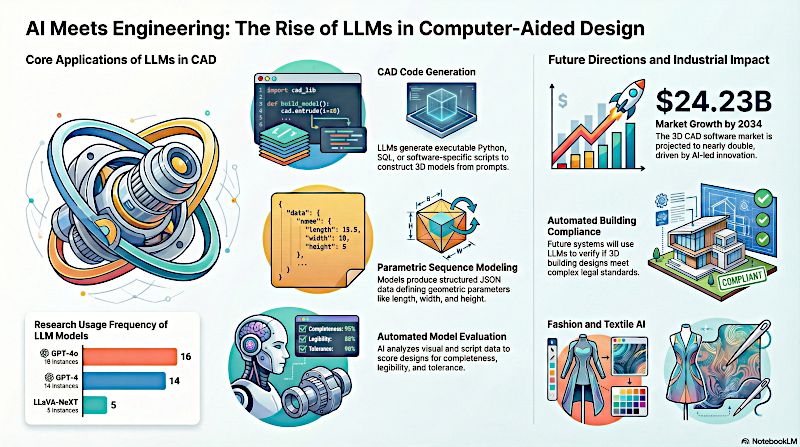

Este estudio explora la integración emergente de los Modelos de Lenguaje de Gran Tamaño (LLM) con el Diseño Asistido por Computadora (CAD) para automatizar y optimizar los flujos de trabajo de modelado 3D. Los autores clasifican la investigación actual en aplicaciones clave, como la generación de código CAD y la síntesis paramétrica CAD, donde modelos como GPT-4o y Llama-3 interpretan texto o imágenes para crear diseños digitales. El texto detalla conceptos fundamentales de IA, como el ajuste fino, la indicación y la alineación, a la vez que proporciona una taxonomía de los diversos conjuntos de datos y métricas de evaluación utilizados en este campo. Mediante el análisis de modelos de código cerrado y públicos, la fuente destaca cómo estas tecnologías acortan la distancia entre las instrucciones en lenguaje natural y la geometría compleja de ingeniería. Finalmente, el artículo identifica futuras direcciones críticas, como la aplicación de la IA al diseño de interiores, la fabricación textil y la automatización del cumplimiento normativo en edificios.

Enlace al artículo científico, para aquellos interesados en profundizar en el tema: "Large Language Models for Computer-Aided Design: A Survey", por Licheng Zhang y colegas. Publicado el 13 de Mayo de 2025. También publicado en ACM Computing Surveys el 11 de Febrero del 2026.

El resumen, la transcripción, y la traducción fueron hechas usando herramientas de software de Inteligencia Artificial.

El resumen se presenta en la forma de un diálogo entre dos personajes sintéticos que llamaremos Alicia y Beto.

Resumen

Beto

Tengo una pregunta para ti. Y es rara.

Alicia

Bien. Estoy lista.

Beto

Imagina que estás de pie en un hangar vacío, una habitación enorme y vacía, sin nada dentro. Y empiezas a hablar.

Alicia

Como para mí misma.

Beto

Sí, exactamente. Pero estás describiendo un motor a reacción y no solo un gran ventilador de metal. Describes las líneas de combustible, las placas de la turbina, las proporciones de compresión exactas.

Alicia

Sí, las especificaciones de ingeniería reales.

Beto

Exacto. Y mientras hablas, el motor simplemente se manifiesta allí delante de ti, no un holograma. Los planos físicos reales y el código de la máquina para cortar el metal aparecen de la nada.

Diseñando un motor a reacción

Alicia

Quiero decir, eso es el sueño definitivo de la ciencia ficción, ¿no? El momento replicador de Star Trek.

Beto

Lo es. Y durante mucho tiempo, eso se sintió como pura magia. Pero estaba leyendo este montón de artículos que me enviaste para el análisis profundo de hoy, específicamente esta enorme encuesta del ACM Computing Service.

Alicia

Ah, el artículo de Zhang.

Beto

Sí, publicado este mes, febrero de 2026. "Modelos de lenguaje grandes para diseño asistido por computadora". Y tengo que admitir que se me puso la piel de gallina leyéndolo. Porque realmente parece que ya no estamos hablando de magia. Estamos hablando de ingeniería real.

Alicia

Absolutamente. Y el equipo detrás de ese trabajo, Licheng Zhang, Bach Le y sus colegas, señalan un cambio fundamental en cómo se crean los objetos físicos.

Beto

Exacto.

Alicia

Básicamente estamos pasando de un mundo donde los humanos dibujan líneas a pulso en una pantalla a un mundo donde los humanos describen sus intenciones y las máquinas se encargan de toda la geometría compleja.

LLMs para CAD

Beto

Lo cual es enorme para la industria del CAD ("Computer-Aided Design", "diseño asistido por computador"), ¿no? Estamos hablando de una industria de 24 mil millones de dólares aquí. Pero mira, seamos realistas un segundo. Yo uso IA todo el tiempo. La uso para escribir correos o quizá generar una imagen graciosa de un gato con traje espacial.

Alicia

Claro.

Beto

Pero esa imagen, si la miras de cerca, al gato suele salirle como seis dedos en las patas. O la iluminación es completamente imposible. Es onírica. Y no puedes construir un puente con tu onírico.

Alicia

No, no puedes.

Beto

Si un puente tiene seis dedos o fallas estructurales, la gente muere. Así que para todos los que nos escuchan hoy, nuestra misión es averiguar esto. ¿Cómo cerramos la brecha entre un generador de texto divertido y la ingeniería de precisión?

Alicia

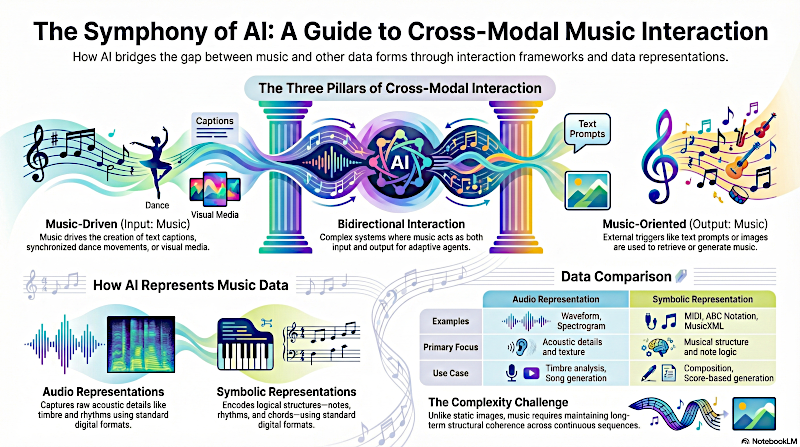

Esa es la pregunta central. Y la respuesta realmente radica en cómo han evolucionado estos modelos en los últimos años. Ya no tratamos con simples chatbots. La encuesta describe toda una nueva generación de modelos de lenguaje multimodales (MMLM).

Beto

OK, multimodal. Esa es una palabra de moda que oigo mucho. ¿Nos la desglosas en el contexto del CAD?

Alicia

Claro. Piensa en cómo trabaja realmente un ingeniero humano. No se sienta solo a leer un libro de texto. Mira diagramas. Sostiene piezas físicas en las manos. Hace bocetos en servilletas.

Beto

Es un proceso muy visual y táctil.

Alicia

Exacto. Y un modelo multimodal opera de la misma manera. La encuesta destaca a los grandes actores propietarios: primero el GPT-4o de OpenAI, el modelo Omni, y la serie Gemini de Google. Estos sistemas pueden ingerir texto, imágenes, audio y vídeo simultáneamente. No solo leen. Ven. Y lo que es más importante, entienden las relaciones espaciales.

Beto

OK. Pero esos son los sistemas cerrados, las grandes cajas negras corporativas. Leyendo la encuesta, parecían muy entusiasmados con lo de código abierto.

Alicia

Oh, definitivamente. Ahí es donde ocurre la innovación más dirigida para tareas especializadas como esta. Los investigadores señalan específicamente a la familia Llama de Meta. Y aún más interesante, la familia DeepSeek.

Beto

Sí, vi eso. Y hubo un número que me saltó respecto a Llama 4, que se lanzó en 2025. Decía que soporta hasta 10 millones de tokens.

Alicia

Sí. 10 millones.

Beto

Quiero decir, sé que los tokens son básicamente fragmentos de palabras, pero 10 millones. Suena a una cantidad masiva de texto. ¿Por qué importa eso para diseñar, digamos, un engranaje simple? Un engranaje no es una novela.

Alicia

No es una novela, no. Pero ¿y un motor a reacción o un rascacielos? Eso no es solo una novela. Eso es toda una biblioteca de información.

Beto

OK. Punto justo.

Alicia

Piensa en un proyecto CAD complejo en el mundo real. No es solo la forma 3D. Son las propiedades del material. Son las normativas de seguridad. Es la documentación heredada del modelo antiguo que fabricaste hace cinco años. Son las notas de compatibilidad con las fresadoras específicas que usa tu fábrica.

Beto

Ya veo. Entonces la IA tiene que poder mantener todo ese contexto en su “cabeza” al mismo tiempo.

Alicia

Exacto. En los viejos tiempos, que en términos de IA es como hace dos años, un modelo podía leer el manual de seguridad, empezar a diseñar la pieza y luego literalmente olvidarse de los requisitos máximos de carga para cuando llegaba al sujetador.

Beto

Se quedó sin memoria.

Alicia

Correcto. Su ventana de contexto era demasiado pequeña. Pero con una ventana de contexto de 10 millones de tokens, Llama 4 puede mantener efectivamente toda la historia de ingeniería de una empresa en su memoria de trabajo mientras diseña una sola pieza diminuta. Asegura consistencia global en todo el proyecto.

Beto

Eso es una locura. Es como tener un ingeniero que ha memorizado perfectamente cada memo y plano que la empresa ha producido.

Alicia

Y que nunca necesita un descanso para el café.

Beto

Exacto.

Alicia

Pero luego miras DeepSeek V3. La encuesta realmente aprecia este modelo por su arquitectura específica. Usa algo llamado "Mixture of Experts", MoE.

Beto

Que suena a un programa de paneles diurno en la tele.

Alicia

Suena así. Pero en realidad es una manera brillante de ahorrar potencia de cómputo. Mira, diseñar formas 3D es computacionalmente costoso. Si usas un cerebro general enorme para cada cálculo pequeñísimo, vas a quemar tu servidor.

Beto

Es demasiado.

Alicia

Exacto. Así que mixture of experts significa que el modelo se divide en subredes altamente especializadas. Si le pides una descripción en texto, solo se activa la parte escritora del cerebro. Si pides un cálculo de coordenadas preciso, se activa el matemático.

Beto

Así que es pura eficiencia. No está disparando todas sus neuronas todo el tiempo.

Alicia

Precisamente. Y esa eficiencia es crucial porque permite que estos modelos sean lo suficientemente ágiles como para integrarse en los flujos de trabajo cotidianos. No necesitas una supercomputadora masiva solo para ejecutar una consulta de diseño simple.

Beto

OK. Tenemos los cerebros. Tenemos la memoria masiva. Ahora hablemos de las manos. Porque esta es la parte que aún me cuesta visualizar.

Alicia

La parte de creación real.

Generación de Código CAD

Beto

Sí. Me siento frente al ordenador. Escribo, "hazme una brida con cuatro orificios para tornillos". ¿Qué pasa realmente? Porque la IA no tiene ratón. No está moviendo un cursor y haciendo clic en círculos en AutoCAD.

Alicia

No, no está haciendo clic en nada. Está programando. Y esta es la primera aplicación central que los investigadores identifican en la encuesta: generación de código CAD.

Beto

Entonces la salida no es un dibujo en absoluto. Es solo texto.

Alicia

Es código que crea el dibujo. Piénsalo como un guion para una película. La IA escribe un guion, usualmente en Python, C++ o un lenguaje especializado llamado CadQuery. Ese script contiene instrucciones explícitas paso a paso.

Beto

¿Como qué?

Alicia

Como dibuja un círculo en la coordenada 0,0, extrúyelo 10 milímetros, ahora corta un cilindro en la coordenada 2,2.

Ejemplo de CadQuery:

import cadquery as cq

circle_radius = 50.0 # radio del plato

thickness = 13.0 # grosor del plato

rectangle_width = 13.0 # ancho del hueco rectangular en el plato cilindrico

rectangle_length = 19.0 # longitud del hueco rectangular en el plato cilindrico

result = (

cq.Workplane("front")

.circle(circle_radius)

.rect(rectangle_width, rectangle_length)

.extrude(thickness)

)

show_object(result)

Beto

Ah, o sea que describe la geometría puramente de forma matemática.

Alicia

Sí. Y esto es muy superior a solo generar una malla 3D, ya sabes, como los assets que ves en videojuegos.

Beto

¿Por qué es mejor?

Alicia

Porque el código es editable. Es paramétrico. Si generas una malla y está un poco pequeña, tienes que estirar todo, lo que la distorsiona. Pero si es código y quieres cambiar el tamaño de un agujero, solo cambias una variable en el script de 5 a 6. Y todo el modelo se actualiza a la perfección.

Beto

Lo entiendo. Pero espera. Le he pedido a la IA que escriba código antes. Solo cosas simples, como un botón para una página web. Y honestamente, la mitad de las veces no funciona a la primera.

Alicia

Oh, absolutamente.

Beto

Se olvida de un corchete. O importa una librería que ni siquiera existe. Si hace eso con una pieza mecánica, el software CAD se cuelga. O peor, la pieza se genera pero es físicamente imposible de fabricar.

Alicia

Tienes toda la razón en ser escéptico. Las alucinaciones en código son una molestia menor para el diseño web, pero son un rompe-negocios completo en ingeniería. Exactamente por eso la encuesta detalla flujos de trabajo muy específicos usados por sistemas más nuevos, como Query2CAD y CADCodeVerify. No es una línea recta del prompt al producto. Es un bucle, un ciclo.

Beto

¿Qué tipo de bucle?

Alicia

Bucle de autocorrección. Así es como funciona en la práctica. Le das al sistema tu prompt, el modelo de lenguaje escribe el código. Pero en lugar de entregarte ese código, el sistema lo intenta ejecutar en un motor CAD en segundo plano.

Beto

OK, así que corre una prueba.

Alicia

Correcto. Y si el código falla, digamos que la IA intentó cortar un agujero en el vacío, donde no hay material, el motor CAD lanza un mensaje de error. Dice algo como "error, operación booleana fallida".

Beto

OK.

Alicia

El sistema toma ese mensaje de error exacto y se lo devuelve a la IA.

Beto

Así que básicamente le dice, "oye, la embarraste. Aquí está el error, arréglalo".

Alicia

Exacto. Y la IA va, "ah, veo mi error. Necesito mover la operación de corte para que intersecte con el cuerpo principal". Y reescribe el código. Itera una y otra vez hasta que el código se ejecute sin errores.

Beto

Eso es increíblemente ingenioso. Es como que se depura a sí misma antes de que tú lo veas.

Alicia

Se pone aún más guay que eso. Algunos de los pipelines más avanzados no solo comprueban si el código se ejecuta sin fallos. Realmente renderizan el resultado. Sacan una imagen 2D de la forma 3D final y alimentan esa imagen al modelo de visión de la IA.

Beto

Oh, wow. Entonces la IA mira lo que acaba de construir y lo compara con mi problema de texto original.

Alicia

Precisamente. Aquí es donde la capacidad multimodal realmente rinde frutos. Cierra el bucle entre la instrucción semántica, como cuatro orificios, y la realidad visual. La encuesta señala que GPT-4V, la versión con visión, es significativamente mejor en esto que los modelos solo de texto, precisamente porque puede verificar su propio trabajo visualmente.

Beto

Así que literalmente puede mirar el render y decir, "espera, el usuario pidió cuatro orificios, pero solo veo tres. Tengo que volver y arreglarlo".

Alicia

Exacto. Detecta sus propias alucinaciones visuales.

Beto

Tiene mucho sentido.

Generación de Diseño Paramétrico

Beto

Pero no sé. Estamos dejando que la IA escriba código de programación crudo desde cero. Sigue pareciéndome arriesgado. ¿Hay forma de hacer esto sin confiar en que la IA sea una programadora impecable?

Alicia

Sí, la hay. Y eso nos lleva a la segunda categoría mayor en la encuesta: generación de diseño paramétrico.

Beto

OK, ¿en qué se diferencia eso de la generación de código?

Alicia

Si la generación de código es escribir una novela completamente desde cero, la generación paramétrica es más como rellenar un formulario extremadamente detallado. Ya tienes una receta para un tipo específico de objeto. Digamos una silla. La estructura está definida, pero la receta tiene variables como longitud, ancho del asiento, ángulo del respaldo.

Beto

Lo entiendo. La lógica fundamental ya existe. La IA solo está moviendo las perillas.

Alicia

Exacto. La IA no está inventando la lógica. Está prediciendo los parámetros específicos. Sale con una secuencia estandarizada de operaciones o quizá un archivo JSON. Solo dice "dibuja círculo, extruye 50, corta 10".

Beto

Eso suena mucho más seguro. Estás restringiendo a la IA para que no pueda inventar accidentalmente, no sé, una silla que flote en el aire.

Alicia

Es mucho más estable. La encuesta destaca un conjunto de datos masivo llamado DeepCad que se usa intensamente para entrenar modelos en estas secuencias. Es esencialmente un terreno de entrenamiento donde la IA aprende la gramática básica de las formas 3D.

Beto

Así que herramientas como Text-to-CAD usan este enfoque.

Alicia

Claro. Escribes un taburete alto con respaldo pequeño y la herramienta traduce la palabra “alto” en longitud de pata = 800 milímetros y “respaldo pequeño” en altura del respaldo = 150 milímetros.

Beto

Pero hay una matización ahí, ¿no? Porque “alto” es subjetivo. Si empiezo a jugar con los parámetros de la longitud de las patas al azar, podría acabar con una silla que tiene el centro de gravedad demasiado alto y se vuelca en cuanto te sientas.

Alicia

Oh, sí. Eso se conoce como el problema de las restricciones. Y la encuesta discute un marco llamado CADFusion que intenta resolver exactamente eso. Usa un sistema de recompensa especializado durante el entrenamiento. Entrena al modelo no solo para que coincida con el prompt de texto, sino para crear un objeto que sea coherente visual y físicamente. Obliga a que los parámetros matemáticos se alineen con expectativas visuales del mundo real.

Beto

OK, parece que nos estamos acercando a la fiabilidad real. Pero quiero volver a mi comentario del gato con seis dedos de antes.

Alicia

Claro.

Puntos Críticos

Beto

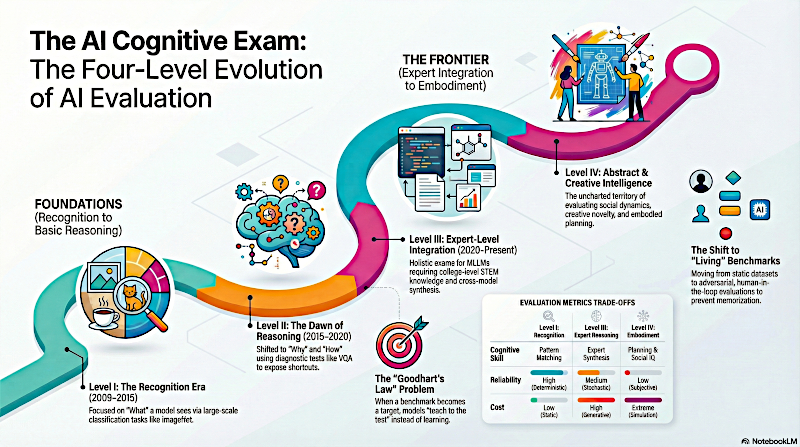

En arte digital, un error es solo una peculiaridad estilística. En ingeniería, un error es una falla catastrófica. ¿Cómo evaluamos realmente a estas IAs? No es como si pudieras dar a un modelo de lenguaje un examen de opción múltiple sobre diseño de sillas. ¿Cómo sabemos objetivamente que el diseño de la IA es bueno?

Alicia

Esto nos lleva a la sección de críticos de la encuesta. Y honestamente, la evaluación es uno de los problemas más difíciles que están tratando de resolver ahora mismo.

Beto

Porque si te pido una mesa de café moderna, hay un millón de respuestas correctas.

Alicia

Exacto. Así que los investigadores tienen que usar métricas bastante complejas para puntuar a los modelos. La grande que mencionan constantemente se llama "distancia de Chamfer".

Beto

Distancia de Chamfer. OK, sé que un “chamfer” es un bisel en carpintería o metalurgia. Pero supongo que esto significa algo completamente distinto en IA.

Alicia

Sí, es una forma matemática de medir la diferencia entre dos formas 3D. Imagina que tienes la versión perfecta de un objeto: el modelo de referencia creado por un ingeniero humano maestro. Y luego tienes la versión de la IA. Disuelves ambos modelos sólidos en nubes de miles de puntitos flotantes.

Beto

OK, me imagino dos nubes de puntos holográficas y fantasmales.

Alicia

Correcto. Entonces calculas la distancia promedio desde cada punto en la nube de la IA hasta el punto más cercano en la nube humana perfecta.

Beto

Ah, ya veo. Así que si los modelos fueran absolutamente idénticos, la distancia sería cero. Pero si la IA hizo la pata de la mesa demasiado gruesa, sus puntos sobresaldrán más y la puntuación promedio de distancia sube.

Alicia

Exacto. Es una forma puramente matemática de cuantificar el error de la forma. También usan métodos estadísticos como la divergencia de Jensen-Shannon.

Beto

¿Qué es eso?

Alicia

Básicamente mide cuán similar es la distribución global de las formas generadas respecto a las formas del mundo real. Pero sinceramente, la métrica más práctica en la que confían es simplemente la tasa de éxito.

Beto

Que significa, ¿se ejecuta una corrida?

Alicia

¿El código se ejecuta sin que el software CAD se estrelle? Porque te sorprendería. Muchos modelos tempranos escribían código que parecía perfecto para un revisor humano, pero contenía errores lógicos sutiles que creaban lo que se llama "geometría no manifold".

Beto

No manifold. ¿Qué significa eso?

Alicia

Significa formas que no pueden existir físicamente en el mundo real.

Beto

Como una pintura de Escher.

Alicia

Algo así, como un objeto sólido que tiene área superficial pero volumen cero, o dos aristas que se encuentran de una forma que crea una línea infinitamente delgada. Un motor de videojuegos podría renderizarlo bien, pero una impresora 3D o una máquina CNC se moriría con eso.

Beto

Porque no puedes imprimir algo infinitamente delgado. Así que la IA está prácticamente alucinando física imposible.

Alicia

A veces sí. Y eso conduce probablemente al mayor dolor de cabeza mencionado en toda la encuesta: la alineación multimodal.

Beto

Ahora, normalmente cuando hablamos de alineación y de IA, hablamos de ética, asegurarnos de que la IA no diga algo ofensivo o ayude a alguien a construir un arma. ¿Qué significa alineación en el contexto del CAD?

Alicia

Aquí significa que los distintos “sentidos” de la IA tengan que estar realmente de acuerdo entre sí. Imagina que tu prompt de texto pide un soporte de aluminio. La IA genera código y el render visual crea una forma que se ve exactamente como un soporte metálico robusto.

Beto

Suena bien hasta aquí.

Alicia

Pero los parámetros internos que se guardan en los metadatos podrían haber definido por accidente la densidad del material como si fuera un plástico barato.

Beto

Oh, wow. Así que visualmente en pantalla, parece totalmente bien. Pero si haces una simulación de esfuerzo sobre ello, se hace trizas de inmediato.

Alicia

Exacto. La salida visual y los datos de ingeniería subyacentes están desalineados. Esto es increíblemente peligroso, porque un ingeniero humano podría mirar el render, decir, se ve bien para mí, y no darse cuenta de que los datos físicos subyacentes son basura hasta que realmente fabrican la pieza y se rompe en el campo.

Beto

Eso es aterrador. ¿Por qué pasa eso? ¿La IA está adivinando los metadatos al azar?

Alicia

Es en gran parte un problema de escasez de datos. La encuesta lo señala de forma muy contundente. Tenemos miles y miles de millones de imágenes de gatos y atardeceres en Internet público para entrenar generadores de imágenes. No tenemos miles de millones de archivos de ingeniería paramétrica de alta calidad y completamente anotados con datos de materiales.

Beto

Porque las empresas los guardan bajo llave; Boeing y Ford no están subiendo sus planos propietarios a GitHub para que cualquiera los descargue.

Alicia

Exacto. Todo es propiedad intelectual altamente protegida. Así que la IA entrena mayoritariamente en bases de datos sintéticas: cubos, esferas, soportes genéricos, mesas simples. Tiene problemas con ensamblajes complejos del mundo real porque esos son secretos industriales.

Beto

Tiene todo el sentido. Basura entra, diseños simples salen.

Fronteras Futuras

Alicia

Pero, y aquí es donde vuelve el optimismo: a pesar de estos límites severos de datos, la tecnología ya está irrumpiendo en industrias sorprendentemente variadas. La encuesta dedica toda una sección a fronteras futuras y algunas de ellas honestamente no las vi venir.

Beto

Sí, vi moda en esa lista, lo cual me pareció muy raro. Siempre pienso en CAD para cosas duras. Metal, plástico, hormigón; la moda es blanda, se pliega.

Alicia

Es blanda, pero piensa en el proceso de fabricación real, el patronaje. Una camisa empieza como una forma geométrica 2D precisa dibujada en una pieza plana de tela. La cortas y se pliega alrededor de un cuerpo humano 3D complejo. Eso es pura topología y geometría.

Beto

Supongo que es cierto. Es esencialmente ingeniería blanda.

Alicia

La encuesta señala que la industria de la moda es masiva, pero la adopción de LLM allí es actualmente mínima. Visualizan flujos de trabajo de texto a patrón. Simplemente describes un vestido: "quiero un corte vintage, línea A, hasta la rodilla", y la IA genera instantáneamente el patrón 2D preciso necesario para coserlo perfectamente.

Patrón de ejemplo: la curva Gosper (un fractal moderno)

Concepto creado con Google Whisk (animado)

Beto

Eso sería increíble para ropa a medida. No más depender de tallas estándar que no le quedan bien a nadie.

Alicia

Exacto. Luego está la construcción naval, que la encuesta dice que básicamente es arquitectura flotante, pero que hasta ahora ha tenido sorprendentemente poco enfoque en IA.

Pero la frontera que creo que tiene la aplicación más inmediata, aburrida pero muy rentable, está en el sector AEC: Arquitectura (homeGPT, roomGPT), ingeniería y construcción. Específicamente, algo llamado "comprobación de cumplimiento", "Building Compliance Checking".

Beto

OK, tienes razón. Comprobación de cumplimiento es probablemente la frase menos sexy que he oído hoy. ¿Por qué es una frontera tan masiva?

Alicia

Porque soluciona un problema gigantesco y universal. Piénsalo. Ahora mismo, comprobar si un diseño de edificio cumple el código municipal implica a una persona muy bien pagada leyendo un PDF de 500 páginas de regulaciones locales. Y luego tiene que revisar manualmente planos complejos para ver si los pasillos son lo suficientemente anchos para sillas de ruedas o si las salidas de emergencia están colocadas correctamente.

Beto

Es tedioso. Es lento. Es caro. Y me imagino que la gente se cansa, y se le pasan por alto algunas cosas.

Alicia

Todo el tiempo. Y si te pasas por alto una violación del código de incendios en la planta 12, te pueden demandar o tienes que literalmente derribar un muro de hormigón después de construido. La encuesta sugiere que los LLM son absolutamente perfectos para esto. Pueden ingerir y entender instantáneamente el texto de la ley. Y con estas nuevas capacidades multimodales, pueden mirar directamente el modelo BIM 3D, el modelo de información del edificio.

Beto

Así que la IA lee las ordenanzas. Escanea el modelo 3D del edificio y simplemente señala un lugar y dice, "oye, este vano de puerta tiene dos pulgadas de menos según la página 40 del código de incendios".

Alicia

Al instante. Automatiza la burocracia. Eso no es diseño generativo en el sentido creativo, pero a corto plazo es posiblemente mucho más valioso para la industria.

Beto

Básicamente es un inspector de edificios automatizado por IA. Eso me gusta mucho.

Alicia

Exacto. Y finalmente, hay otra frontera mencionada que me parece la más futurista: la ingeniería inversa. El artículo lo llama "CAD-recode".

Beto

Recode. Así que tomar algo y hacer marcha atrás.

Alicia

Sí. Tomar una simple fotografía o un escaneo 3D de un objeto completamente acabado y hacer que la IA trabaje hacia atrás para generar el código CAD original que lo construiría.

Beto

Espera, si tengo un engranaje metálico roto de un tractor vintage de 1950 y la empresa lleva décadas cerrada, ¿puedo simplemente escanear la pieza rota?

Alicia

Exacto. La IA analiza la geometría del escaneo, deduce lógicamente los pasos de fabricación. Determina, "OK, esto empezó como un cilindro, luego se dejó aquí, luego se taladró allí". Y escribe el script en Python para recrearlo desde cero.

Beto

Eso cierra completamente el ciclo de objeto físico a código digital. Y luego lo mandas a una impresora 3D y lo recuperas en físico.

Alicia

Lo hace. Habilita una cultura de reparación y un nivel de mantenimiento que no veíamos en décadas.

Beto

Pero tengo que jugar al abogado del diablo un segundo.

Alicia

Adelante.

Beto

Si esto realmente funciona, si una IA puede mirar un objeto físico acabado e instantáneamente deducir los planos precisos para manufacturarlo, ¿no rompe eso por completo el concepto de propiedad intelectual?

Alicia

Esa es exactamente la idea provocadora con la que quería dejarte hoy. La encuesta toca esa implicación porque si la barrera para copiar un producto deja de ser la habilidad de ingeniería y pasa a ser literalmente apuntar la cámara del móvil a algo, ¿qué pasa con las patentes?

Beto

En serio, si puedo entrar en la sala de exposición de un competidor, sacar una foto rápida de su zapatilla altamente ingenierizada y tener un LLM que me devuelva el archivo de manufactura exacto en cinco segundos, eso no es solo copiar. Eso es espionaje industrial a gran escala.

Alicia

Lo es. Y cambia fundamentalmente la definición de inventar. Sugiere que en un futuro muy cercano, el valor real de un producto podría moverse fuera de la forma física del objeto y hacia cosas que la IA no puede ver fácilmente en una foto.

Beto

¿Como qué?

Alicia

Como la composición química propietaria de los plásticos usados, o el software que corre en los chips internos.

Beto

Wow. Así que la “salsa secreta” tiene que ser invisible porque el mundo visible básicamente es dominio público ahora.

Alicia

Exacto. Estamos pasando rápidamente de un mundo donde el humano dibuja las líneas a un mundo donde el humano selecciona las ideas y establece las restricciones. Nos estamos convirtiendo en los directores. El modelo de lenguaje es el equipo de cámara, el escenógrafo y el inspector de seguridad todo en uno.

Beto

Y aparentemente vamos a necesitar que la IA sea también el abogado de patentes para ordenar todo esto.

Alicia

Oh, sin duda necesitaremos una nueva generación de abogados para esto.

Beto

Bueno, esto ha sido una mirada increíblemente fascinante a un mundo que, honestamente, pensé que era algo inmune a la ola de IA generativa. Resulta que nada es inmune. El mundo digital y el físico están convergiendo, y aparentemente lo están haciendo en Python.

Alicia

Hay una nueva geometría valiente ahí fuera.

Beto

Sin duda la hay. Gracias por acompañarnos en esta inmersión profunda. Nos vemos la próxima vez.