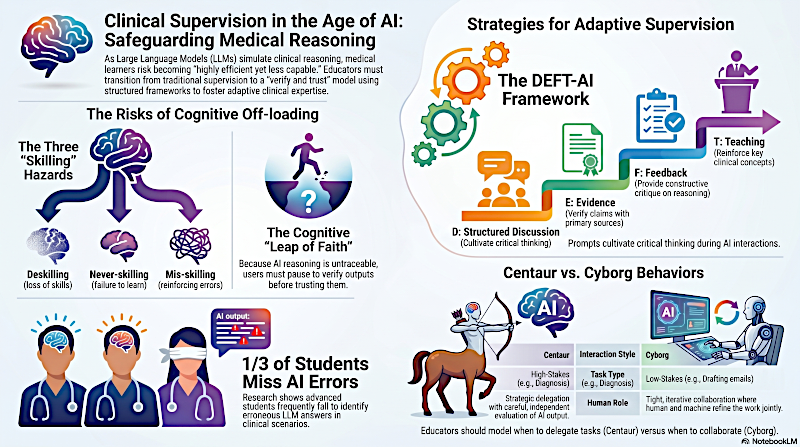

El auge de los modelos de lenguaje grande (LLMs) en la medicina introduce riesgos significativos para el desarrollo de los clínicos, incluyendo la pérdida de habilidades ("deskilling"), la incapacidad de desarrollar habilidades ("never-skilling") y la aplicación incorrecta de habilidades ("mis-skilling") debido a la dependencia excesiva en los resultados automatizados. Para combatir estas amenazas, los educadores deben ir más allá de la simple supervisión y adoptar una práctica adaptativa, lo que implica cambiar fluidamente entre la eficiencia automatizada y la resolución de problemas rigurosa e independiente.

Un nuevo marco de instrucción llamado "DEFT-AI" proporciona un método estructurado para que los supervisores puedan examinar la competencia de IA y el razonamiento clínico de un aprendiz durante interacciones en tiempo real. Este enfoque anima a los clínicos a actuar como "centauros", delegando estratégicamente tareas a las máquinas, o como "cyborgs", entrelazando el esfuerzo humano y la máquina mientras mantienen una supervisión crítica.

En última instancia, la transición hacia un aprendizaje potenciado por la IA requiere un paradigma de "verificar y confiar" (verify and trust) que priorice el pensamiento crítico como salvaguarda contra la naturaleza de "caja negra" (black box) de las tecnologías generativas. La responsabilidad recae en las instituciones médicas para integrar estas competencias en la supervisión clínica, asegurando que la tecnología aumente en lugar de reemplazar la experiencia humana.

Enlace al artículo científico, para aquellos interesados en profundizar en el tema: "Educational Strategies for Clinical Supervision of Artificial Intelligence Use", por Raja‑Elie E. Abdulnour y colegas. Publicado el 21 de Agosto de 2025, en el New England Journal of Medicine (NEJM), pp. 786-797.

El resumen, la transcripción, y la traducción fueron hechas usando herramientas de software de Inteligencia Artificial.

El resumen se presenta en la forma de un diálogo entre dos personajes sintéticos que llamaremos Alicia y Beto.

Resumen

Beto

Imagina que eres un doctor sénior, un educador supervisando una clínica muy concurrida. Y al otro lado de la sala, estás viendo a un residente médico de primer año evaluar a un paciente. Digamos que es el Sr. C.

Alicia

Bien, el Sr. C.

Beto

El Sr. C entra con un caso grave de sibilancias (o "silbidos"). Así que ves cómo el residente termina el examen físico, sale por el pasillo y luego saca discretamente su teléfono celular.

Alicia

Oh, sé a dónde va esto.

Beto

Lo sabes. Abre ChatGPT, escribe esta instrucción rápida y pide un diagnóstico diferencial. Y en cuestión de segundos, es decir, literalmente segundos, está copiando el plan de manejo bellamente razonado y altamente persuasivo de la IA directamente en la historia clínica oficial del paciente.

Alicia

Y sucede tan rápido que casi no lo ves.

Beto

Exacto. Pero tú lo viste. Entonces, como doctor sénior, ¿cuál es tu siguiente movimiento? ¿Te acercas e intervienes? ¿Lo reprendes?

Alicia

¿O simplemente respiras hondo y lo aceptas?

Beto

Correcto. Simplemente dices: "Bueno, este es el futuro de la medicina. Y una aplicación de smartphone es solo el equivalente moderno de un libro de texto médico".

Bienvenidos a nuestro análisis profundo de hoy. Nuestra misión para esta sesión es explorar cómo los profesionales altamente capacitados, específicamente los médicos, están aprendiendo a colaborar con la IA sin perder su propio juicio crítico. O, mejor dicho, sin perder sus habilidades de razonamiento independiente y crítico.

Alicia

Esto plantea una pregunta importante, porque el campo médico está sirviendo esencialmente como este laboratorio de alto riesgo para la interacción humana con la IA en este momento.

Beto

De verdad lo está. Tenemos una fuente increíble para guiarnos hoy: es un artículo de revisión del New England Journal of Medicine de agosto de 2025, titulado "Estrategias educativas para la supervisión clínica del uso de inteligencia artificial".

Alicia

Es una lectura fascinante. Y mira, incluso si tú, como oyente, no tienes absolutamente nada que ver con la atención médica, deberías preocuparte por esto.

Beto

Oh, cien por ciento.

Alicia

Porque el marco que están desarrollando estos médicos es el plano perfecto para cómo puedes usar la IA en tu vida diaria. Te muestra cómo navegar por estas cosas sin caer en algunas trampas cognitivas muy peligrosas.

Beto

Sí. Para entender por qué ese doctor sénior en nuestro pequeño escenario podría estar sintiendo una sensación de pánico, primero necesitamos entender por qué esta tecnología específica se siente fundamentalmente diferente. Hemos tenido computadoras y hospitales durante décadas.

Alicia

Correcto. Los registros médicos electrónicos.

Beto

Sí. Hicimos la transición a ellos hace años. Entonces, ¿por qué un chatbot de IA provoca una reacción tan radicalmente diferente?

Alicia

Bueno, se reduce a la ilusión de agencia. Las tecnologías anteriores, como un registro médico electrónico, eran esencialmente archivadores.

Beto

Solo carpetas digitales.

Alicia

Exacto. Buscas un resultado de laboratorio y él recupera ese resultado estático. Pero los modelos de lenguaje grande (LLMs) no solo recuperan datos. Simulan la generación de conocimiento.

Beto

Espera, ¿qué quieres decir con simular la generación de conocimiento? Porque quiero decir, cuando leo una salida de una IA, ciertamente se siente como si estuviera pensando.

Alicia

Y esa sensación es el núcleo absoluto del problema. Operan con esta fluidez similar a la humana que hace que parezcan estar procesando información y razonando por sí mismos.

Beto

Pero no lo están.

Alicia

No. Debajo de esa superficie articulada, son cajas negras impredecibles. Generan respuestas probabilísticas. Esencialmente, solo están prediciendo la siguiente palabra más probable en una secuencia basándose en enormes cantidades de datos de entrenamiento.

Beto

Así que, con coincidencia de patrones.

Alicia

Coincidencia de patrones altamente sofisticada, no deducción consciente. Y debido a eso, hay una transparencia muy, muy baja en cómo llegan realmente a una conclusión.

Beto

Los autores del artículo introducen este concepto que realmente me ayudó a aclarar esto. Lo llaman "la definición relacional de la IA".

Alicia

Sí, ese es un concepto brillante.

Beto

Argumentan que si la máquina está realmente pensando o cómo se ve el código subyacente, nada de eso importa tanto como nuestra relación con ella.

De acuerdo, desglosémoslo.

Alicia

Por favor.

Beto

Definen una interacción de IA relacionalmente. Es ese momento específico en el que una computadora proporciona un curso de acción óptimo. Y tú, el usuario, no puedes rastrear cómo llegó a ese juicio.

Alicia

Simplemente te encuentras con la salida.

Beto

Exacto. Y como no puedes rastrear la lógica, estás obligado a dar un salto de fe.

El texto utiliza aquí una analogía que es totalmente acertada. Es exactamente como el salto de fe que da un niño la primera vez que usa una calculadora.

Alicia

Oh, esa es una comparación tan buena.

Beto

Metes los números y solo tienes que confiar en la caja mágica. No conoces el circuito, pero confías en la pantalla.

Alicia

Y si mapeamos esa analogía de la calculadora a un entorno médico de alto riesgo, este salto de fe introduce una dinámica realmente disruptiva. Los autores lo llaman "la inversión de la experiencia" ("inversion of expertise").

Beto

Lo cual es fascinante. Háblame de eso.

Alicia

Probablemente tienes estos médicos adjuntos más antiguos y muy experimentados supervisando el uso de una tecnología que sus aprendices junior de 26 años podrían ser mucho más hábiles usando.

Beto

Sí, los jóvenes son mejores en la tecnología que los jefes.

Alicia

Exacto. El estudiante de medicina podría ser un mago de las indicaciones ("prompting wizard"), generando sin esfuerzo estos diagnósticos diferenciales, mientras que el educador experimentado todavía está tratando de entender el software.

Beto

Correcto, lo cual invierte completamente la jerarquía.

Alicia

Lo hace. La nivela. Y esto hace necesario un modelo de aprendizaje compartido. Los educadores tienen que adoptar explícitamente momentos de perspicacia guiada por el aprendiz y básicamente aceptar que ellos mismos son ahora aprendices.

Beto

Lo cual suena genial en el papel.

Alicia

Sí.

Beto

Muy colaborativo. Pero hablando de lo práctico, esto lleva a una pregunta masiva. Si los estudiantes más jóvenes son mucho más rápidos y mejores usando la herramienta, ¿por qué no simplemente dejarles?

Alicia

¿Para descargar el trabajo?

Beto

Sí. Si la IA puede generar instantáneamente un plan de manejo del paciente, ¿por qué no dejarles descargar todo ese pensamiento tedioso y que consume mucho tiempo para que puedan concentrarse en, no sé, el trato con el paciente?

Alicia

Y eso nos lleva a los inmensos riesgos de la descarga cognitiva ("cognitive offloading"). Realmente necesitamos trazar una línea clara aquí. La descarga cognitiva no es inherentemente mala.

Beto

Correcto. Como cuando uso la IA para redactar un correo administrativo rutinario.

Alicia

Exacto. O resumir una transcripción de reunión larga. Estás descargando una tarea escrita, y eso libera tu memoria de trabajo para desafíos más exigentes.

Beto

Definitivamente no necesito pasar 20 minutos formateando un correo.

Alicia

Nadie lo hace. Pero el peligro surge cuando comienzas a descargar tareas complejas y no estructuradas. Cosas como el razonamiento clínico o la toma de decisiones diagnósticas.

Beto

Los fundamentos.

Alicia

Sí. Cuando descargas el pensamiento real, caes en tres trampas de habilidades específicas, profundamente preocupantes y esbozadas en el texto.

La Supervisión Clínica en la Era de IA: Cómo Proteger el Razonamiento Médico

Beto

Vamos a recorrer esas trampas porque son aterradoras una vez que las entiendes.

La primera es la pérdida de habilidades ("de-skilling"),

Alicia

Que es simplemente perder habilidades adquiridas previamente.

Beto

Correcto. Porque simplemente dejaste de practicarlas. El paralelismo más claro para mí aquí es la navegación GPS.

Alicia

Correcto.

Beto

Como, hace 10 años, yo conocía la distribución física de toda mi ciudad.

Alicia

Todos lo sabíamos.

Beto

Pero ahora, porque simplemente sigo ciegamente la línea azul en mi teléfono, literalmente me perderé en mi propio vecindario si se apaga la batería.

Alicia

Es el mismo mecanismo. El texto incluso menciona cómo depender de la búsqueda web ha dañado físicamente nuestra memoria biológica de recuerdo.

Beto

Vaya.

Alicia

Sí. Asumimos que la información siempre estará en nuestro bolsillo, así que nuestros cerebros dejan de intentar retenerla. El cerebro poda las vías neuronales que no se están utilizando.

Beto

Así que si un doctor deja de sintetizar activamente los síntomas, porque la IA lo hace, sus músculos de diagnóstico simplemente se atrofian.

Alicia

Precisamente. Ahora, la segunda trampa es quizás aún más preocupante para los educadores, y eso es la pérdida de habilidades ("never-skilling").

Beto

Significa que nunca construiste el músculo en primer lugar.

Alicia

Sí. Esto sucede cuando la IA se introduce demasiado pronto en el proceso de aprendizaje. El material de origen hace referencia a un estudio que muestra que los participantes que dependieron en gran medida de herramientas de IA tuvieron una participación significativamente reducida en la resolución independiente de problemas.

Beto

Simplemente se rindieron y dejaron que la máquina lo hiciera.

Alicia

Y crucialmente, los participantes más jóvenes mostraron una dependencia mucho mayor de la IA y puntuaciones de pensamiento crítico notablemente más bajas que los usuarios mayores.

Beto

Porque el aprendizaje requiere fricción.

Alicia

Exacto. Si un estudiante nunca lucha a través de ese proceso desordenado y frustrante de evaluar síntomas conflictivos, nunca adquiere la competencia básica. Simplemente se convierten en un conducto para la máquina.

Beto

Lo que lleva directamente a la tercera trampa. Y esto se siente como la amenaza más inmediata en el entorno hospitalario real.

Alicia

La aplicación incorrecta de habilidades ("mis-skilling").

Beto

La aplicación incorrecta de habilidades es increíblemente peligrosa. Esto es confiar ciegamente en una salida de IA inexacta o sesgada, lo que luego refuerza permanentemente ese comportamiento incorrecto en la mente del humano.

Alicia

El texto proporciona un ejemplo realmente reflexivo de esto. En un estudio clínico, se les mostraron a los médicos predicciones diagnósticas generadas por IA que contenían sesgos sistemáticos deliberados.

Beto

¿Qué tipo de sesgos?

Alicia

Bueno, la IA sobreestimaría consistentemente la probabilidad de neumonía solo porque un paciente era mayor o sobreestimaría el fallo cardíaco si el paciente tenía un índice de masa corporal más alto.

Beto

Oh, vaya. ¿Y qué hicieron los médicos?

Alicia

En lugar de corregir a la máquina, los clínicos fueron más propensos a adoptar esas predicciones incorrectas ellos mismos. El error confiado de la IA empobreció activamente al humano.

Beto

Ok, tengo que hacer una pausa y ser el abogado del diablo aquí. Retrocedamos esto un poco.

Alicia

Bien, dale.

Beto

Porque constantemente escuchamos lo increíbles que son estos modelos, ¿verdad? Sabemos que estos LLMs están pasando exámenes de certificación médica. El texto mismo señala que han logrado un rendimiento de nivel experto en desafíos diagnósticos complejos.

Alicia

Lo han hecho.

Beto

Así que si la IA es estadísticamente muy precisa la mayor parte del tiempo, ¿no deberíamos simplemente dejar que tome el control? Quiero decir, ¿por qué obligar a un humano a hacerlo si la IA es mejor?

Si le das a un doctor con dificultades una IA súper inteligente, ¿no lo convertiría instantáneamente en un mejor médico?

Alicia

Es totalmente lógico asumir eso, pero los datos en el material de origen revelan un hallazgo contraintuitivo masivo que lo refuta firmemente.

Beto

Ok, estoy escuchando.

Alicia

Cuando los investigadores buscaron escenarios donde la IA superó a los clínicos humanos, combinar la humana y la IA resultó en un rendimiento general peor que usar la IA sola.

Beto

Espera, para. Necesito asegurarme de que estoy entendiendo esto correctamente. Tomas a un doctor promedio, le das una IA súper avanzada y su rendimiento combinado es peor que si la IA simplemente tratara a un paciente por sí misma.

Alicia

Sí.

Beto

¿Cómo tiene sentido eso?

Alicia

Sucede debido a cómo están cableados nuestros cerebros. Nuestros cerebros están programados biológicamente para conservar energía cognitiva.

Beto

Somos perezosos.

Alicia

Preferimos el camino de menor resistencia. Cuando se nos presenta una respuesta fluida y confiada de una máquina, confiamos en heurísticas o atajos mentales. Esto se llama sesgo de automatización ("automation bias").

Beto

Ah, sesgo de automatización. Los clínicos con habilidades base bajas simplemente se acquiescen a la máquina. Porque les faltaba el conocimiento fundamental profundo requerido para detectar las alucinaciones o sesgos sutiles de la IA, no podían supervisar la salida.

Alicia

Simplemente se anclaron a su confianza.

Beto

Exacto. Perdieron los detalles críticos que podrían haber captado si se les obligara a pensar en el problema desde cero.

Alicia

¿Así que la falsa confianza de la máquina anula su propia intuición?

Beto

Sí, sin embargo, y esta es la distinción crucial, cuando los expertos humanos altamente capacitados colaboraron con la IA, su rendimiento combinado se disparó más allá de las capacidades de la IA por sí sola.

Alicia

Oh.

Beto

La IA potenció sus marcos de diagnóstico ya fuertes. Así que la conclusión aquí es innegable. Absolutamente debes tener habilidades humanas fundamentales altas para usar la IA de forma segura.

Alicia

Porque no puedes supervisar una caja negra si no entiendes profundamente el proceso que está tratando de replicar.

Beto

Exacto.

Alicia

Ok, esto nos trae de vuelta a nuestra anécdota original. Nuestro doctor sénior está viendo al residente usar ChatGPT para el sibilante del Sr. C.

Beto

El doctor sabe que si simplemente dejan que esto suceda, el residente podría estar perdiendo habilidades, o nunca adquiriendo habilidades, o cayendo víctima del sesgo de automatización. Pero tampoco pueden simplemente gritar: "¡Guarda tu teléfono!".

Alicia

No pueden prohibir la tecnología. Está en todas partes.

Beto

Entonces, ¿cómo intervienen? ¿Qué hacen realmente en ese momento?

Alicia

Los autores proponen una intervención educativa estructurada llamada DEFT-AI. Es un acrónimo y está diseñado para cultivar el pensamiento crítico y la práctica adaptativa en el momento.

Beto

DEFT-AI. Ok, desglosémoslo. La D significa Diagnóstico o Discusión.

Alicia

Sí. Empieza cuando el supervisor simplemente pide al aprendiz que muestre su trabajo. En lugar de preguntar: "Oye, ¿hiciste trampa?", preguntan sobre la metodología.

Beto

Correcto. Preguntando al residente cómo usa la IA. ¿Qué herramienta específica usaste? ¿Cuál fue tu instrucción exacta ("prompt")? ¿Simplemente escribiste "paciente tiene sibilancias" y aceptaste la primera respuesta? ¿O la cuestionaste?

Alicia

Una vez que entiendes el cómo, pasas a la E, que es evidencia. El supervisor debe obligar al aprendiz a involucrar su propio cerebro. Profundas su conocimiento médico.

Beto

Demuestra la salida de la IA.

Alicia

Exacto. Si la IA sugirió insuficiencia cardíaca, el educador no solo está de acuerdo. Pregunta: ¿Puedes justificar esa recomendación usando tus propios marcos diagnósticos? ¿Qué literatura revisada por pares apoya esta salida?

Beto

Lo estás forzando a salir de ese camino de menor resistencia. Estás devolviendo la fricción.

Alicia

Precisamente. Luego viene la F, que es la retroalimentación ("feedback"). Este es un momento de autorreflexión guiada.

Beto

Como preguntar al residente cómo cree que puede mejorar su uso de la IA la próxima vez.

Alicia

Sí. Ayudándoles a darse cuenta de que necesitan empezar a verificar las salidas antes de comprometerlas en una historia clínica, lo que naturalmente lleva a la T, enseñanza ("teaching").

Beto

Reforzando el razonamiento clínico.

Alicia

Y enseñando explícitamente la alfabetización en IA. Explicando por qué un chatbot general podría no ser seguro para uso diagnóstico.

Beto

Realmente quiero enfatizar algo para ustedes que están escuchando ahora mismo. Este marco DEFT-AI no es solo para médicos.

Alicia

Para nada.

Beto

Puedes usarlo para auditar tu propio uso de la IA en el trabajo. Cuando uses un LLM para generar una previsión financiera, pregúntate, ¿estás aceptando ciegamente la salida? ¿O te estás obligando a proporcionar la evidencia para respaldarla?

Alicia

Esa autoauditoría es esencial. Porque el paso final de todo este proceso es hacer una recomendación sobre cómo debes interactuar con la IA en el futuro.

Beto

Y aquí es donde se pone realmente interesante. Me obsesioné con esta parte. La revista médica usa terminología de la mitología y la ciencia ficción para describir esto. Lo llaman "el comportamiento centauro-cyborg" del uso de IA.

Alicia

Es una gran manera de visualizarlo.

Beto

Lo es. Los dos modos de comportamiento son centauros y cyborgs. Vamos a desglosarlos realmente porque son formas distintas de colaborar con la máquina.

Alicia

Empecemos con el comportamiento centauro. Imagina la criatura mítica mitad humana y mitad caballo. En este modo, hay una clara división estratégica del trabajo.

Beto

El humano es la cabeza.

Alicia

Correcto. El humano lidera la estrategia. Y la IA es el caballo, proporcionando la potencia bruta para tareas específicas y delimitadas. Pero el humano retiene el control absoluto sobre el juicio final.

Beto

Yo diría que veo al centauro como tratando a la IA como a un aprendiz entusiasta pero inexperto. Le entregas una tarea muy específica, como resumir estos tres registros de pacientes, pero no dejas que el aprendiz tome la decisión estratégica final.

Alicia

Y el artículo enfatiza que el centauro es absolutamente obligatorio para tareas de alto riesgo. O cualquier momento que uses una herramienta de IA no validada, delegas, pero evalúas cuidadosamente.

Beto

Entendido. Ok, ¿qué hay del cyborg?

Alicia

La figura del cyborg es como un entrelazamiento continuo y apretado de lo humano y la máquina a través de cada etapa de una tarea.

Beto

Así que si el centauro está delegando a un aprendiz, el cyborg es como trabajar lado a lado con un colega. Estás constantemente pidiendo y refinando juntos.

Alicia

Sí, co-construyendo la salida en tiempo real. Ahora esto es muy eficiente y puede producir resultados increíblemente creativos. Pero conlleva un riesgo dramáticamente mayor de sesgo de automatización.

Beto

Porque tus pensamientos y los pensamientos de la máquina se difuminan.

Alicia

Exacto. Y por lo tanto, los autores recomiendan encarecidamente restringir el comportamiento cyborg a tareas de bajo riesgo, bien definidas o puramente administrativas.

Beto

Como usar un escriba ambiental de IA que solo escucha una conversación con un paciente y genera una nota.

Alicia

Ejemplo perfecto. El doctor puede simplemente revisarla rápidamente.

Beto

Ok, pero tengo una pregunta. ¿No es agotador tener que descubrir constantemente si necesito ser un centauro o un cyborg hoy? ¿Estoy delegando o estoy entrelazando? Se siente como mucha sobrecarga mental.

Alicia

Es un esfuerzo mental significativo. Es agotador. Pero esa fricción deliberada es exactamente el punto. Estos no son tipos de personalidad. Son modos que debes cambiar fluidamente en función del perfil de riesgo de la tarea. Esto es lo que los autores llaman "práctica adaptativa".

Beto

Entonces, ¿esa pausa cognitiva es una característica, no un error?

Alicia

Absolutamente. Tomar esa pausa antes de involucrarte es lo que te impide caer en el sesgo de automatización.

Beto

Ok, para ser un buen centauro o cyborg, necesitas alfabetización en IA real. ¿Cómo aseguramos que la IA nos está dando buenos datos para empezar?

Alicia

Bueno, todo comienza con la ingeniería de indicaciones ("prompt engineering"). Una instrucción vaga produce una respuesta vaga y potencialmente engañosa. Los autores sugieren una estrategia de quién, dónde y qué.

Beto

¿Quién, dónde, qué?

Alicia

Defines a quién está actuando la IA, dónde se sitúa el contexto y cuáles son los límites específicos.

Beto

Hagamos un ejemplo rápido. Una mala instrucción es: "escribe un correo de marketing de mi producto".

Alicia

Instrucción terrible.

Beto

Correcto. Le estás dando nada. Pero una buena instrucción se ve así: "Actúa como un redactor de copias sénior para una empresa de tecnología. Estás lanzando un nuevo software la próxima semana. Redacta un correo electrónico de 200 palabras a nuestros clientes existentes, destacando la nueva característica, manteniendo un tono urgente".

Alicia

La diferencia en la calidad de la salida allí será asombrosa.

Pero más allá del contexto, los autores destacan una técnica específica que cambia fundamentalmente cómo evaluamos la lógica de la IA. Se llama "instrucción de cadena de pensamiento" ("chain of thought prompting").

Beto

Esta fue un momento "¡Ajá!" masivo para mí en las fuentes. No solo pides una respuesta. Añades la frase, explica tu razonamiento paso a paso.

Alicia

Lo fascinante aquí es que forzar al LLM a generar pasos intermedios, esencialmente pensando en voz alta, realmente mejora su precisión estadística.

Beto

¿De verdad? Solo por pedirle que se explique a sí misma.

Alicia

Sí. Pero más importante aún, fuerza a la caja negra a revelar su lógica probabilística. Esto permite al humano evaluar activamente la fiabilidad de la salida.

Beto

Convierte una tarea de lectura pasiva en un momento diagnóstico activo. Puedes ver literalmente si alucinó en el paso dos.

Alicia

Lo que nos trae al paradigma definitivo que los autores defienden: "verificar y confiar" ("verify and trust"). Porque no importa cuán avanzada sea la instrucción, sigue siendo un salto de fe. Tenemos que tratar las salidas de la IA como un informe radiológico preliminar.

Beto

Me encanta esa analogía. Es un punto de partida.

Alicia

Sí.

Beto

Un complemento.

Alicia

Exacto. Un cirujano nunca operaría en un paciente basándose solo en una lectura preliminar sin verificar esas conclusiones por sí mismo. El diagnóstico final debe seguir siendo un esfuerzo humano.

Beto

El paradigma no puede ser confianza ciega. Debe ser verificar y confiar.

Así que recapitulamos nuestro viaje de hoy. Exploramos ese salto de fe, la IA requiere, y los enormes peligros de la pérdida de habilidades, la incapacidad para desarrollar habilidades y la aplicación incorrecta de habilidades.

Alicia

Y vimos cómo el marco DEFT-AI nos ayuda a evaluar nuestro uso de la tecnología, forzándonos a proporcionar la evidencia.

Beto

Correcto. Y la importancia de saber cuándo ser un centauro estratégico frente a un cyborg altamente integrado, lo cual se aplica directamente a ti que estás escuchando ahora mismo. Ya sea que estés diagnosticando a un paciente, preparándote para una reunión de la junta directiva o simplemente tratando de aprender una nueva materia. Tu pensamiento crítico es el baluarte definitivo contra los errores confiados de la máquina.

Alicia

Debes mantener tus habilidades básicas para sacar el máximo provecho de la tecnología.

Beto

De verdad lo tienes que hacer.

Alicia

Sí.

Beto

Pero quiero dejarles una pregunta final y persistente para que la piensen ustedes mismos. Todo este modelo de verificar y confiar se basa en que el ser humano pueda comprender y verificar el trabajo de la IA, ¿verdad?

Alicia

Correcto.

Beto

Pero las capacidades de razonamiento de la IA, eventualmente se escalan tan lejos de la inteligencia humana, que se vuelve completamente incomprensible para nosotros. ¿Será posible verificar y confiar? ¿Cómo puedes supervisar una máquina cuyos saltos de fe están completamente fuera de tu comprensión?

Alicia

Ese va a ser el desafío definitivo de nuestro futuro.

Beto

Definitivamente algo para pensar.

Muchas gracias por acompañarnos en este análisis profundo. Nos vemos la próxima vez.