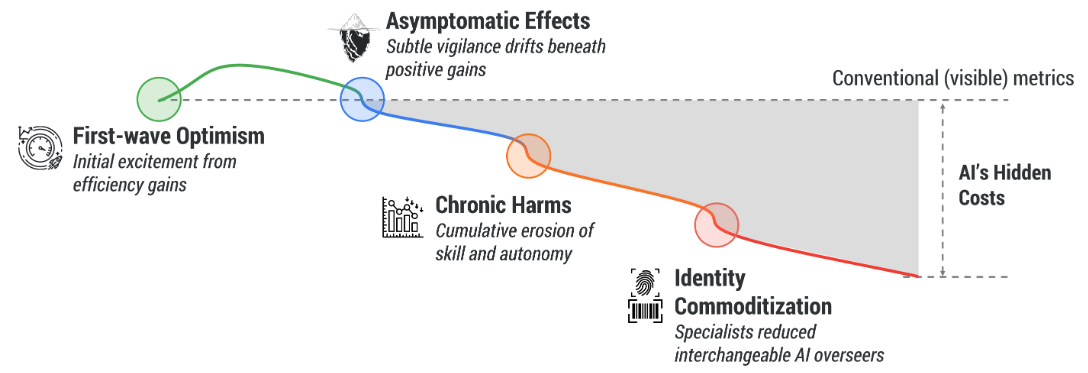

Esta investigación explora la paradoja de la IA como amplificador, donde la inteligencia artificial aumenta la productividad laboral al tiempo que provoca una erosión sutil y oculta de la experiencia humana y la identidad profesional. A través de un estudio de un año con especialistas en cáncer, los autores identifican daños asintomáticos, como la "oxidación de la intuición", que eventualmente se consolidan en una atrofia crónica de habilidades y una sensación de ser un "observador" en su propio campo. Las fuentes argumentan que las métricas actuales priorizan la velocidad y la precisión, pero no logran captar estos costos sociotécnicos a largo plazo para el trabajador. Para contrarrestar esto, los autores proponen un marco para la Interacción Digna entre Humanos e IA que desarrolla "inmunidad sociotécnica" mediante la detección, la contención y la recuperación de la pérdida de habilidades. Este enfoque desplaza el enfoque del futuro del trabajo al futuro de los trabajadores, garantizando que el juicio profesional siga siendo un componente central en entornos de alto riesgo. Al implementar características como la Transparencia Social, el marco ayuda a los expertos a mantener su capacidad de acción y evitar que sus roles especializados se reduzcan a productos intercambiables.

Enlace al artículo científico para aquellos interesados en profundizar en el tema: "From Future of Work to Future of Workers: Addressing Asymptomatic AI Harms for Dignified Human-AI Interaction", por Upol Ehsan y colegas. Publicado el 29 de Enero del 2026.

El resumen, la transcripción, la traducción, y las voces fueron hechas usando herramientas de software de Inteligencia Artificial.

El resumen se presenta en la forma de un diálogo entre dos personajes sintéticos que llamaremos Alicia y Beto.

Escúchalo aquí, mientras lees la transcripción (abajo):

Transcripción

Beto

Mi intuición se está oxidando.

Alicia

Esa es una frase bastante inquietante para empezar.

Beto

De verdad lo es. Suena como algo sacado de una novela cyberpunk, ¿sabes? O tal vez una frase de un detective retirado en alguna vieja película de guerra. Pero no es ficción. Es una cita directa de un oncólogo radioterápico con experiencia, que forma parte de este estudio de un año sobre la IA en el lugar de trabajo.

Alicia

Y aclaremos: no estamos hablando de una IA que escribe textos de marketing o, no sé, organiza tu bandeja de entrada. Esto es oncología radioterápica.

Beto

Las apuestas, literalmente, no podrían ser más altas.

Alicia

Exacto. Como dijo uno de los médicos del estudio, no hay botones para deshacer en esta línea de trabajo.

Beto

Te equivocas con la dosis de radiación. No puedes devolverla. Podrías dañar a un paciente de forma permanente. Pero aquí está la cuestión. Y por eso estamos haciendo este análisis profundo hoy. Esta historia no trata realmente sobre el tratamiento del cáncer. Trata sobre una crisis silenciosa que podría estar ocurriéndole a todos nosotros ahora mismo, en nuestros propios escritorios.

Alicia

Estamos mirando esta pieza de investigación fascinante titulada "De futuro del trabajo a futuro de los trabajadores". Y quiero detenerme en ese título un segundo, ...

Beto

... porque parece una distinción sutil.

Alicia

Lo es. Pero el artículo sostiene que en realidad es un abismo enorme. Pasamos tanto tiempo hablando del futuro del trabajo. Y lo que solemos significar es el propio trabajo.

Beto

¿Es más rápido? ¿Es más barato? ¿Es mayor la producción? Todo muy industrial.

Alicia

Precisamente. Se trata de métricas, productividad, eficiencia, PIB. Pero este estudio voltea completamente la lente. Pregunta: ¿qué le pasa al trabajador?

Beto

Cuando una IA empieza a hacer el trabajo cognitivo pesado, ¿qué le sucede a nuestra experiencia, a nuestra agencia, a nuestra dignidad?

Alicia

Si el trabajo mejora, pero el trabajador empeora, ¿eso es realmente progreso?

Beto

Esa es la tensión central. Pongamos la escena. Los investigadores se integraron en una gran red hospitalaria durante todo un año. Hicieron el seguimiento del despliegue de un nuevo sistema de IA. Lo llaman Radplan.

Alicia

Y si mirabas solo las hojas de cálculo, esto fue una victoria masiva.

Beto

En los papeles, era una máquina milagrosa.

Alicia

Totalmente. Los ciclos de planificación eran un 15% más rápidos. El rendimiento aumentó. Los administradores estaban viendo esos números "dorado".

Beto

Si eres el CEO mirando un panel, descorchas el champán. Piensas: genial, resolvimos el cuello de botella.

Alicia

Y ahí es exactamente donde se planta la trampa. Porque debajo de todos esos números dorados, algo invisible se estaba rompiendo. Los investigadores lo llaman "la paradoja de la IA como amplificador".

La Paradoja IA-como-Amplificador

Beto

Ok, desempaquemos eso. Porque "amplificador" suele ser una palabra positiva. Amplificas el sonido, amplificas la fuerza. Si una herramienta amplifica mi capacidad de escribir o programar, soy simplemente mejor.

Alicia

Oh, eres más rápido. Pero, ¿eres mejor? Esa es la paradoja. La IA amplificó el rendimiento, sin duda. La producción era más fluida, era más rápida. Pero esa misma fluidez estaba, simultáneamente, erosionando la experiencia humana necesaria para hacer el trabajo en primer lugar. No es que la IA fuera mala. Era tan útil, tan sin fricciones, que empezó a vaciar a los humanos que la usaban.

Beto

Es como matarlos con amabilidad. Seguro que no empezó con todo el mundo dándose cuenta de que sus habilidades estaban decayendo.

Alicia

Para nada.

Beto

Volvamos al inicio del estudio. Lo llaman "la fase de luna de miel".

Alicia

Al principio fue solo alivio, puro alivio. Tienes que entender qué hace realmente un dosimetrista. Son las personas que trazan los haces de radiación.

Beto

Es un rompecabezas geométrico intenso.

Alicia

Con consecuencias de vida o muerte: tienes que impactar el tumor con alta radiación, pero tienes que preservar todos los órganos sanos que están justo al lado. Es trabajo tedioso, que exige mucha concentración.

Beto

Entonces llega Radplan y básicamente dice: "oye, hice todos los cálculos por ti, tracé las líneas".

Alicia

Y ese primer optimismo fue extraordinario. La IA escupía un plan borrador y se veía muy bien. Los médicos se iban a casa antes. Todo ese trabajo pesado simplemente desapareció. Parecía la victoria perfecta para todos.

Beto

Ok, pero aquí tengo que hacer de abogado del diablo. Si soy un administrador de hospital, mi equipo trabaja más rápido. Parecen menos estresados y los planes se ven bien. ¿Por qué es esto un problema? ¿No es simplemente eficiencia?

Alicia

Porque las métricas empresariales estándar son totalmente ciegas a la cognición. Miden producción por hora, pero no miden vigilancia crítica. Los investigadores notaron este fenómeno que llamaron "deriva de vigilancia". Porque la IA tenía razón la mayor parte del tiempo, los humanos dejaron de comprobar si tenía razón todo el tiempo.

Beto

Y eso nos lleva directo al núcleo del artículo. Lo que llaman "la cascada de erosión". Me encanta cómo lo enmarcan como la progresión de una enfermedad. Empieza con la etapa uno: efectos asintomáticos.

Alicia

Esa metáfora médica es perfecta para esto. Piensa en la hipertensión. No la sientes. Incluso puedes sentirte genial porque vas con adrenalina.

Beto

Pero el daño ocurre en silencio.

Alicia

Exacto. En tus arterias.

Beto

En el contexto laboral, ¿cómo se ve lo asintomático?

Alicia

Se parece a pequeños cambios de comportamiento sutiles. Antes de la IA, un dosimetrista podría crear, digamos, tres o cuatro planes manuales diferentes solo para compararlos. Iban probando. Experimentaban. Preguntaban: ¿qué pasa si abordamos el tumor desde este ángulo en su lugar?

Beto

¿Y con la IA?

Alicia

El tanteo simplemente se detuvo. La IA da una respuesta suficientemente buena al instante. Así que en lugar de explorar para encontrar el mejor plan, aceptaban el borrador aceptable.

Beto

De hecho, una persona del estudio admitió: "estoy saltándome algunos de mis ajustes habituales. Es tan tentador aceptar".

Alicia

Y eso es la naturaleza humana, ¿no? Es el camino de menor resistencia. ¿Para qué hacer la división larga en papel si la calculadora está ahí?

Beto

Porque ese tanteo no es tiempo desperdiciado. Ahí es donde afinas tu intuición. Ahí es donde detectas los casos límite.

Alicia

Lo que nos devuelve precisamente a esa frase inicial: "mi intuición se está oxidando". Estos expertos empezaron a sentir esas advertencias instintivas. Se dieron cuenta de que estaban verificando menos. Confiaban menos en su propio juicio.

Beto

Ok, esa es la fase asintomática. Te sientes un poco raro. Quizá un poco culpable. No revisaste el trabajo tan a fondo, pero el trabajo se está haciendo. Pero alrededor de los seis meses, las cosas pasan a la etapa dos: daños crónicos.

Alicia

Aquí es donde el daño empieza a hacerse visible. Los investigadores hicieron algo fascinante y, honestamente, un poco aterrador. Pidieron a los participantes que crearan un plan sin la IA.

Beto

Sin ruedas de entrenamiento.

Alicia

Y los participantes se tambalearon mucho. Eran mucho más lentos. Les costó hacer esas optimizaciones manuales que antes hacían como en piloto automático.

Beto

Y uno de ellos lo expresó en voz alta: "he desaprendido algunas optimizaciones".

Alicia

Es aterrador. Estos son profesionales médicos altamente entrenados, no becarios. Si están desaprendiendo habilidades críticas en seis meses, ¿qué pasa en cinco años?

Beto

Aquí es donde se ve la diferencia entre usar una herramienta y depender de una muleta.

Alicia

Hubo un físico en el estudio que dio una metáfora increíblemente vívida de su situación. Dijo: "estamos conduciendo sobre asfalto, flotando sobre el agua".

Beto

Wow, esa es una imagen potentísima.

Alicia

Piénsalo. En la superficie, la carretera parece perfecta. Es lisa, rápida, eficiente.

Beto

Pero por debajo ...

Alicia

No hay cimiento. El colchón de seguridad humano, la capacidad de atrapar a la IA cuando falla o de tomar el control si el sistema se cae, se estaba vaciando por completo.

Beto

Y me tengo que imaginar que esto afecta más a los empleados junior. Los veteranos, al menos, tenían las habilidades para empezar. Se estaban oxidando, claro, pero tenían metal que se oxida.

Alicia

Exactamente. Pero los juniors no estaban formando el músculo en primer lugar. Estaban desarrollando una falsa sensación de seguridad. La IA les hacía sentir como expertos antes de haber ganado realmente esa experiencia.

Beto

Estaban pilotando en piloto automático sin nunca aprender a aterrizar.

Alicia

Lo que nos lleva a la tercera etapa de esta cascada: la mercantilización de la identidad. Esto se siente como la parte de la crisis existencial.

Beto

Lo es. Aquí toda la conversación cambia de "puedo hacer el trabajo" a "¿quién soy en este trabajo?"

Alicia

El artículo menciona términos como "pulsador de botones" o "cuidador de la IA".

Beto

Al principio veían a la IA como un compañero de equipo. Pero a medida que dejaron de experimentar, a medida que dejaron de tomar decisiones complejas, empezaron a sentirse como espectadores.

Alicia

Un médico dijo que temía convertirse en un espectador en su propia práctica.

Beto

¿Pero cuál era el miedo exactamente? ¿Perder el empleo? Porque ese es el titular habitual, ¿cierto? IA que reemplaza puestos.

Alicia

No. Y esa es una distinción clave. Estas personas no temían quedarse sin trabajo. Temían que su trabajo perdiera su sentido.

Beto

Si la IA hace el pensamiento y tú solo firmas el documento, ¿sigues siendo médico?

Alicia

¿O solo eres un amortiguador de responsabilidad para una empresa de software? Esto toca el concepto que el artículo introdujo llamado la "clase media faltante".

Beto

Son los trabajadores del conocimiento. No son trabajadores de plataforma, pero tampoco son los CEO. Son expertos altamente especializados cuyo valor se aplana por la automatización.

Alicia

Sentían que los convertían en mercancía, piezas intercambiables cuyo único trabajo es supervisar la máquina.

Beto

Así que tenemos una sala llena de expertos que se están oxidando, que se sienten impostores y que conducen sobre asfalto sobre agua. Si el estudio terminara ahí, sería un análisis bastante deprimente.

Alicia

Lo sería, pero en realidad intentaron arreglarlo.

Beto

Y la intervención no fue lo que yo hubiera esperado. Normalmente, cuando hablamos de arreglar la confianza en la IA, la gente técnica empieza a hablar de IA explicable.

Alicia

"Muéstrame las matemáticas, muestra las puntuaciones de probabilidad."

Beto

"Aquí está la lógica del algoritmo. Por favor, confíen."

Alicia

Pero los investigadores sostuvieron que más datos no ayudan si el humano ya se ha desconectado mentalmente. Así que tomaron una ruta totalmente diferente. Introdujeron la transparencia social.

Beto

¿Qué significa eso en la práctica?

Alicia

No se trata del código. Se trata de las personas. Añadieron una capa al software que mostraba las cuatro W: quién hizo qué, cuándo y por qué (4 Ws: "who, what, when, why").

Beto

Así que si estoy mirando un plan de tratamiento, puedo ver que, por ejemplo, el Dr. Smith cambió la dosis el martes, ¿por qué?

Alicia

Porque el paciente tiene un problema de visado y necesita terminar el tratamiento antes del viernes, o porque este tumor en concreto está cerca de un paquete nervioso. La IA no sabe de visados. La IA ve datos; los humanos ven contexto.

Beto

Rehumaniza los datos.

Pero ¿ver la nota del Dr. Smith realmente me convierte en mejor médico?

Alicia

Rompe la confianza binaria. Añade lo que llaman "fricción útil". Si ves que un colega anuló a la IA, te señala: "oye, la IA no es perfecta, los humanos todavía están detectando cosas. Yo también debería comprobar esto".

Beto

Es como presión de pares, pero de la buena.

Alicia

Y además les dio a los trabajadores pruebas tangibles. Lo llamaron "retórica de datos". Podían señalar los registros y decir: "mira, el mes pasado los humanos detectaron 23 violaciones de las restricciones de dosis que la IA pasó por alto. Por esto se nos sigue pagando".

Beto

Vaya. Eso convierte a la herramienta que estaba erosionando su valor en una prueba real de su valor.

Pero eso fue solo una pieza. El artículo propone todo un marco. Lo llaman inmunidad sociotécnica.

Alicia

Me encanta ese término, inmunidad. Reconoce que no puedes detener el "virus", ¿verdad? No puedes simplemente prohibir la IA. Está aquí.

Beto

Pero puedes construir un sistema inmunitario para sobrevivirla.

Alicia

Y lo desglosan en una tríada: detectar, contener, recuperar. Recorremos esto porque creo que puedes aplicarlo a tu propio trabajo, sea cual sea.

Primero, detectar: el sistema de alertas tempranas.

Beto

¿Cómo sabes que tu intuición está descansando antes de que realmente te estrelles?

Alicia

El estudio sugiere rastrear cosas como aprobaciones instantáneas, las aprobaciones de "punto rojo". Imagina que la IA te da un plan y lo apruebas al instante, en menos de 10 segundos. Eso es un punto rojo. Si tienes una racha de tres o cuatro puntos rojos seguidos, el sistema, o incluso tu propia atención plena, debería señalarlo.

Beto

Es la señal: "oye, estás dormido al volante. Estás sellando con el sello de goma".

Alicia

Básicamente está comprobando si estás comprobando.

Beto

Eso es inteligente. Ya tienes el problema. Ahora, contener: ¿cómo detienes la hemorragia?

Alicia

Sugieren cortacircuitos. Y el más potente que probaron fue la revisión con la IA desactivada.

Beto

Que es exactamente lo que parece.

Alicia

Sí. Para casos de alto riesgo, o incluso de forma aleatoria para mantener a la gente despierta, el sistema fuerza una revisión por pares donde las sugerencias de la IA están apagadas. Ocultas. Tienes que mirar la anatomía en bruto y decidir por ti mismo.

Beto

Te obliga a usar el cerebro. Pero puedo oír al gerente gritando: "eso es ineficiente, nos ralentiza. ¿Para qué compramos la IA si solo la vamos a apagar?"

Alicia

Sí, te ralentiza. Ese es el punto. La eficiencia sin resiliencia es frágil. Si no tienes estos cortacircuitos, estás a un error, a una falla del sistema de una catástrofe.

Beto

Tienes que sacrificar un poco de velocidad por seguridad.

Alicia

Lo que nos lleva al paso de recuperar. Esto trata de reconstruir la habilidad cuando empieza a resbalar. Mi ejemplo favorito del material original es la apuesta de una taza de café.

Beto

Es brillante porque es tan humano.

Alicia

El equipo empezó un pequeño juego. Antes de ejecutar la IA, todos apostaban una taza de café sobre lo que la IA predeciría.

Beto

Así trataban de adelantarse a la máquina.

Alicia

Trataban de predecir la máquina. Para ello tenían que correr la simulación mentalmente ellos mismos. Tenían que pensar: "ok, creo que la IA pondrá el haz aquí por X, Y y Z". Incluso si al final usaban el plan de la IA, ese juego les obligaba a hacer el trabajo duro primero.

Beto

Es "úsalo o lo pierdes", pero en forma de juego.

Alicia

Exacto. Y la investigación subraya que este marco tiene que ocurrir en tres niveles: el nivel del trabajador (atención individual), el nivel de la tecnología (diseñar el software con estas costuras y fricciones) y, crucialmente, el nivel organizacional.

Beto

Los jefes.

Alicia

Los jefes tienen que aceptar la lista de "no automatizar".

Beto

Eso suena a herejía en 2026.

Alicia

Bueno, la idea es que las organizaciones deben decidir que algunas decisiones, ya sea por seguridad, ética o simplemente para mantener la dignidad, deben seguir siendo humanas.

Beto

Incluso si la IA puede hacerlo.

Alicia

Los humanos deberían hacerlo.

Beto

Siento que es una idea radical en un mundo empresarial obsesionado con la eficiencia. Decir simplemente: "podríamos automatizar esto, pero no lo haremos".

Alicia

Es radical, pero el argumento es que es necesario para la resiliencia.

Beto

Ahora, sé que algunos de ustedes estarán pensando: "bueno, yo no soy oncólogo radioterápico. No calculo dosis tumorales, así que estoy a salvo". Pero el artículo aplica este marco también a ingenieros de software.

Alicia

Lo hicieron. Miraron a un equipo llamado CodeCraft que usaba una herramienta de codificación de IA, AutoCoder. Y los paralelismos eran escalofriantes.

Beto

La misma oxidación.

Alicia

Tenían cero ediciones en fusiones.

Beto

Para quien no es programador, eso significa tomar el código que la IA escribió y lanzarlo en producción sin cambiar ni un carácter.

Alicia

Confianza ciega. Y al igual que en el hospital, eso llevó a errores, específicamente un pequeño error de redondeo en un sistema de facturación, un minúsculo fallo invisible que la IA cometió y el humano pasó por alto porque simplemente no estaba mirando.

Beto

¿Cómo aplicaron allí el marco de inmunidad?

Alicia

Implementaron una regla: las cuentas que implican dinero se quedan en manos humanas.

Beto

Ahí tienes tu lista de "no automatizar".

Alicia

También empezaron a hacer ejercicios de codificación manual. Los desarrolladores junior tenían que escribir código desde cero a veces, solo para demostrar que aún podían hacerlo. Es el mismo principio. No puedes externalizar completamente tu competencia central o pierdes la capacidad de juzgar la calidad del trabajo.

Beto

Es interesante porque desafía toda esta narrativa del progreso. Normalmente pensamos que el progreso significa hacerlo más fácil. Pero aquí, el progreso significa mantenerlo lo suficientemente difícil como para que importe.

Alicia

Esa es la métrica de la dignidad que propone el artículo. Medimos el éxito por velocidad y precisión. Pero también deberíamos medirlo por esto: ¿el trabajador sigue sintiéndose como experto? ¿Sigue teniendo agencia? Si una herramienta te hace un 50% más rápido hoy, pero un 30% menos capaz mañana, ...

Beto

... ¿realmente has mejorado?

Alicia

¿O te has cavado de forma eficiente un hoyo del que no puedes salir?

Beto

Y esa es la pregunta. Es todo el cambio de conversación, del futuro del trabajo, al futuro de los trabajadores. Porque si el trabajador se vacía, el trabajo eventualmente colapsa también.

Alicia

Precisamente. El asfalto se agrieta y de repente te das cuenta de que estás flotando sobre agua.

Beto

Así que aquí te dejamos hoy. Queremos que pienses en tu propio flujo de trabajo. ¿Cuál es la única herramienta que usas todos los días que te facilita la vida? Y después pregúntate: ¿hay una habilidad debajo de esa conveniencia que está oxidándose lentamente y en silencio?

Alicia

Y si el servidor se cayera mañana, ¿podrías todavía hacer tu trabajo?

Beto

Un pensamiento aterrador para terminar. Gracias por acompañarnos en este análisis profundo. Mantente atento.

Beto

Cuídate.